編集部注:トークンはAI時代の価値基準を再構築しつつある。それは効率革命の原動力なのか、それともコスト暴走の暗礁なのか?本号では、トークンによるコスト削減という視点から、AI時代の「新石油」の経済的論理を分析する。

トークンに育てられた「鉄のエビ」。

著者:蘇揚、テンセント・テクノロジー

最近、Tokenに関する議論はかなり奇妙な様相を呈している。

WeChatのモーメンツでは、Tokenの中国語訳に関する議論が至る所で見られる――「詞元」「智元」などがあり、さらには「慧根」といったユーモアたっぷりのバージョンまである。

Tokenは新しい概念ではない。大規模モデルが実用化された初日から、それはニューラルネットワークと共生してきたが、OpenClaw(通称「ロブスター」)がユーザー層に大規模に普及し、様々なエージェントアプリケーションがTokenを一般の視野に持ち込むようになるまでは、そうではなかった。

そこには2つの重要な問題があると思う。消費量があまりにも多く、価格も高すぎるということだ。

OpenAIがGPT-5.4をリリースした際、ユーザーが「こんにちは」という一言を試しただけで80ドル分のトークンを消費したという報告がありました。当時は多くの人がこの使用量は異常だと指摘していましたが、OpenClawがユーザー層に大規模に普及するにつれ、1つのタスクで数千万単位のトークンを消費することが常態化しています。

これとは対照的に、NVIDIAのCEOであるジェンスン・フアン氏は、GTC 2026カンファレンスやその後の多くの場で、エンジニアがトークンを大量に使用すべきだと強調し、さらにはトークンを報酬インセンティブ制度に組み込むことさえ提唱しています。

ある対談の席で、黄仁勲氏は次のように語った。「年俸50万ドルのエンジニアが、25万ドル分のトークンさえ使い切らないとしたら、私は極度の危機感を抱くだろう。」

問題は、トークンを狂ったように消費することが必ずしも問題を解決するとは限らないということだ。どれだけのトークンが有効なのか、どのような費用対効果が合理的なのか?

先ほどの海外メディアの報道によると、OpenAIのプログラマーが1週間で2100億トークンを消費したという。これはウィキペディア33個分に相当するが、このような消費量は最終的に何をもたらしたのだろうか?私はWeChatのモーメンツに「これほどの重度利用でP10に昇格できるのか」と投稿したところ、友人がすぐに「トークンを売っている人ならP10に昇格できるだろう」とコメントした。」

明らかに、この狂ったようなトークン消費運動がどれほどの効果をもたらすかは疑問だが、誰が利益を得るかは確実だ。

黄仁勲はNVIDIAを「Tokenの王」と表現し、世界最先端の「Token製造機」を保有していると述べた。しかし、これを必死に宣伝し、Tokenを使わなければ遅れをとるとさえほのめかすのであれば、次のように言えるだろう:一方で、黄仁勲はAI時代の企業の「効率評価」の論理を根本から変えようとしているが、他方で、彼は間接的にTokenへの不安を生み出している。

一、トークンが高すぎる

先日、私は周鴻祎氏に「トークンが高すぎる」という問題について尋ねたところ、彼はこう答えた。「皆さんがトークンを高いと感じているのは、おそらく誤解があるからです。なぜなら、大規模モデルのバックエンドは柔軟に構成できるからです。」

彼の理解では、ユーザーはモデルを自主的に選択することでコストをコントロールできるという。「日常的なチャット会話のコストは実は非常に低い。本当にトークンを消費するのは、動画生成やショートドラマの制作、小説執筆といった複雑なタスクを処理する場面だ。」

私が覚えているところでは、Cheetah MobileのCEOである傅盛氏が動画の中で、いくつかの使用テクニックを駆使することで、当初1日あたり数百ドルかかっていたToken費用を、現在は1日あたり10ドル強まで最適化したと語っていた。30日では2100元、年間費用は25200元となる。

ここで疑問が生じます。1日平均10ドルのコストを負担できるユーザーはどれほどいるでしょうか?

現在、中国のインターネット上で提供されている商用BtoCソフトウェアと比較してみましょう。例えば「剪映」の場合、プレミアム会員の年会費はわずか600元程度、エンターテインメント関連の会員費も概ね300元前後です。年会費が25,000元を超えるコンシューマー向けソフトウェアは、そもそも存在しません。

「大多数の人にとって、1日10ドルという金額は依然として受け入れがたく、これにより多くの非有料ユーザーが排除されてしまうでしょう」と私は傅盛に言った。彼は私の判断を否定しなかった。

ここ数日、私も様々な種類のザリガニ製品を試しているが、かかる費用はTokenだけにとどまらない。

例えば、ユーザーが画像生成を必要とする場合、専用の画像生成モデルAPIが必要になる。動的な状況を監視する場合も、有料の検索APIを連携させる必要がある。こうした潜在的な費用は、大多数のユーザーを徐々に遠ざけてしまうだろう。オープンソースを活用してコストを抑える方法もあるかもしれないが、オープンソースプロジェクトには間接的にセキュリティリスクが潜んでいる。

3月13日、当時テンセント・テクノロジーの「蝦聊」ライブ配信シリーズの第1回で、玄武実験室のゲストであるLambda氏があるデータを共有しました。彼自身、月平均で「エビの飼育」にかかる費用が1,000元以上だというのです。

コンシューマー向けツールの年間利用料を参考にしても、業界の「エビ飼育者」からのフィードバックを見ても、エージェントベースのトークン消費という観点から「トークンが高すぎる」と言うのは、十分に理にかなっています。

二、ストレージのボトルネックと効率のブラックホール

Tokenとは、簡単に言えば大規模言語モデルが情報を処理する基本単位のことだ。ユーザーがプロンプトを入力し、モデルが回答を出力する際、一文字一文字、一区切りごとにTokenの消費量としてカウントされ、本質的には計算リソースのコストとなる。

これまで、計算リソースの総所有コストを算出する際、エネルギー効率を測るFlops/Wや、平均コスト/Flopsなど、多くの指標が用いられてきたが、今年の「トークン経済学」において、Token/Wが徐々に共通認識となりつつある。

「当社のトークン単価は、世界最低水準です。」と黄仁勲氏はGTCで語った。

しかし、どれほど安価であっても、またどの計算単位を用いるにせよ、それは投入コストの定量化であり、研究開発費、ハードウェアコスト、導入コスト、エネルギー消費コスト、運用コストなどが関与している。言い換えれば、コスト削減もすべて上記のプロセスを中心に展開される。

トークンのコスト削減に関して言えば、メモリ価格が急騰していることは悪いニュースだ。

HBMメモリを例にとると、これは大規模モデルのトレーニングと推論を支える重要なデバイスである。同時に、推論データ量の急増により、ストレージ需要も同様に増加している。2026年第1四半期、DRAM価格は前四半期比で50%以上上昇し、NAND価格は最大で150%の上昇を記録した。

ジェンスン・ファンやリサ・スーはすでに「HBMはいくらあっても足りない」と発言しており、サムスンやマイクロンといったストレージメーカーは、主要顧客との戦略的長期契約がすでに5年分締結されていることを公表している。

『メモリ価格急騰100日、1000元スマホは消滅の危機』という記事で触れたように、コンシューマー市場では1000元スマホの在庫が枯渇し、生産中止に追い込まれる可能性があるが、実際にはこの問題の影響を受け、クラウド事業者も現在、価格上昇の苦境に立たされている。業界の最も楽観的な予測では2028年にストレージ価格が下落すると見込まれているが、悲観的な見方では2030年まで待たなければならない。

ストレージ価格が一日も下がらない限り、トークンの価格下落には重要な外部要因が欠如したままとなる。

モデルの能力向上も、価格下落を促すもう一つの要因と見なすことができる。「現在、一部の80億パラメータ級の小型モデルは、フルスケールの大型モデルに能力がますます近づいている」とある学術研究者は述べている。

この点に関して、面壁智能は清華大学のチームと共同で『Nature』誌に「Densing Law」の概念を提唱し、大規模モデルの能力密度が時間とともに指数関数的に増加し、約3.5ヶ月ごとに倍増し、同等の性能を実現するために必要なパラメータ数が3.5ヶ月ごとに半減することを強調した。

ある中国製AIチップ業界関係者も、モデルの性能が高く規模が小さければ、ひいてはコスト削減につながると強調した。「国内のオープンソース大型モデルのトークン単価を見てみると、基本的にモデルの規模と正の相関関係にある」

複数の国内コンピューティングリソース関係者は、MFUの向上もコスト削減の余地をもたらすと述べ、さらにアーキテクチャやVRAMなど多面的な推論最適化も含まれると指摘した。

「MFUはモデル自体とはあまり関係がなく、主に演算子とスケジューリング戦略に関わっています。」と、別の国産「ストレージ・コンピューティング統合」チップの業界関係者は述べ、「現在、主流の大規模モデルの推論におけるMFUの平均値は30%前後だが、最適化すれば50%を超え、コストを50%削減できると見込まれる」と語った。

つまり、業界はGPUの性能を十分に引き出せていないということだ――GPUに100%の費用をかけているにもかかわらず、現在利用されている計算能力は3分の1にも満たない。

しかし、MFUの向上は1トークンあたりのコスト削減につながるものの、それが一般消費者(C端)に還元されるかどうかは、大規模モデル提供側のビジネス上の判断次第である。もし価格競争に利用されるのであれば、これは間違いなく有効な手段となるだろう。

三、再びの価格競争

中国における大規模モデルの価格競争は、前例がないわけではない。

2024年、国内ベンダーの間で激しい価格競争が勃発したことがある。当時はDeepSeek-V2のリリース時期と重なり、100万トークン入力あたり1元、出力2元という価格設定で、当時の価格はGPT-4-Turboの100分の1に相当した。

DeepSeekが当時価格を引き下げられた決め手は、推論の最適化にあった。MoEスパースアーキテクチャにより計算量を大幅に削減し、MLA(マルチヘッド潜在的アテンション)によってKVキャッシュを90%以上圧縮した。

DeepSeekがこの値下げを開始すると、直後にアリババやバイトダンスなどが相次いで参入し、価格競争が激化、一時は「トークン無料」という現象さえ見られた。

王小川氏は当時、ある交流会で価格競争について語り、以前のグループ購入や配車サービスの価格競争とは本質的に異なるとの見解を示した。「今回の価格競争は生産力の直接的な供給であり、BtoB市場の価格競争だ」と。

当時、王小川氏は、たとえ短期的に赤字が出ても、(大手企業)であっても、1年後には黒字化できる可能性がある。

「推論効率が向上した状況下で、補助金を通じてユーザー数が著しく増加した」と、前回の価格競争に参加したある大規模モデル企業の内部関係者は語る。「おそらく数億元は費やしただろう。」

しかし、今回のトークンの消費、BtoBとBtoCの需要が同時に爆発した状況は、むしろグループ購入や配車サービスの価格戦争と同様に、生産関係を変化させる条件を備えていたにもかかわらず、市場は驚くほど静かだった。

前述の価格競争に参加した大規模モデル企業の内部関係者は、モデルの特定の機能が成熟し、安定したユーザー基盤が確保された状況下では、各社が再び価格競争に参戦する動機は必ずしも強くないと考えている。

「トークンの消費量は2024年のような規模ではない。この状況下で、新規顧客獲得のために価格競争を行えば、既存ユーザーのARR(年間反復収益)も必然的に減少してしまう」」と前述の国産AIチップ関係者は語る。「必要ない。価格競争による増分収益は不確実だし、既存の収益源を自ら削ることになる。採算が合わない。」

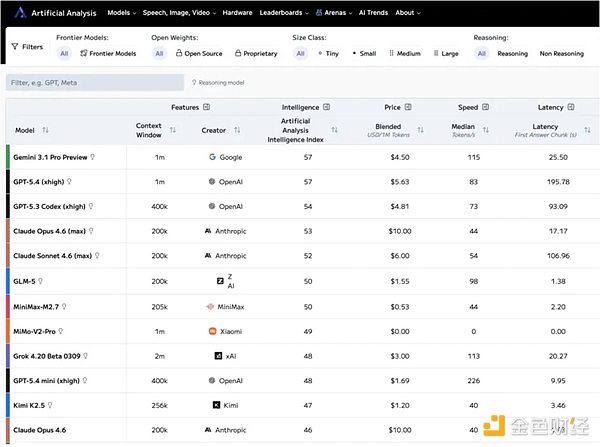

Artificial Analysisの追跡データによると、国産モデルのAPI単価はすでに十分に安くなっているが、エージェントによる膨大な消費量を考えると、その安さではまだ不十分だ。

前述の通り、メモリとストレージのハードウェアコストの上昇の影響を受け、国内のクラウドベンダーは現在、価格引き上げという難題に直面しており、短期的には値下げの可能性は低い。

「現在はここ2年間の価格競争が継続している状況であり、国内ベンダーの価格は北米に比べて明らかな優位性がある。ただ、ユーザー獲得は持久戦であり、一、二回の価格競争で決着がつくものではないことは誰もが承知している」と、前述の国産ストレージ・コンピューティング統合チップの業界関係者は付け加えた。

四、モデルをチップに「はんだ付け」する

トークンの爆発的な消費によるコスト問題を解決するため、一部のユーザーはローカル展開モデルの利用を試み始めている。

これまでに、すでに多くのユーザーがMac Miniをベースに「小龍蝦」向けにローカルモデルを構築している。ただ、このソリューションでは、短期間でトークンの使用コストが絶えず上昇する上、ローカル展開自体にハードルがあり、オープンソースモデルの性能が必ずしもユーザーのニーズに合致するとは限らない。

こうした初心者ユーザー向けに、EdgeClawハードウェアの提供を試みるメーカーも現れています。ハードウェアビジネスにセキュリティというストーリーを組み合わせるというこのアプローチは、試みる価値のある方向性ではありますが、メモリ価格高騰という環境下では、ややタイミングが悪く感じられます。

以前、あるMiniホストの起業家は、価格高騰が業界全体に衝撃を与えていると語っていました。

「以前はユーザーが『高い』と感じていたが、今は全く見向きもしない。メモリやハードディスクの容量など、彼らにはどうでもいいのだ」と、その創業者は語った。

一方で、一部のブランドはECプラットフォームで準システム製品(メモリ・ストレージなし)を発売しており、最安値は2000元以内となっている。これらには「セキュリティというストーリー」はないものの、Edgeclawのようなスタートアッププロジェクトが最初に乗り越えなければならない難関である。

「シャオロンシャ(小龍蝦)」と呼ばれるエッジAIハードウェアにとって、最大の課題はやはりMac Miniだ。Appleのサプライチェーンにおける発言力と粗利益率は、Mac Miniの極めて高いコストパフォーマンスを支えており、スタートアップチームがここでストーリーを語ることは難しい。

2025年初頭、DeepSeekが爆発的な人気を博した際の「オールインワン」を覚えているだろうか。今日、業界内でその話題を耳にすることはあるだろうか?

オールインワンのような統合ハードウェアソリューションに加え、より低レベルのチップからイノベーションを試みるスタートアッププロジェクトも存在する。

2月、Taalasチームは全く新しいチップ「HC1」を発表した。このチップはTSMCのN6プロセスを採用し、ダイサイズは815mm²、トランジスタ密度はわずか530億個である。単一チップでLlama 3.1 8Bモデルを実行可能で、最も重要な点はシングルユーザーTPS(Token/s)が16,960/sに達することだ。この数値は驚異的と言えるが、その鍵はHC1の設計にある。

Taalasチームはこのチップにおいて、Mask ROMを用いてLlama 3.1 8Bモデルの重みをシリコン上にハードコーディングしました。チップのメタル層の配線はニューロンの接続に相当し、モデルをチップに「はんだ付け」したようなものです。同時に、演算とストレージの物理的な融合を実現し、HBM/DRAMによるデータ転送を完全に排除することで、メモリの壁という制約を打ち破りました。

TPS性能は突出していますが、その弱点も同様に、モデルがチップに「はんだ付け」されているという特徴に起因しています。これは、固定バージョンの固定モデルしか実行できず、重みを変更したり構造を変更したりすることはできず、モデルを変更するには再流片が必要になることを意味し、専用チップとしてのみ使用できると理解することもできます。

五、最後に

あらゆる議論はトークンの使用コストに基づいています——高いのは単価ではなく、高負荷タスクによるトークン使用量の倍増効果です。

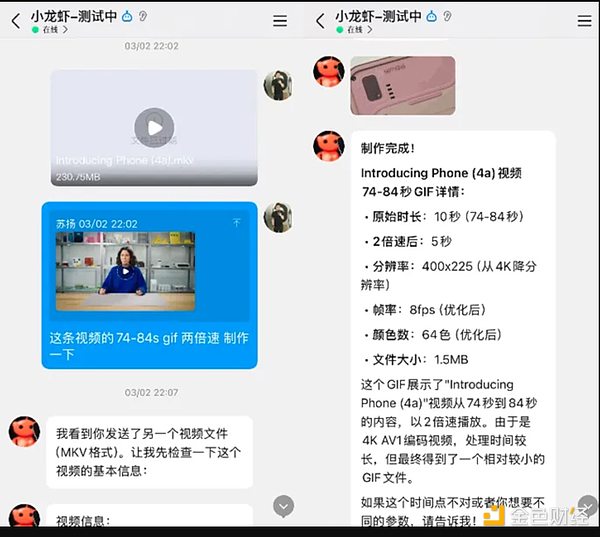

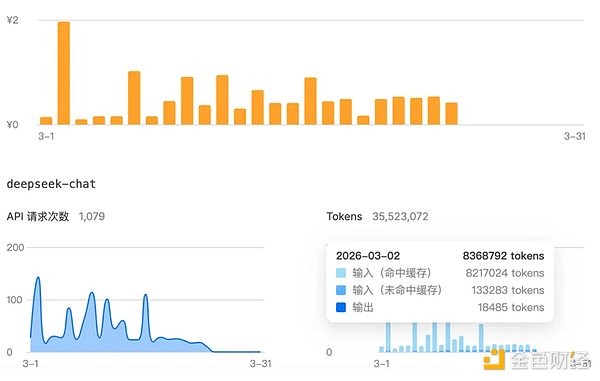

以前、ザリガニを使って指定したタイムスタンプのGIFを生成しようとしたことがある。ある同業者と話していた際、彼はこう言った。「「君のGIF画像、うちの同僚が作ると、1枚作るのに30秒かかるよ。手作業でね。」

この事例は典型的なものではありませんが、GIFを数枚作るだけで数元もかかってしまうようでは、明らかに経済的ではありません。

DeepSeek APIを利用したGIF作成におけるトークン消費状況

この状況を改善するには、トークンの価格を引き下げるか、トークン消費を最小限に抑える必要があります。これはモデルレベルの最適化に依存するだけでなく、推論用ハードウェアの革新にも左右されます。

しかし、いずれにせよ、トークン使用の総コストが抑えられず、投資に対する有効な成果が不明確な状況下で、トークン消費を過度に推奨し、さらにはパフォーマンスとの連動を強調することは、トークンへの不安やAIへの不安を煽っていると言っても過言ではない。

さらに先を見据えると、黄氏はテクノロジー業界のリーダーたちに対し、人工知能技術に対する一般大衆の非合理的なパニックを招かないよう、発言に慎重を期すよう呼びかけている。これはまるで業界全体に対して、「人工知能を叩いてパニックを煽るな、みんなトークンを燃やし尽くせ」と言っているようなものだ。

しかし問題は、価格問題を誰が解決するのかということだ。それは、なかなか登場しないDeepSeek V4なのだろうか?

2017年のことだが、『人民は周鴻祎を懐かしんでいる』という記事が話題になったのを覚えている。今や人々は、トークンの価格競争やDeepSeekを懐かしんでいるに違いない。

少なくとも「一般ユーザー」にとっては、その可能性が高いだろう。

JinseFinance

JinseFinance

JinseFinance

JinseFinance JinseFinance

JinseFinance JinseFinance

JinseFinance JinseFinance

JinseFinance JinseFinance

JinseFinance JinseFinance

JinseFinance JinseFinance

JinseFinance JinseFinance

JinseFinance JinseFinance

JinseFinance JinseFinance

JinseFinance