特定の人や特定の結果をメカニズムに書き込まない。

オープンソースで公に検証可能な実装

シンプルに保つ

あまり頻繁に変更しない

LLLM(またはAIエージェント)は0/4を満たします。モデルは必然的に、その学習プロセスにおいて、多くの人特有の、結果特有の選好を符号化します。例えば、主なLLMがアメリカでの生活よりもパキスタンでの生活を重視していることを示す最近の研究を見てください(!!)。.オープンウェイトにすることもできるが、これはオープンソースにはほど遠い。モデルの奥底にどんな悪魔が隠れているのか、私たちは本当に知らないのだ。LLMのコルモゴロフ的な複雑さは数百億ビットで、アメリカの法律(連邦法+州法+地方法)をすべて合わせたものにほぼ匹敵する。しかもAIは急速に進化しているので、3カ月ごとに変更しなければならない。

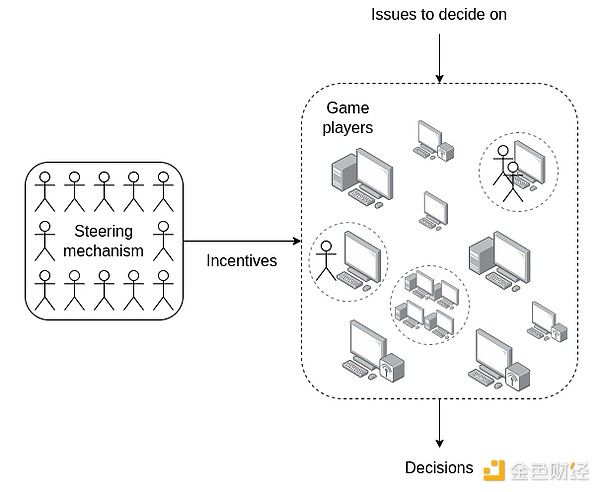

このため、多くの使用例で私が好んで探っているもう 1 つのアプローチは、単純なメカニズムをゲームのルールとし、AI をプレーヤーにすることです。ルールは比較的愚かな財産システムであり、エッジケースは判例をゆっくりと構築し調整する裁判システムによって決定され、すべての知性は「エッジ」で活動する起業家からもたらされる。

1人の「ゲーマー」は、LLMであったり、LLMの群れが相互に作用してさまざまなインターネットサービスを呼び出したり、さまざまなAIと人間の組み合わせであったり、その他多くの構成要素であったりします。 もしメカニズムのゴールが資金を提供するものを選択することであるなら、それはビットコインやイーサーのブロック報酬とできるだけ同じであるべきです。

このアプローチの利点は、次のとおりです:

単一のモデルをメカニズムに組み込むことを避けることができます。その代わり、多くの異なるプレーヤーやアーキテクチャで構成されるオープンな市場を得ることになる。オープンモデル、クローズドモデル、エージェントの群れ、人間とAIのハイブリッド、ボット、無限のサルなど、すべてがフェアなゲームです。

メカニズムはオープンソースです。そしてそれは、すでにかなりよく理解されているモデルです(例えば、政党や市場はこのように機能しています)

仕組みは単純なので、仕組みの設計者が自分の偏見を設計に組み込む方法は比較的少ないです

。

基礎となる参加者のアーキテクチャは、これからシンギュラリティまで3ヶ月ごとに再設計する必要があるにもかかわらず、メカニズムは変わらない。

指導メカニズムの目標は、参加者の根本的な目標を忠実に反映することです。少量の情報しか提供する必要はないが、質の高いものでなければならない。

このメカニズムは、答えを提案することとそれを検証することの間の非対称性を利用していると考えることができます。数独が解くのは難しいが、解答が正しいことを検証するのは簡単であるのと似ている。あなたは、(i)プレイヤーが「解答者」として行動するオープンな市場を作り、(ii)提案された解答を検証するというはるかに単純なタスクを実行する人間が運営するメカニズムを維持する。

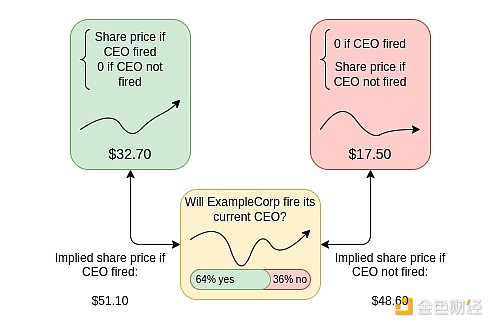

フーターキー

フーターキーとは、もともとロビン・ハンソンによって提案されたもので、「価値には投票するが、信念には賭ける」という意味である。投票メカニズムは、目標のセット(測定可能であれば、どのような目標でもよい)を選択し、それらをメトリックMに結合する。決定を下す必要があるとき(単純化のため、YES/NOとする)、条件付き市場を設定する:(i)YESとNOのどちらを選択するか、(ii)YESを選択した場合のMの値、それ以外はゼロ、(iii)NOを選択した場合のMの値、(iv)YESを選択した場合のMの値、それ以外はゼロに賭けるよう人々に求める。iii)NOを選んだ場合のMの値、それ以外はゼロ。これらの3つの変数で、市場がYESとNOのどちらをMの値にとってより好ましいと考えるかを決定することができます。

「企業の株価」(または暗号通貨の場合はトークン価格)は、理解しやすく測定しやすいため、最も一般的に引用される指標ですが、この仕組みは、月間アクティブユーザー数、特定のグループの自己申告幸福度の中央値、いくつかの定量化可能な分散型指標など、さまざまな指標をサポートできます。

フターキーはもともと、人工知能の時代より前に発明されました。しかし、Futarchyは前節で説明した「複雑なソルバー、シンプルなバリデーター」というパラダイムに非常に自然に適合しています。Futarchyのトレーダーは、AI(または人間+AIの組み合わせ)であることもできる。ソルバー」(予測市場トレーダー)の役割は、提案された各プランが将来の指標の値にどのような影響を与えるかを判断することです。これは難しい。ソルバーが正しければ儲かるし、間違っていれば損をする。検証者(指標に投票し、指標が「操作」されていたり古くなっていることに気づいたら調整し、将来のある時点で指標の実際の値がどうなるかを判断する人)は、「この指標の現在の値はいくらか」という単純な質問に答えるだけでよい。"

人間の判断の精緻化

人間の判断の精緻化は、次のように機能するメカニズムの一種です。答えが必要な質問が多数(百万と考える)あります。

プロジェクトやタスクへの貢献に対して、このリストの各人にどれだけのクレジットを与えるべきか?

これらのコメントのうち、ソーシャルメディアプラットフォーム(またはサブコミュニティ)のルールに違反しているものはどれですか?

これらの指定されたイーサアドレスは、どれが本当のユニークな人々を表していますか?

これらの物理的なオブジェクトのうち、環境の美観にプラスまたはマイナスに貢献しているのはどれでしょうか?

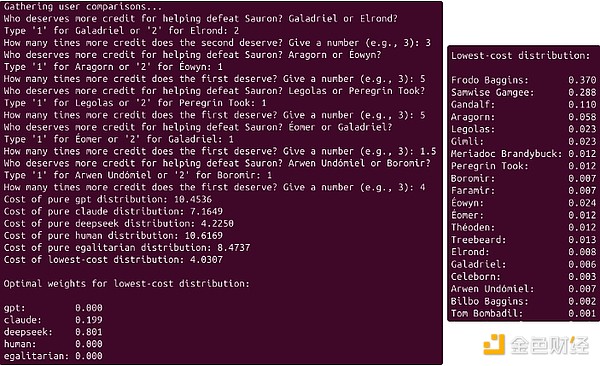

あなたは、これらの質問に答えられるチームを持っていますが、それぞれの答えに多くの労力を費やしています。チームには、いくつかの質問に答えることだけを求めます(たとえば、リストの合計が100万項目ある場合、チームはそのうちの100項目にしか答えないかもしれません)。チームに間接的な質問をすることもできます。「アリスは総クレジットの何パーセントを得るべきか」と聞く代わりに、「アリスは総クレジットの何パーセントを得るべきか」と聞いてください。アリスは総クレジットの何パーセントを得るべきか」と尋ねる代わりに、「アリスとボブ、どちらがより多くのクレジットを得るべきか、何倍多く得るべきか」と尋ねてください。その代わりに、「アリスとボブのどちらがより多くの信用を得るべきか、そして何倍以上か」と尋ねてください。陪審員メカニズムを設計する際には、充当委員会、裁判所(評決の価値を決定する)、鑑定など、試行錯誤された実世界のメカニズムを再利用することができます。もちろん、陪審員参加者自身が答えを見つけるのを助けるために、新しいAI研究ツールを使用することもできます。

そして、質問セット全体に対する数値的な答えのリストを誰でも提出できるようにします(たとえば、リスト全体の各参加者がどれだけの信用を受けるべきかの見積もりを提供する)。参加者はこのタスクに人工知能を使うことが推奨されているが、人工知能、人間とコンピュータのハイブリッド、インターネット検索にアクセスでき、自律的に他の人間やAI労働者を雇用できるAI、サイバネティックで強化されたサルなど、どのような技術を使ってもよい。

フルリストの提供者と陪審員の両方が回答を提出すると、フルリストは陪審員の回答と照合され、陪審員の回答と最も適合するフルリストの組み合わせが最終的な回答として使用されます。

洗練された人間の判断メカニズムは、フルターキーとは異なりますが、いくつかの重要な共通点があります:

フルターキーでは。「解答者」は予測を行い、その予測の根拠となる「実際のデータ」(解答者に報酬を与えたり、ペナルティを与えたりするために使用される)は、審査員によって運営されるメトリクスを出力する予測マシンである。

洗練された人間の判断では、「解答者」は多数の質問に対する答えを提供し、彼らの予測の根拠となる「実際のデータ」は、陪審員によって提供されたこれらの質問の小さなサブセットに対する高品質の答えです。

クレジット割り当てのための洗練された人間の判断のおもちゃの例です。Pythonコードはこちら。このスクリプトでは、陪審員としての役割を求め、AIが生成した(そして人間が生成した)完全なリストがコードにあらかじめ含まれています。このメカニズムは、審査員の答えに最も合う完全なリストの線形結合を特定する。この場合、勝利の組み合わせは、0.199 * Claude の回答 + 0.801 * Deepseek の回答です。この組み合わせは、個々のモデルよりも審査員の回答によく一致します。これらの係数は、提出者に与えられる報酬にもなります。

この「サウロンに勝つ」例では、「人間がハンドルを握る」という側面が2か所に表れています。第一に、質の高い人間の判断が各問題に適用されていますが、これはまだ「技術主義的な」パフォーマンス評価者としての審査員を利用しています。第二に、「サウロンを倒す」ことが正しい目標なのかどうかを決める暗黙の投票メカニズムがある(例えば、サウロンと同盟を結ぼうとしたり、和平の譲歩として重要な川より東の領土をすべて与えたりするのではなく)。例えば、分散型のソーシャルメディアプラットフォーム(またはサブコミュニティ)で、審査員の仕事がランダムに選ばれたフォーラムの投稿に、コミュニティのルールを守っているか守っていないか印をつけることだと想像してみてください。

専門対バイアスのトレードオフ:熟練した陪審員は、通常、専門分野に特化しています。彼らに評価を選ばせることで、より質の高い意見を得ることができます。一方、選択しすぎると、バイアス(審査員は、自分と関係のある人のコンテンツを好む)やサンプリングの弱点(一部のコンテンツは組織的に評価されない)につながる可能性があります

反グッドハート:AIの仕組みを「利用」しようとするコンテンツが存在します。例えば、投稿者が印象的に見えるが役に立たないコードを大量に生成するなどです。つまり、審査員はこれを検知することができますが、静的なAIモデルは、懸命に努力しない限り検知することができません。この振る舞いを捕捉する1つの可能な方法は、チャレンジ・メカニズムを追加することである。チャレンジ・メカニズムでは、個人がそのような試みにフラグを立てることができ、審査員がそれを判断することを保証することができる(その結果、AI開発者に、それらが正しく捕捉されるようにするインセンティブを与えることができる)。陪審員が同意すれば内部告発者は報われ、同意しなければ罰金が支払われる。

どのようなスコアリング関数を使うのですか?現在のディープファンディングの試験運用で使われているアイデアの1つは、陪審員に "AとBのどちらがより多くの信用を得るべきか、またどれだけ多く得るべきか "を尋ねるというものです。.スコアリング関数は、score(x) = sum((log(x[B]) - log(x[A]) - log(juror_ratio)) ** 2 for (A, B, juror_ratio) in jury_answers)です。そして、(対数空間で)距離の2乗に比例するペナルティを加える。これは、採点関数には豊富な設計空間があり、採点関数の選択は、陪審員にどの質問をするかの選択に関連していることを示すためです。

フルリストの提出者にはどのように報いるのですか?理想的には、独占的なメカニズムを避けるために、複数の参加者にゼロ以外の報酬を頻繁に与えたいところですが、参加者が同じ(または少し修正された)回答セットを複数回提出することによって報酬を増やすことができないという特性も満たしたいところです。1つの有望なアプローチは、陪審員の答えに最も合う答えの完全なリストの線形結合を直接計算し(合計が1になる非負の係数を持つ)、同じ係数を使用して報酬を分割することです。他の方法もあるかもしれません。

一般的に、目標は、効果的であることが知られており、バイアスを最小限に抑え、時の試練に耐えてきた人間の判断メカニズムを使用することです(たとえば、裁判システムの敵対的な構造には、多くの情報を持っているがバイアスのかかっている論争の2つの側と、少しの情報を持っているがバイアスはかかっていないかもしれない裁判官が含まれる可能性があることを想像してみてください)。これは、法学修士課程の「蒸留」が機能する方法に似ている)。

ディープファイナンス

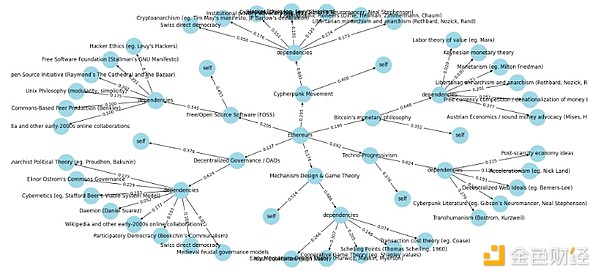

ディープファイナンスとは、「Xのクレジットの何パーセントがYに属するか」というグラフの上側の重みを埋める問題に、洗練された人間の判断を適用することです。

これを説明する最も簡単な方法は、わかりやすい例です。

2レベルのディープファイナンスの例の出力:イーサのアイデアの起源。Python コードはこちらをご覧ください。

ここでのゴールは、イーサへの哲学的貢献に対するクレジットを割り当てることです。

ここに示した詳細な資金調達ラウンドのシミュレーションでは、暗号パンク運動が20.5%、技術進歩主義が9.2%となっています。

それぞれのノードで、「どの程度までが独自の貢献で(したがって、それ自体が信用に値する)、どの程度までが他の上流からの影響の組み換えなのか?クリプト・パンク・ムーブメントの場合、40パーセントが新しく、60パーセントが依存したものだ。

次に、これらのノードの上流にある影響を見ることができます。リバタリアン的な小さな政府主義とアナーキズムは、クリプト・パンク・ムーブメントの17.3パーセントを獲得していますが、スイスの直接民主主義は5パーセントしか獲得していません。

しかし、リバタリアン小政治主義とアナーキズムはビットコインの通貨哲学にも影響を与えたので、2つの点でイーサの哲学に影響を与えたことに注意してください。

リバタリアン・ミナキズムとアナーキズムのイーサへの貢献の総シェアを計算するには、各パスのエッジを掛け合わせ、パスを足す必要があります。Etherの哲学に貢献したすべての人々に報いるために100ドルを寄付しなければならないとすると、この深い資金調達ラウンドのシミュレーションに基づき、リバタリアン・ミナキストとアナーキストは4.66ドルを受け取ることになる。

このアプローチは、過去の研究の上に構築され、高度に構造化された分野を対象としています。アカデミア(引用グラフを考えてみよう)とオープンソースソフトウェア(ライブラリの依存関係とフォークを考えてみよう)は、2つの自然な例です。

よく機能するディープファンディングシステムの目標は、グローバルグラフを作成し、維持することです。そこでは、特定のプロジェクトを支援することに関心のある資金提供者は誰でも、そのノードを表すアドレスに資金を送ることができ、資金はグラフのエッジの重みに基づいて、その依存関係(および再帰的にその依存関係など)に自動的に伝わります。

組み込みのディープファンディングメカニズムを使ってトークンを発行する分散型プロトコルを想像してみてください。プロトコルは自動的にトークンを発行し、自己対応ノードにトークンを預ける。そうすることで、プロトコルは、ビットコインやイーサのブロック報酬が特定のタイプの貢献者(マイナー)にどのように報酬を与えるかを彷彿とさせるように、その直接的および間接的な貢献者すべてにプログラム的に報酬を与えます。エッジの重みに影響を与えることで、審査委員会は価値のある貢献のタイプを継続的に定義することができる。この仕組みは、マイニングや売却、一度限りのエアドロップに代わる、分散型で長期的に持続可能な代替手段として機能する。

Increasing privacy

多くの場合、上の例のような質問に対して適切な判断を下すには、プライベートな情報(組織の内部チャット、コミュニティメンバーから秘密裏に提出された情報など)にアクセスする必要があります。特に小規模な環境では、「単一のAIのみを使用する」ことの利点の1つは、AIが情報にアクセスすることが、誰にでも公開されるよりも受け入れられやすいということです。

このような状況で洗練された人間の判断やディープファンディングを機能させるためには、暗号を使ってAIに個人情報へのアクセスを安全に与えるようにすればよい。多人数パーティコンピューティング(MPC)、完全同型暗号化(FHE)、信頼された実行環境(TEE)、または同様のメカニズムを使用して、プライベートな情報を利用できるようにすることです。

これを行うのであれば、メカニズムのセットをAIモデル(人間やAIと人間の組み合わせではなく、人間がデータを見ることはできないため)に限定し、特定の基板(MPC、FHE、信頼されたハードウェアなど)で実行されるモデルに限定する必要があります。主要な研究の方向性は、最近の過去において意味のある十分な効果があった実用的なバージョンを特定することである。

Benefits of the Engine + Steering Wheel Design

このような設計には多くの望ましい利点があります。圧倒的に重要な利点は、人間の投票者に方向性をコントロールさせるDAOの構築を可能にすることですが、決定で過負荷になることはありません。全員がN個の決断を下す必要はないが、決断を下す以上の力を持ち(通常どのように機能するかを委譲する)、直接表現するのが難しい豊かな嗜好を誘発することができる妥協点に到達する。

さらに、このようなメカニズムにはインセンティブを平滑化する特性があるようです。

ここでの難読化と拡散という用語は暗号学から取られたもので、暗号とハッシュ関数のセキュリティの重要な属性です。

今日の現実世界におけるインセンティブ平滑化の好例は、法の支配です。「アリスの会社に2億ドルを与える」、「ボブの会社に1億ドルの罰金を科す」などの形で定期的に行動を起こす代わりに、政府の上層部は、多数の参加者に均等に適用されるように設計されたルールを採用することによって行動を起こします。そうではなく、多数の参加者に均等に適用されるように設計されたルールを採用し、それを別の参加者が解釈するのである。このアプローチがうまく機能すれば、賄賂やその他の汚職の利益が大幅に減少するという利点がある。それが(実際にはしばしばそうであるように)破られると、これらの問題はすぐに大きく拡大する。

人工知能は明らかに将来の重要な一部となり、必然的に将来のガバナンスの重要な一部となるでしょう。しかし、AIを統治に関与させる場合、明らかなリスクがある。AIには偏りがあり、訓練中に意図的に堕落させることができる。また、AI技術は急速に発展しているため、「AIに責任を負わせる」ということは、実際には「AIのアップグレードを担当する人々に責任を負わせる」ということになりかねない。".洗練された人間の判断は、人間のコントロールという民主主義を維持しながら、オープンで自由市場的な方法でAIの力を活用することを可能にする、別の道を提供する。

Miyuki

Miyuki

Miyuki

Miyuki Brian

Brian Alex

Alex Brian

Brian Weiliang

Weiliang Miyuki

Miyuki Brian

Brian Weiliang

Weiliang Miyuki

Miyuki Brian

Brian