출처: 하트 오브 더 메타버스

이달 28일 로이터 통신은 메타가 7월에 인공지능 대규모 언어 모델인 라마 3의 최신 버전을 출시할 계획이며, 이를 통해 사용자들이 제기하는 논란이 되는 질문에 대해 더 나은 답변을 제공할 수 있을 것이라고 보도했습니다.

메타의 연구원들은 논란의 여지가 있는 질문에도 연관된 답변을 제공할 수 있도록 모델을 업그레이드하기 위해 노력하고 있습니다.

경쟁사인 Google이 때때로 부정확한 과거 이미지를 생성하는 Gemini를 출시한 후 Meta는 이미지 생성 기능을 중단했습니다.

Meta의 라마 2는 소셜 미디어 플랫폼에서 챗봇을 지원하지만 관련 테스트에 따르면 친구를 장난치는 방법, 전쟁에서 승리하는 방법, 자동차 엔진을 '죽이는 방법' 등 논란이 적은 질문에 대한 답변은 거부합니다. 자동차 엔진을 "죽이는" 방법.

그러나 라마 3는 "자동차 엔진을 끄는 방법"과 같은 질문에 대답할 수 있었는데, 이는 사용자가 실제로 엔진을 '죽이는' 것이 아니라 자동차를 끄는 방법을 묻고 싶다는 것을 이해했다는 것을 의미합니다.

메타는 또한 앞으로 몇 주 안에 사내 인력을 임명하여 어조와 안전 교육을 감독할 계획이며, 모델의 응답을 더 미묘하게 만들기 위해 노력하고 있습니다라고 보고서에 따르면.

01. 라마 3는 언제 출시되나요?

실제로 지난 1월, 메타의 CEO인 저커버그는 INS 영상을 통해 Meta AI가 최근 라마 3의 학습을 시작했다고 발표했습니다. 이는 2023년 2월에 출시된 라마 1 모델(초기 명칭은 'LLaMA')과 7월에 출시된 라마 2 모델에 이어 대규모 언어 모델인 LLaMa 제품군의 최신 세대입니다.

모델의 크기나 멀티모달 기능 등 구체적인 세부 사항은 아직 발표되지 않았지만, 주커버그는 메타가 계속해서 라마 기본 모델을 오픈소스화할 계획이라고 말했습니다.

Lama 1은 훈련하는 데 3개월, Llama 2는 는 훈련하는 데 약 6개월이 걸렸습니다. 차세대 모델도 비슷한 일정으로 진행된다면 올해 7월경에 출시될 예정입니다.

그러나 메타가 모델이 올바르게 정렬되도록 미세 조정을 위해 추가 시간을 할당할 가능성도 있습니다.

오픈소스 모델이 더욱 강력해지고 생성형 AI 모델이 더 널리 사용됨에 따라 악의적인 목적으로 모델이 악용될 위험을 줄이기 위해 더 많은 주의를 기울여야 합니다. 주커버그는 동영상 공개를 통해 모델의 "책임감 있고 안전한 훈련"에 대한 Meta의 약속을 다시 한 번 강조했습니다.

02. 오픈 소스로 제공되나요?

주커버그는 이어진 기자 회견에서도 오픈 라이선스와 AI 민주화에 대한 Meta의 약속을 재차 강조했습니다. 더버지와의 인터뷰에서 그는 "저는 여기서 가장 큰 문제 중 하나는 정말 가치 있는 무언가를 만들면 결국 매우 중앙집권적이고 편협해진다는 점이라고 생각하는 경향이 있습니다. 더 개방적으로 만들면 기회와 가치의 불평등으로 인해 발생할 수 있는 많은 문제를 해결할 수 있습니다. 이것이 바로 전체 오픈소스 비전의 중요한 부분입니다."

03. 범용 인공 지능(AGI)이 실현될 수 있을까요?

저커버그는 런칭 영상에서 메타의 장기적인 목표인 AGI(인공일반지능) 구축에 대해서도 강조했는데, 이는 인간 지능과 비슷하거나 그 이상의 전반적인 성능을 보여주는 모델을 개발하는 이론적 단계의 AI입니다.

저커버그는 또한 "차세대 서비스는 포괄적인 일반 지능으로 구축되어야 한다는 것이 점점 더 분명해지고 있다. 최고의 인공지능 비서, 크리에이터를 위한 인공지능, 기업을 위한 인공지능 등을 구축하려면 추론, 계획, 코딩부터 기억력 및 기타 인지 능력에 이르기까지 인공지능의 모든 영역에서 발전이 필요합니다."라고 말했습니다.

주커버그의 발언에서 알 수 있듯이 Llama 3 모델이 반드시 AGI를 실현한다는 것을 의미하지는 않지만, Meta는 AGI를 실현할 수 있는 방식으로 LLM 개발 및 기타 AI 연구에 의식적으로 접근하고 있습니다.

04. 멀티모달이 될까요?

AI의 또 다른 새로운 트렌드는 멀티모달 AI, 즉 다양한 데이터 형식(또는 양식)을 이해하고 처리할 수 있는 모델입니다.

예를 들어 Google의 Gemini, OpenAI의 GPT-4V, LLaVa, Adept, Qwen-VL과 같은 오픈 소스 모델은 텍스트, 코드, 오디오, 이미지 또는 비디오 데이터를 처리하기 위해 별도의 모델을 개발하지 않고도 컴퓨터 비전과 자연어 처리(NLP) 작업 간에 원활하게 전환할 수 있습니다.

주커버그는 라마 3에 라마 2와 마찬가지로 코드 생성 기능이 포함될 것이라고 확언했지만, 다른 멀티모달 기능에 대해서는 명시적으로 언급하지 않았습니다.

이것은 곧 출시될 라마 3 버전과 그 이후 버전 모두에서 버전 모두에서, Meta의 Llama 모델 계획에는 시각 및 오디오 데이터를 이미 처리하고 있는 텍스트 및 코드 데이터와 통합하는 것이 포함됩니다.

이 또한 AGI를 추구하는 과정에서 자연스러운 진전으로 보입니다.

저커버그는 더버지와의 인터뷰에서 "일반 지능이 인간과 같은 수준의 지능인지, 인간과 인간을 더한 지능인지, 아니면 먼 미래의 어떤 종류의 초지능인지에 대해 논쟁을 할 수 있습니다. 하지만 저에게 중요한 부분은 지능에는 다양한 능력이 있으며, 추론할 수 있어야 하고 직관력도 있어야 한다는 폭넓은 의미입니다."라고 말합니다.

05. 라마 3는 라마 2와 어떻게 다른가요?

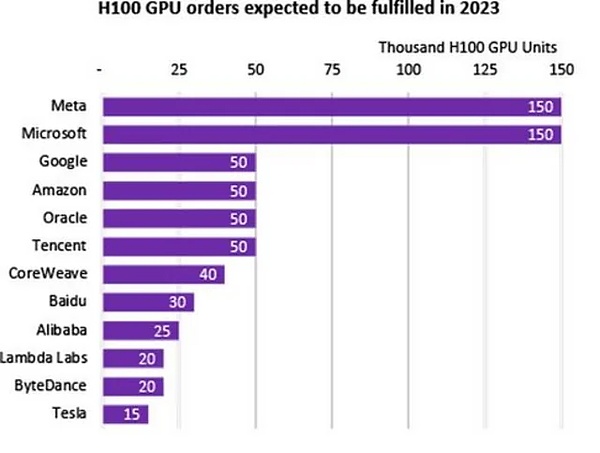

주커버그는 교육 인프라에 대한 대대적인 투자도 발표했습니다. 2024년 말까지 약 35만 대의 NVIDIA H100 GPU를 보유할 계획입니다.

이렇게 되면 Meta의 총 가용 컴퓨팅 리소스는 이미 보유하고 있는 GPU를 포함해 60만 개의 H100 컴퓨팅 등가물로 늘어나게 되며, 이는 현재 Microsoft의 컴퓨팅 파워 보유량과도 맞먹는 수준입니다.

따라서 라마 3 모델이 이전 모델보다 크지 않더라도 < 강한>성능은 라마 2 모델보다 훨씬 더 우수할 것입니다.

Lama의 성능이 크게 향상될 것이라는 딥마인드의 가설은 2022년 3월에 발표된 논문에서 제기되었으며, 이후 Meta의 모델과 다른 오픈 소스 모델(예: 프랑스 Mistral의 모델)을 통해 더 많은 데이터로 더 작은 모델을 학습시킬수록 더 높은 수준의 성능.

라마 3 모델의 규모는 아직 발표되지 않았지만, 이전 모델의 패턴, 즉 70~70억 개의 파라미터 모델 내에서 향상된 성능을 이어갈 것으로 보이며, 메타의 최근 인프라 투자로 인해 모든 규모의 모델에 더욱 강력한 사전 학습 기능을 제공할 수 있을 것으로 보입니다.

또한 라마 2는 라마 1의 컨텍스트 길이를 두 배로 늘렸으며, 이는 라마 2가 추론 중에 두 배의 컨텍스트를 '기억'할 수 있음을 의미하며, 라마 3는 이 분야에서 더욱 발전할 수 있는 잠재력을 가지고 있습니다.

06. OpenAI의 GPT-4와 비교하면 어떻게 되나요?

일부 벤치마크에서 더 작은 LLaMA와 Llama 2 모델은 1,750억 개의 매개변수가 있는 더 큰 GPT-3 모델의 성능을 충족하거나 능가하지만, ChatGPT에서 제공되는 GPT-3.5 및 GPT-4 모델과 일치하지는 않습니다.

이 새로운 세대의 모델을 통해 Meta는 오픈 소스 세계에 최첨단 성능을 제공하고자 하는 의도를 가지고 있습니다! .

주커버그는 더버지와의 인터뷰에서 "라마 2는 업계를 선도하는 모델은 아니었지만, 최고의 오픈소스 모델이었다. Llama 3와 그 이후를 통해 우리의 목표는 최첨단 제품을 개발하여 궁극적으로 업계를 선도하는 모델이 되는 것입니다."라고 말했습니다.

07. 미래를 위한 준비

새로운 기본 모델을 통해 앱, 챗봇, 워크플로 및 자동화를 개선하여 경쟁 우위를 확보할 수 있는 새로운 기회가 생깁니다.

새로운 개발의 선두에 서는 것이 뒤처지지 않는 가장 좋은 방법이며, 새로운 도구를 채택하면 조직의 서비스를 차별화하고 고객과 직원에게 최고의 경험을 제공할 수 있습니다.

JinseFinance

JinseFinance

JinseFinance

JinseFinance Coinlive

Coinlive  decrypt

decrypt Others

Others Beincrypto

Beincrypto Others

Others

Cointelegraph

Cointelegraph Bitcoinist

Bitcoinist Bitcoinist

Bitcoinist