Trong những tháng gần đây, trí tuệ nhân tạo lần lượt xuất hiện. Chúng ta thường xuyên thấy những từ sau trên các tiêu đề tin tức: AI bị rò rỉ mã công ty và không thể xóa được; Phần mềm AI Nó đã vi phạm quyền riêng tư về thông tin khuôn mặt của người dùng, một sản phẩm mẫu lớn nào đó đã bị lộ các cuộc trò chuyện riêng tư...v.v.

Tuy nhiên, một vấn đề sâu sắc hơn có thể đã tồn tại một cách âm thầm từ rất lâu trước khi cơn sốt mô hình quy mô lớn nổ ra: hàng giả sâu được gọi là Deepfake sự xuất hiện của công nghệ có thể sử dụng học sâu để ghép liền mạch bất kỳ ai trên thế giới vào video hoặc ảnh mà họ chưa bao giờ thực sự tham gia đã dẫn đến sự phổ biến của thuật ngữ "AI thay đổi khuôn mặt" vào năm 2018.

Cho đến hôm nay, năm 2024, mối đe dọa tiềm tàng từ Deepfake vẫn chưa được ngăn chặn một cách hiệu quả.

Lừa đảo trí tuệ nhân tạo đã trở thành hiện thực, gây lo ngại.

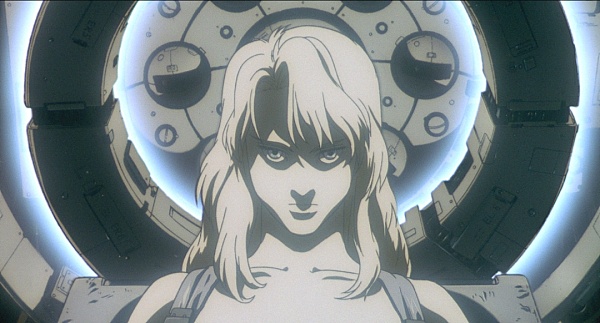

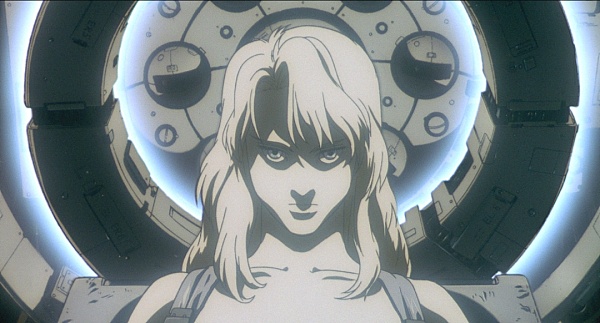

Bộ phim hoạt hình "Ghost in the Shell" phát hành năm 1995 mô tả một cốt truyện như vậy: một trí tuệ nhân tạo tên là "Bậc thầy múa rối" biết cách giả vờ là những danh tính khác và khiến con người bối rối, đồng thời kiểm soát suy nghĩ và hành vi của con người, khả năng này khiến nó trở nên vô hình trên Internet và không gian ảo. Mặc dù kịch bản này chỉ xuất hiện trong phim nhưng nếu bạn đã bị ảnh hưởng bởi những lời cảnh báo của những người như Elon Musk hay Sam Altman trong một thời gian dài, bạn chắc chắn sẽ tưởng tượng rằng một khi trí tuệ nhân tạo nếu không được kiểm soát, nó có thể tiến hóa thành một "Skynet"- phong cách đe dọa nhân loại.

"Ghost in the Shell" Bậc thầy múa rối

May mắn thay, đây là mối quan tâm nhìn chung không được phần lớn các nhà phát triển trí tuệ nhân tạo công nhận. Nhiều gã khổng lồ về trí tuệ nhân tạo trong giới học thuật, chẳng hạn như Joseph Sifakis, người đoạt giải Turing, tiết lộ trong các cuộc phỏng vấn rằng họ khinh miệt ý tưởng này. Hiện tại, chúng ta chưa có trí tuệ nhân tạo có thể lái xe an toàn trên đường chứ đừng nói đến trí tuệ con người.

Nhưng điều này không có nghĩa là trí tuệ nhân tạo là vô hại.

AI có mọi tiềm năng để trở thành một trong những công cụ có sức tàn phá mạnh nhất mà con người từng tạo ra. Về vấn đề này, một giám đốc tài chính không may gặp phải một vụ lừa đảo trí tuệ nhân tạo gần đây đã hiểu rất sâu về nó, số tiền thiệt hại lên tới 25 triệu đô la Mỹ, tội ác không xảy ra ở bên kia đại dương mà là ở Đặc khu Hồng Kông. Khu hành chính rất gần với chúng tôi. Trước những tội ác trí tuệ nhân tạo như vậy, chúng ta có biện pháp đối phó nào không?

Thay đổi ngày

Vào ngày 5 tháng 2, theo truyền thông Hong Kong Radio Television Hong Kong, một giám đốc tài chính giấu tên đã nhận được một email tự xưng là từ đồng nghiệp người Anh, đề xuất một thỏa thuận bí mật. Giám đốc tài chính không phải là người cả tin và bị nghi ngờ lừa đảo ngay từ cái nhìn đầu tiên.

Tuy nhiên, người gửi nhất quyết sắp xếp một cuộc họp video qua Zoom. Khi giám đốc tài chính Hồng Kông tham gia hội nghị, ông đã nhìn thấy và nghe thấy một số gương mặt quen thuộc. Những gương mặt và tiếng nói của đồng nghiệp. Sau khi loại bỏ những nghi ngờ, họ bắt đầu chuẩn bị giao dịch và làm theo hướng dẫn của các đồng nghiệp người Anh, cuối cùng họ chuyển 200 triệu đô la Hồng Kông (hiện tại là khoảng 184 triệu nhân dân tệ) trong 15 lần đến 5 lần. các tài khoản địa phương.

Phải đến khi một nhân viên khác xác nhận với trụ sở chính thì sự bất thường mới được phát hiện. hóa ra văn phòng ở Anh chưa có Giao dịch này đã được thực hiện và không nhận được khoản thanh toán nào. Hãy tưởng tượng vị giám đốc tài chính vô cùng hối hận và tội lỗi sau khi biết mình bị lừa. Sau khi điều tra, người ta phát hiện ra rằng người thực sự tham gia hội nghị video là giám đốc tài chính Hồng Kông, còn lại là giám đốc tài chính người Anh và các đồng nghiệp khác được mô phỏng bằng công nghệ trí tuệ nhân tạo Deepfake.

Chỉ với một lượng nhỏ dữ liệu có sẵn công khai, một bộ chương trình trí tuệ nhân tạo cơ bản và sự lừa dối xảo quyệt, điều này nhóm Kẻ lừa đảo đã có đủ tiền mặt để mua một chiếc siêu du thuyền sang trọng.

Lúc này, có thể một số người sẽ chế nhạo câu chuyện này và cho rằng giám đốc tài chính quá cẩu thả. Rốt cuộc thì Deepfake mà chúng ta thường thấy trên Douyin và B -station là "toàn bộ", "Video trực tiếp" rất dễ phân biệt giữa thật và giả, nhưng rất khó để phân biệt giả với chính hãng.

Tuy nhiên, tình hình thực tế có thể không đơn giản như vậy. Nghiên cứu mới nhất cho thấy rằng mọi người thực sự không thể xác định được deepfake một cách đáng tin cậy, điều đó có nghĩa là hầu hết mọi người chỉ nhận ra deepfake trên nhiều mặt trực giác những gì bạn nhìn thấy và nghe thấy. Rắc rối hơn nữa, nghiên cứu còn tiết lộ rằng mọi người có nhiều khả năng nhầm lẫn các video deepfake là thực tế hơn là giả mạo. Nói cách khác, công nghệ deepfake ngày nay tinh vi đến mức có thể dễ dàng đánh lừa người xem.

Học sâu + Giả mạo

< p style="text-align: left;">Deepfake là sự kết hợp của hai từ "deep-learning" và "fake".

Do đó, yếu tố cốt lõi của công nghệ Deepfake là học máy, giúp có thể nhanh chóng tạo ra nội dung giả mạo sâu với chi phí thấp hơn. Để tạo một video giả mạo về một người nào đó, trước tiên, người sáng tạo sẽ huấn luyện một mạng lưới thần kinh bằng cách sử dụng một lượng lớn các video clip thực về người đó, mang lại cho mạng "sự hiểu biết" thực tế về cách người đó nhìn từ nhiều góc độ và trong các điều kiện ánh sáng khác nhau. ". Sau đó, người sáng tạo kết hợp mạng đã được đào tạo với các kỹ thuật đồ họa máy tính để áp đặt bản sao của người này lên người khác.

Nhiều người tin rằng một lớp thuật toán deep learning được gọi là mạng đối thủ tổng quát (GAN) sẽ trở thành động lực chính cho sự phát triển của công nghệ Deepfake trong tương lai. Hình ảnh khuôn mặt do GAN tạo ra gần như không thể phân biệt được với khuôn mặt thật. Báo cáo điều tra đầu tiên về lĩnh vực deepfake dành một chương cho GAN, hứa hẹn rằng chúng sẽ cho phép bất kỳ ai tạo ra nội dung deepfake phức tạp.

Vào cuối năm 2017, một người dùng Reddit tên là "deepfakes" đã giả mạo nhiều- các ngôi sao điện ảnh nổi tiếng và thậm chí cả các nhân vật chính trị. Những khuôn mặt được sử dụng để tạo video khiêu dâm và xuất bản chúng trên web. Những video giả mạo như vậy ngay lập tức lan truyền khắp mạng xã hội, sau đó, một số lượng lớn video Deepfake mới bắt đầu xuất hiện, nhưng phải đến vài năm sau, công nghệ phát hiện tương ứng mới dần xuất hiện.

Tuy nhiên, vẫn có những ví dụ tích cực. Deepfakes lần đầu tiên được khán giả biết đến trên màn ảnh khi cố diễn viên Paul Walker được “hồi sinh” trong “Fast and Furious 7”. Bộ phim Tết Nguyên đán 2023 "Trái đất lang thang 2" cũng sử dụng công nghệ CG để tái hiện nhân vật "Chú Tất" Ng Man-tat nổi tiếng. Nhưng trước đây, phải mất cả một năm của cả một studio chuyên nghiệp để tạo ra những hiệu ứng này.

Ngày nay, quá trình này nhanh hơn trước.Ngay cả những người bình thường không biết gì về công nghệ cũng có thể tạo ra "sự thay thế AI" trong vài phút. Face " băng hình.

Những lo ngại về deepfake đã dẫn đến sự gia tăng các biện pháp đối phó. Trở lại năm 2020, các nền tảng truyền thông xã hội bao gồm Meta và X đã cấm các sản phẩm deepfake tương tự khỏi mạng của họ. Các chuyên gia cũng được mời phát biểu về các phương pháp phòng thủ tại các hội nghị đồ họa và thị giác máy tính lớn.

Bây giờ tội phạm Deepfake đã bắt đầu lừa dối thế giới trên quy mô lớn, chúng ta nên chống trả như thế nào?

Nhiều phương tiện để chống lại rủi ro Deepfake

Chiến lược chính là "đầu độc" trí tuệ nhân tạo. Để tạo ra một bản deepfake chân thực, kẻ tấn công cần lượng dữ liệu khổng lồ, bao gồm nhiều ảnh của người mục tiêu, nhiều video clip cho thấy những thay đổi trên nét mặt của họ và các mẫu giọng nói rõ ràng. Hầu hết các kỹ thuật deepfake đều sử dụng tài liệu được các cá nhân hoặc doanh nghiệp chia sẻ công khai trên mạng xã hội.

Tuy nhiên, hiện nay có những chương trình như Nightshade và PhotoGuard có thể sửa đổi những tệp này mà không ảnh hưởng đến nhận thức của con người, do đó khiến việc làm giả sâu không hiệu quả. Ví dụ: Nightshade sử dụng quá trình xử lý sai lệch để khiến trí tuệ nhân tạo đánh giá sai các vùng khuôn mặt trong ảnh, việc xác định sai này có thể phá vỡ cơ chế học tập của trí tuệ nhân tạo đằng sau việc xây dựng Deepfake.

Thứ hai, việc áp dụng quy trình xử lý bảo vệ như vậy cho tất cả ảnh và video do chính bạn hoặc công ty của bạn xuất bản trực tuyến có thể ngăn chặn việc sao chép Deepfake một cách hiệu quả. Tuy nhiên, cách tiếp cận này không phải là dễ dàng và là một trò chơi lâu dài. Khi trí tuệ nhân tạo dần cải thiện khả năng xác định các tệp bị giả mạo, các chương trình chống deepfake sẽ cần liên tục phát triển các phương pháp mới để duy trì hiệu quả của chúng.

Để xây dựng tuyến phòng thủ vững chắc hơn, chúng ta không còn phải chỉ dựa vào các phương pháp xác thực dễ bị xâm phạm nữa. Trong trường hợp của bài viết này, giám đốc tài chính có liên quan coi cuộc gọi video là cơ sở tuyệt đối để xác nhận danh tính nhưng không thực hiện các bước bổ sung như gọi cho nhân viên khác tại trụ sở chính hoặc chi nhánh ở Vương quốc Anh để xác thực thứ cấp. Trên thực tế, một số chương trình đã sử dụng công nghệ mã hóa khóa riêng để đảm bảo độ tin cậy của việc xác minh danh tính trực tuyến. Triển khai các bước xác thực đa yếu tố để giảm đáng kể khả năng xảy ra loại gian lận này là điều mà tất cả các doanh nghiệp nên bắt đầu thực hiện ngay lập tức.

Vì vậy, lần tới khi bạn tham gia hội nghị truyền hình hoặc nhận cuộc gọi từ đồng nghiệp, người thân hoặc bạn bè, hãy nhớ rằng người ở đầu bên kia trên màn hình có thể không phải là người thật. . Đặc biệt là khi bạn được yêu cầu bí mật chuyển 25 triệu đô la vào một nhóm tài khoản ngân hàng không xác định, điều tối thiểu chúng ta có thể làm là gọi điện cho sếp trước.

Joy

Joy