投稿者:Advait (Leo) Jayant

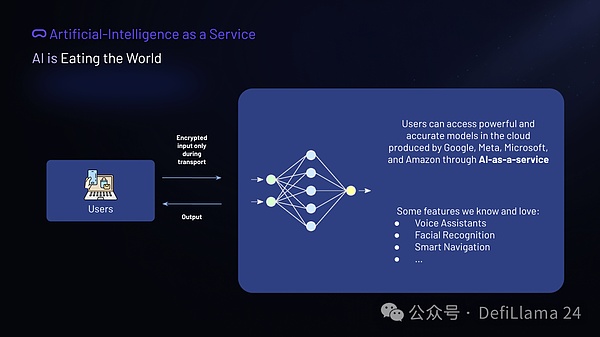

は、その両方を可能にするソリューションを提供します。</p><h2><strong>サービスとしての人工知能(AIaaS)</strong></h2><p>人工知能(AI)は今日、コンピュータービジョン、自然言語処理(NLP)、レコメンダーシステムなど、多くの領域で複雑な課題に取り組む上で重要な役割を果たしています。</p><p>1.データ量: 正確なモデルを構築するには、時には数兆バイト規模の巨大なデータセットが必要になることがよくあります。</p><p>2.計算能力:コンバーターのような複雑なモデルは、何十ものGPUのパワーを必要とし、多くの場合、何週間も継続的に実行されます。</p><p>3.ドメインの専門知識:これらのモデルを微調整するには、深い専門知識が必要です。</p><p>これらの障壁により、ほとんどのユーザーが強力な機械学習モデルを自力で開発することは困難です。</p><p style=)

実世界のアプリケーションにおけるAI-as-a-serviceパイプライン

実世界のアプリケーションにおけるAI-as-a-serviceパイプライン

AI-as-a-Service(AIaaS)の時代に入り、FAANGのメンバーを含む技術大手によって管理されるクラウドサービスを提供することで、ユーザーが最先端のニューラルネットワークモデルにアクセスできるようになり、前述のハードルを克服したモデルです。AIaaSは、高品質の機械学習モデルへのアクセスを効果的に普及させ、先進的なAIツールをより幅広いコミュニティに開放している。しかし残念なことに、今日のAIaaSは、私たちのプライバシーを犠牲にして、これらの便利さをもたらしています。

現在、データはクライアントからサーバーへの送信中にのみ暗号化されます。サーバーは入力データと、そのデータに基づいて行われた予測にアクセスできます。

AI-as-a-Serviceでは、サーバーは入力データと出力データの両方にアクセスできます。

AI-as-a-Serviceでは、サーバーは入力データと出力データの両方にアクセスできます。この状況は、医療データや財務データなどの機密情報を一般ユーザーが共有することを複雑にしています。GDPRやCCPAのような規制は、データを共有する前に明示的な同意をユーザーに要求し、データがどのように使用されるかを知る権利を保証することで、こうした懸念を悪化させる。これらの規制は、ユーザーのプライバシーと権利を確保するための厳格な基準を定めており、個人情報の明確な透明性と管理を提唱している。これらの要件を考えると、信頼とコンプライアンスを維持するために、AI-as-a-Service(AIaaS)プロセス内で堅牢なプライバシーメカニズムを開発することが不可欠です。

FHEは問題を解決します

aとbを暗号化することで、入力データがプライベートのままであることを保証できます。

aとbを暗号化することで、入力データがプライベートのままであることを保証できます。

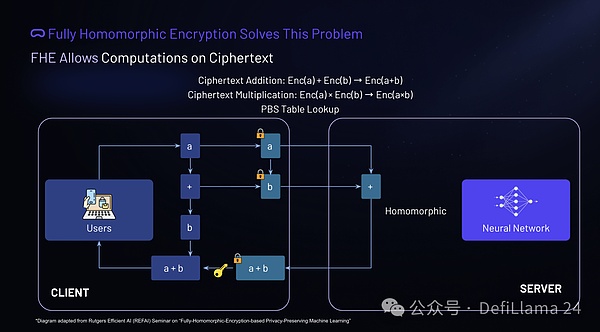

完全同形暗号化(FHE)は、クラウドコンピューティングに関連するデータプライバシー問題の解決策を提供します。FHEスキームは、暗号文の加算や乗算などの操作をサポートします。FHE方式は、暗号文の加算や乗算などの演算をサポートしています。コンセプトは単純で、暗号化された2つの値の和は、その2つの値の和の暗号化結果と等しく、乗算についても同様です。

実際には、次のように動作します。ユーザーがローカルで暗号化した平文値 ?と?は加算操作を実行します。その後、ユーザーは暗号化された?と?を暗号化し、暗号文をクラウドサーバーに送信する。サーバーは暗号化された値に対して(同形的に)加算演算を行い、結果を返すことができる。サーバーから復号された結果は、?と?のローカル平文の加算結果と同じになる。このプロセスは、クラウドで計算を実行できるようにしながら、データのプライバシーを保護します。

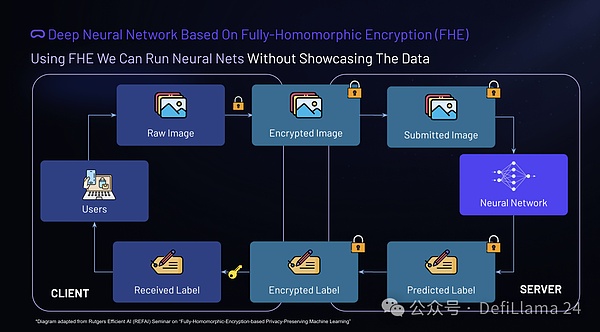

Deep Neural Networks (DNNs) based on full homomorphic encryption

AI-as-a-serviceプロセスでは、基本的な加算演算と乗算演算に加えて、次のような大きな進歩がありました。プロセスでは、ニューラルネットワーク処理に完全同形暗号化(FHE)を使用することで、大きな進歩がありました。この文脈において、ユーザーは生の入力データを暗号文に暗号化し、これらの暗号化されたデータのみをクラウドサーバーに送信することができる。そして、サーバーはこれらの暗号文に対して同形式計算を実行し、暗号化された出力を生成してユーザーに返す。重要なのは、ユーザーだけが秘密鍵を保持し、復号して結果にアクセスできることだ。これにより、エンドツーエンドでFHE暗号化されたデータストリームが構築され、プロセス全体を通してユーザーのデータのプライバシーとセキュリティが保証されます。

完全同形暗号化に基づくニューラルネットワークは、AI-as-a-serviceのユーザーに大きな柔軟性を提供します。暗号文がサーバーに送信されると、クライアントとサーバー間で頻繁に通信する必要がないため、ユーザーはオフラインになることができます。この機能は、一般的に頻繁な通信が現実的でないことが多い制約条件下で動作するIoTデバイスにとって特に有益です。

しかし、完全同形暗号化(FHE)の限界は注目に値します。FHEスキームは本質的に時間がかかり、複雑で、リソースを消費します。さらに、FHEは現在、非線形演算を効果的にサポートすることに苦戦しており、ニューラルネットワークの実装に課題を投げかけている。非線形演算はそのようなモデルの性能にとって重要であるため、この制限はFHEに基づいて構築されたニューラルネットワークの精度に影響を与える可能性があります。

K.-Y. Lam, X. Lu, L. Zhang, X. Wang, H. Wang, and S. Q. Goh, "Privacy-enhanced neural networks based on efficient fully homomorphic encryption in AI-as-a-service applications", presented at Nanyang-as-a-service applications."Privacy-enhanced neural networks based on efficient fully homomorphed encryption in AI-as-a-Service applications"(南洋理工大学(シンガポール)と中国科学院(中国)で発表された。

K.-Y. Lam, X. Lu, L. Zhang, X. Wang, H. Wang, and S. Q. Goh, "Privacy-enhanced neural networks based on efficient fully homomorphic encryption in AI-as-a-service applications", presented at Nanyang-as-a-service applications."Privacy-enhanced neural networks based on efficient fully homomorphed encryption in AI-as-a-Service applications"(南洋理工大学(シンガポール)と中国科学院(中国)で発表された。

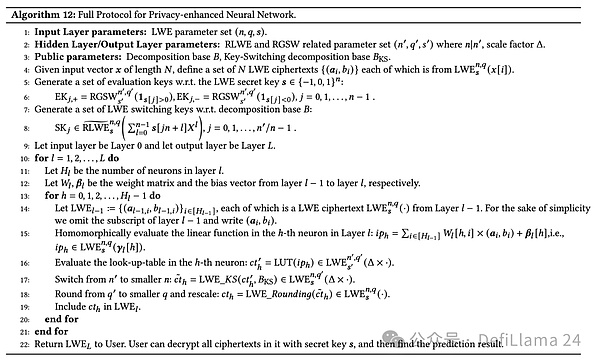

(Lam et al., 2024)は、AI-as-a-serviceのためのプライバシーを強化したニューラルネットワークプロトコルについて述べています。このプロトコルは、暗号化によってデータを保護するために使用される暗号プリミティブであるLWE(Learning by Error)を使用して入力層のパラメータを定義することから始まり、暗号化されたデータを最初に復号化することなく計算できるようにします。隠れ出力層については、パラメータはリングLWE(RLWE)とリングGSW(RGSW)によって定義されます。リングGSW(RGSW)は、より効率的な暗号演算のためにLWEを拡張した2つの高度な暗号技術です。

公開パラメータには、分解基底? および ??? 入力ベクトルが ? of length ?、? LWE 暗号(??,??)各要素の?[?]は、LWE秘密鍵?で?に評価キーのインデックスが付けられ、?[?]>0 と ?[?]<0 さらに、?はLWE切り替えキーのセットを設定します。これらのキーは、異なる暗号化スキーム間の効率的な切り替えをサポートします。

入力レイヤーはレイヤー0、出力レイヤーはレイヤー?レイヤーごとに? 1から?ニューロンの数は??がレイヤ0で決定されている。重み行列?? バイアスベクトル ?? 第0層から開始し、第0層との重ね合わせを定義する。0からℎ までの各ニューロンについて、??-1から最初の?-1層のLWE暗号は同形暗号の下で評価されます。これは、ℎ の線形関数を計算するために、暗号化されたデータに対して計算が実行されることを意味します。最初の?層で、重み行列とバイアスベクトルを結合する。その後、ℎ でルックアップテーブル(LUT)が評価される。第-ニューロンで評価され、?′ switch から、より小さな?が演算を実行し、その後に四捨五入と結果の再スケーリングが行われます。結果は最初の?層に組み込まれます。

最後に、プロトコルはLWE暗号をユーザーに返します。その後、ユーザーは秘密鍵?を使ってすべての暗号文を復号することができる。推論の結果を見つける。

このプロトコルは、完全同型暗号化(FHE)技術を活用することで、プライバシーを保持したニューラルネットワーク推論を効率的に可能にします。FHEは、データ自体を処理サーバーに明かすことなく、暗号化されたデータに対して計算を実行することを可能にし、AI-as-a-Serviceの利点を提供しながら、データのプライバシーを確保します。

AIにおける完全同型暗号化の応用

FHE(完全同型暗号化)は、暗号化されたデータ上で安全な計算を実行することを可能にし、多数の新しい応用シナリオを開くだけでなく、データのプライバシーとセキュリティを保証します。

広告における消費者のプライバシー:(Armknecht et al., 2013)は、完全同形暗号化(FHE)を利用した革新的な推薦システムを紹介しています。このシステムは、ユーザーにパーソナライズされたレコメンデーションを提供できる一方で、レコメンデーションの内容はシステム自身には完全に非公開であることを保証している。これにより、ユーザーの嗜好情報のプライバシーが保証され、ターゲット広告における重要なプライバシー問題が効果的に解決されます。

医療への応用:(Naehrig et al., 2011)は、医療業界向けに説得力のあるソリューションを提案しています。彼らは、患者の医療データを暗号化された形でサービスプロバイダーに継続的にアップロードするために、完全同形暗号化(FHE)を使用することを提案しています。このアプローチにより、機密性の高い医療情報がライフサイクルを通じて機密性を保つことが保証され、患者のプライバシー保護が強化されるとともに、医療機関がシームレスにデータを処理・分析できるようになります。

データマイニング:大規模なデータセットをマイニングすることで、重要な洞察を得ることができますが、多くの場合、ユーザーのプライバシーが犠牲になります。(Yang, Zhong, and Wright, 2006)は、完全同形暗号化(FHE)のコンテキストで関数型暗号化を適用することで、この問題に対処しました。このアプローチにより、データがマイニングされる個人のプライバシーの安全性を損なうことなく、大規模なデータセットから価値ある情報を抽出することが可能になります。

ファイナンシャルプライバシー:ある企業が機密性の高いデータと、秘密にしておかなければならない独自のアルゴリズムを持っているというシナリオを想像してみてください。(Naehrig et al., 2011)は、この問題の解決策としてホモモーフィック暗号化を提案しています。Full Homomorphic Encryption (FHE)を適用することで、企業はデータやアルゴリズムを公開することなく、暗号化されたデータに対して必要な計算を行うことができるため、金銭的なプライバシーと知的財産の保護が保証されます。

フォレンジック画像認識:(Bosch et al., 2014)では、完全同形暗号化(FHE)を使ったフォレンジック画像認識のアウトソーシング方法について説明しています。この技術は特に法執行機関にとって有益である。FHEを適用することで、警察などの機関は、画像の内容を明らかにすることなく、ハードディスク上の違法画像を検出することができ、捜査におけるデータの完全性と機密性を保護することができます。

完全同形暗号化は、広告やヘルスケアからデータマイニング、金融セキュリティ、法執行に至るまで、さまざまな分野における機密情報の取り扱い方法に革命をもたらすことを約束します。このような技術の開発と改良を続ける中で、ますますデータ主導の世界におけるプライバシーとセキュリティの保護の重要性は、いくら強調してもしすぎることはありません。

完全同相暗号化(FHE)の限界

潜在的な可能性があるにもかかわらず、まだ対処しなければならない重要な限界がいくつかあります

Multi-User Support: 完全同相暗号化(FHE)は、暗号化されたデータを計算することができますが、複数のユーザーを含むシナリオでは複雑さが指数関数的に増加します。通常、各ユーザーのデータは一意の公開鍵を使って暗号化される。このような異なるデータセットを管理することは、特にFHEの計算需要を考慮すると、大規模な環境では非現実的になる。このような理由から、Lopez-Altらの研究者は2013年に、異なる鍵で暗号化されたデータセットに対する同時操作を可能にするマルチ鍵FHEフレームワークを提案した。有望ではあるが、このアプローチはさらなる複雑なレイヤーを導入し、プライバシーと効率を確保するために、鍵管理とシステムアーキテクチャの面できめ細かな調整を必要とする。

MASSIVE COMPUTATIONAL OVERHEAD:完全同型暗号化(FHE)の核心は、暗号化されたデータに対して計算を実行する能力です。しかし、この能力には大きなコストがかかります。FHE演算の計算オーバヘッドは、従来の暗号化されていない演算に比べて著しく大きい。このオーバーヘッドは通常多項式で表されますが、高次の多項式を含むため実行時間が長くなり、リアルタイムアプリケーションには不向きです。FHEのハードウェア・アクセラレーションは、計算の複雑さを軽減し、実行速度を向上させるように設計されており、大きな市場機会を表しています。

有限演算:最近の進歩により、確かに完全同型暗号化の適用範囲が広がり、より多様な演算をサポートできるようになりました。しかし、依然として線形および多項式の計算が主な適用対象であり、ディープニューラルネットワークのような複雑な非線形モデルを含むAIアプリケーションには大きな制約となります。このようなAIモデルで必要とされる演算は、現在の完全同型暗号フレームワークで効率的な実行を実現するのは困難である。進歩は見られるものの、完全同形暗号の運用能力と高度なAIアルゴリズムのニーズとの間のギャップは、依然として打ち破るべき重要な障壁となっています。

暗号とAIの文脈における完全ホモモーフィック暗号

以下は、完全ホモモーフィック暗号(FHE)を利用した暗号空間でのAIアプリケーションに取り組んでいる企業の一部です:

Zamaは、完全ホモモーフィック暗号を提供しています。li>

ZamaはConcrete MLを提供しています。Concrete MLは、データ科学者が完全ホモモーフィック暗号化(FHE)を使用するプロセスを簡素化するように設計されたオープンソースのツール群です。Concrete MLは、機械学習モデルをホモモーフィックな等価形式に変換することで、暗号化されたデータの機密計算を可能にします。Zamaのアプローチにより、データ科学者は深い暗号の知識がなくてもFHEを活用できます。Zamaのツールは、機密情報を暗号化したまま、安全なデータ分析と機械学習を促進します。

Privaseeは、セキュアなAIコンピューティングネットワークの構築を専門としています。同社のプラットフォームは完全同型暗号化(FHE)技術を利用しており、機密情報を明らかにすることなく複数の関係者が協力できるようになっている。FHEを使用することで、PrivaseeはAI計算プロセスを通じてユーザーデータが暗号化されたままであることを保証し、プライバシーを保護し、GDPRなどの厳しいデータ保護規制に準拠している。同社のシステムは複数のAIモデルをサポートしており、安全なデータ処理のための多目的なソリューションを提供しています。

Octraは暗号通貨とAIを組み合わせ、デジタル取引のセキュリティとデータ管理の効率を高めています。完全同型暗号化(FHE)と機械学習技術を融合させることで、Octraは分散型クラウドストレージのセキュリティとプライバシー保護の強化に取り組んでいます。そのプラットフォームは、ブロックチェーン、暗号技術、人工知能技術の利用により、ユーザーデータが常に暗号化され、安全であることを保証する。この戦略により、分散型経済におけるデジタル取引のセキュリティとデータ・プライバシーのための強固な枠組みが構築される。

Mind Networkは完全同型暗号化(FHE)と人工知能を組み合わせ、AI処理中に復号化することなく安全な暗号化計算を可能にします。これにより、暗号セキュリティとAI機能をシームレスに融合させた、プライバシーを保護する分散型AI環境が促進されます。このアプローチは、データの機密性を保護するだけでなく、中央機関に依存することなく、また機密情報を公開することなくAIオペレーションを実行できる、トラストレスの分散型環境を可能にし、FHEの暗号強度とAIシステムの運用要件を効果的に組み合わせます。

完全同型暗号化(FHE)、人工知能(AI)、暗号通貨の最前線で事業を展開する企業の数は、依然として限られています。これは主に、FHEを効果的に実装するために必要な膨大な計算オーバーヘッドによるもので、暗号計算を効率的に実行するためには強力な処理能力が必要です。

結論

完全同型暗号化(FHE)は、復号化せずに暗号化されたデータで計算できるようにすることで、AIにおけるプライバシーを強化する有望なアプローチを提供します。この機能は、ヘルスケアや金融など、データのプライバシーが重要な機密性の高い分野で特に価値があります。しかし、FHEは、計算オーバーヘッドが大きいことや、深層学習に必要な非線形演算の処理に限界があることなど、大きな課題に直面している。こうした障害にもかかわらず、FHEアルゴリズムとハードウェアアクセラレーションの進歩により、AIにおけるより実用的なアプリケーションへの道が開かれつつある。この分野での継続的な開発により、計算効率と堅牢なデータ保護のバランスが取れた、安全でプライバシーが保護されたAIサービスが大幅に強化されることが期待されます。

JinseFinance

JinseFinance

JinseFinance

JinseFinance Catherine

Catherine JinseFinance

JinseFinance Kikyo

Kikyo JinseFinance

JinseFinance JinseFinance

JinseFinance Hui Xin

Hui Xin Hui Xin

Hui Xin Hui Xin

Hui Xin Bitcoinist

Bitcoinist