출처: 퀀텀비트

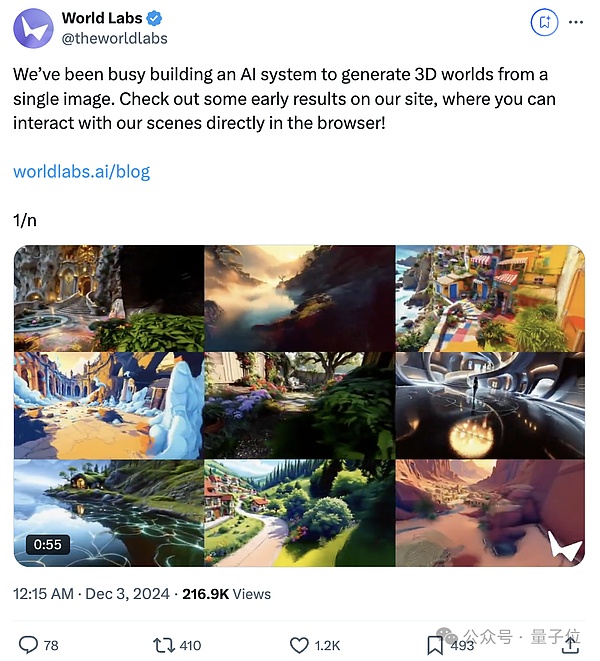

방금 전, 공간 지능을 위한 페이페이 리의 첫 번째 프로젝트가 깜짝 공개되었습니다.

지도 한 장으로 3D 게임 세계를 생성하는 AI 시스템!

요점은 생성된 3D 월드가 대화형이라는 점입니다.

얕은 피사계 심도, 히치콕 줌, 기타 조작을 통해 카메라를 자유롭게 움직이며 마치 게임을 하듯 3D 세계를 탐험할 수 있습니다.

임의 이미지 입력:

이미지 src="https://img.jinse.cn/7328632_image3.png">

이미지 입력:

이미지 src="https://img.jinse.cn/7328633_image3.png"><

이 이미지를 제외한 탐색 가능한 3D 월드의 모든 장면은 AI가 생성한 것입니다.

이 장면은 브라우저에서 실시간으로 렌더링되며

제어된 카메라 효과와 함께 에서 실시간으로 렌더링되며, 카메라 효과와 조정 가능한 아날로그 피사계 심도(DoF)가 포함되어 있습니다.

씬에 있는 오브젝트의 색상을 변경하고 배경 조명과 그림자를 동적으로 조정하며 다른 오브젝트를 삽입할 수도 있습니다.

또한 대부분의 기존 생성 모델이 픽셀을 예측했다면, 이 AI 시스템은 3D 장면을 직접 예측합니다.

따라서 사용자가 눈을 떼었다가 다시 돌아와도 장면이 변하지 않으며, 3D 기하 물리학의 기본 규칙을 따릅니다.

인터넷은 폭발적으로 반응했고 댓글 섹션에는 "믿을 수 없다"라는 단어가 넘쳐났습니다.

이 중 다수는 Shopify 창립자 Tobi Lutke와 다른 유명 인사들의 찬사를 받았습니다:

이것이 바로 VR의 새로운 세상을 열었다고 생각하는 네티즌도 많습니다.

이미지 src="https://img.jinse.cn/7328642_image3.png">

공식적으로는 "이것은 3D 네이티브 생성 AI의 미래를 보여주는 스냅샷에 불과하다"

우리는 이 기술을 가능한 한 빨리 사용자들에게 제공하기 위해 열심히 노력하고 있습니다!

이미지 src="https://img.jinse.cn/7328643_image3.png">

페이페이 리는 이 결과를 처음으로 공유하며 다음과 같이 말했습니다. 사진이나 문장을 통해 생성된 3D 장면과 상호 작용하는 경험을 언어로 설명하기는 어렵습니다.

대기자 신청은 현재 진행 중이며 일부 콘텐츠 크리에이터는 이미 사용 중입니다.

부러움에 눈가에 주체할 수 없는 침이 흐르고 있습니다.

오늘, 월드 랩은 공간 지능을 향한 첫 걸음을 내디뎠습니다.

단일 이미지에서 3D 세계를 생성하는 AI 시스템을 출시했습니다.

입력된 이미지를 넘어 모든 것을 생성합니다.

그리고 어떤 이미지든 입력할 수 있습니다.

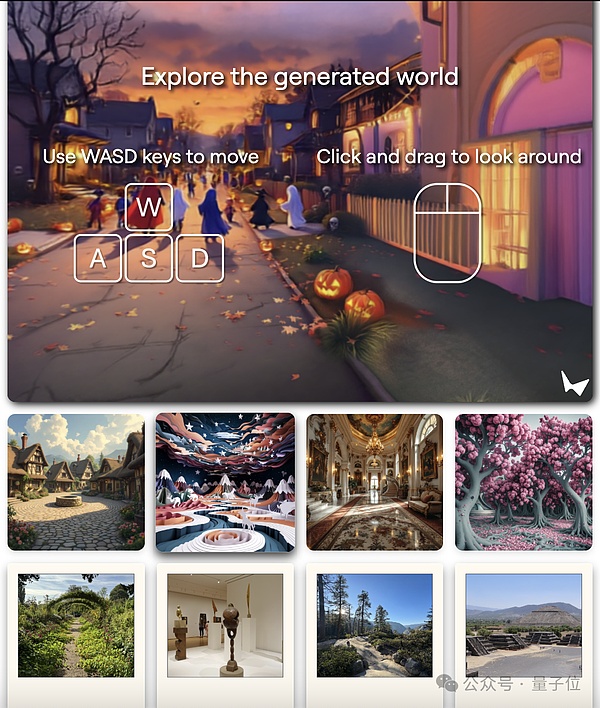

그리고 상호작용이 가능한 3D 세계로, 사용자는 W/A/S/D 키로 상하좌우 시점을 제어하거나 마우스로 화면을 드래그하여 생성된 세계를 돌아다닐 수 있습니다.

공식 사이트에는 여러 가지 데모가 준비되어 있는데, 동영상이나 사진을 보는 것과는 실제 체험이 매우 다르므로 이번 기회에 꼭 해보시길 추천합니다.

(드라이브 스루는 언제나처럼 기사 말미에 있습니다)

p>

자, 이제 질문이 있습니다: 인공지능 시스템이 생성한 3D 세계에서 또 어떤 세부 사항을 살펴볼 가치가 있을까요?

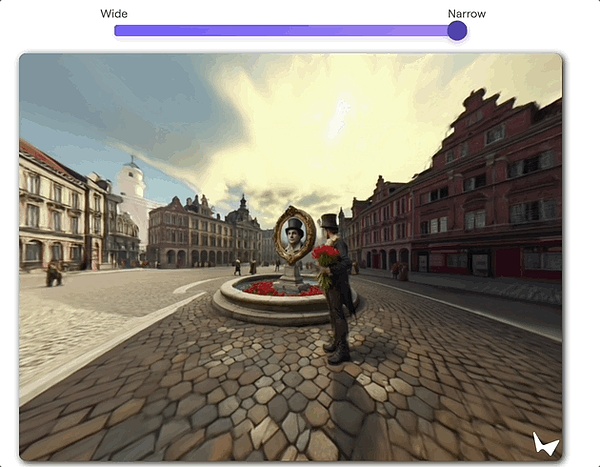

카메라 효과

월드 랩스는 3D 월드가 생성되면 브라우저에서 실시간으로 렌더링되어 마치 가상 카메라를 보는 것과 비슷한 느낌을 준다고 설명합니다.

그리고 사용자는 이 카메라를 정밀하게 제어할 수 있습니다.

이를 활용하는 방법에는 두 가지가 있는데,

첫 번째는 심도 효과를 시뮬레이션할 수 있는 것으로, 카메라에서 일정 거리에 있는 물체에만 선명하게 초점을 맞출 수 있다는 의미입니다.

이미지 src="https://img.jinse.cn/7328647_image3.png">

두 번째는 영화 촬영 기법에서 상징적인 히치콕 줌인 슬라이딩 줌(돌리 줌)을 시뮬레이션할 수 있는 기능입니다.

"사진 속 피사체의 크기는 그대로 유지되는 반면 배경의 크기는 변하는" 것이 특징입니다.

티베트와 신장에 가면 많은 당나귀들이 히치콕 줌을 사용해 영상을 촬영하는데, 이는 시각적 효과가 강합니다.

월드 랩 데모에서 이 효과는 다음과 같습니다(이 플레이스루에서는 시점을 제어할 수 없음):

3D 효과

월드 랩은 픽셀을 예측하는 대부분의 생성 모델과 달리 이 AI는 3D 장면을 예측한다고 말합니다.

공식 블로그 게시물에는 세 가지 이점이 나와 있습니다.

첫째, 지속적 현실성.

한 번 생성된 월드는 계속 유지됩니다.

다른 시점으로 바라보다가 다시 돌아본다고 해서 원래 시점의 장면이 바뀌는 것과는 다릅니다.

둘째, 실시간 제어입니다.

씬을 생성한 후 사용자는 키보드나 마우스로 제어하여 실시간으로 3D 세계를 돌아다닐 수 있습니다.

꽃의 세부 사항을 면밀히 관찰하거나 어둠 속 어딘가에서 신의 관점에서 세상의 모든 움직임을 관찰할 수도 있습니다.

셋째, 적절한 기하학의 규칙을 따르세요.

이 AI 시스템은 3D 집합 물리학의 기본 규칙을 따르는 세계를 생성합니다.

일부 AI가 생성한 동영상은 매우 몽환적이긴 하지만, 우리처럼 깊이 있는 사실감을 갖지는 못합니다(도제).

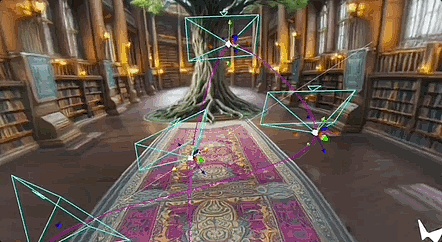

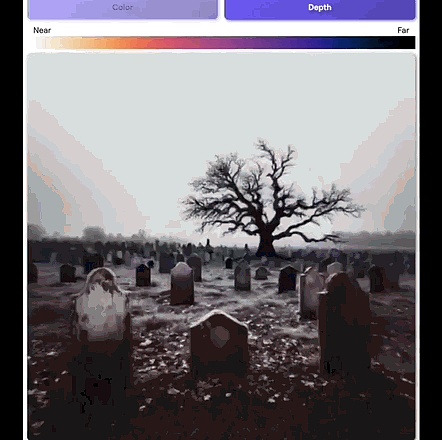

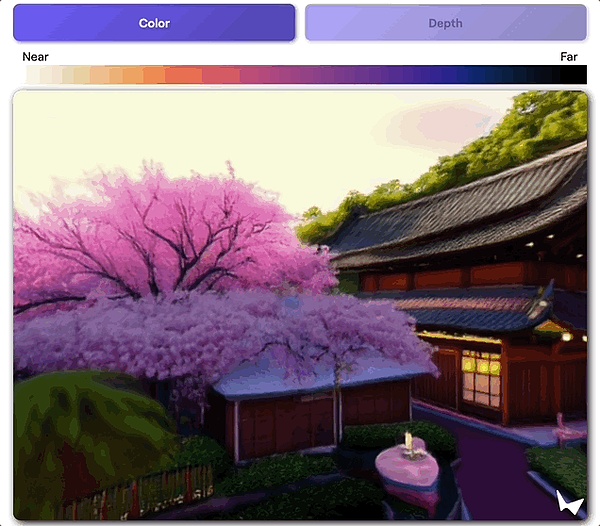

공식 블로그 게시물에서도 시각적인 3D 장면을 만드는 가장 쉬운 방법은 뎁스 맵을 그리는 것이라고 적고 있습니다.

지도에서 각 픽셀의 색상은 카메라로부터의 거리에 따라 결정됩니다.

물론 사용자는 3D 씬 구조를 사용하여 인터랙티브 효과를 만들 수 있습니다 -

클릭하면 장면에 갑자기 스포트라이트를 비추는 등 장면과 상호 작용할 수 있습니다.

이미지 src="https://img.jinse.cn/7328652_image3.png">

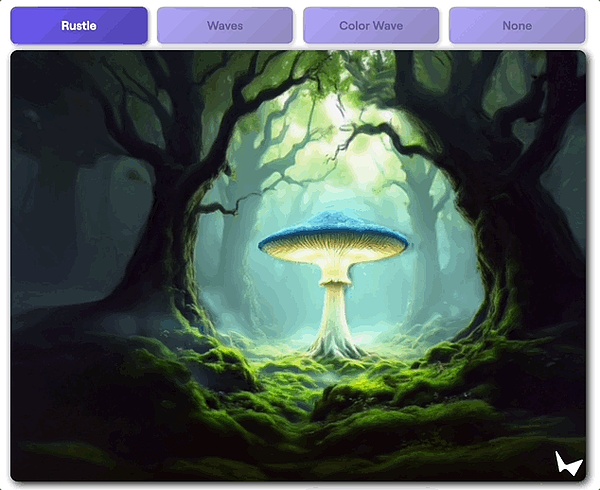

애니메이션 효과?

그것도 쉽습니다.

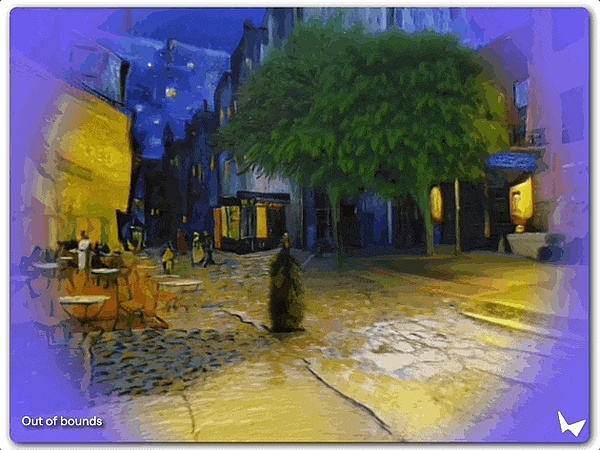

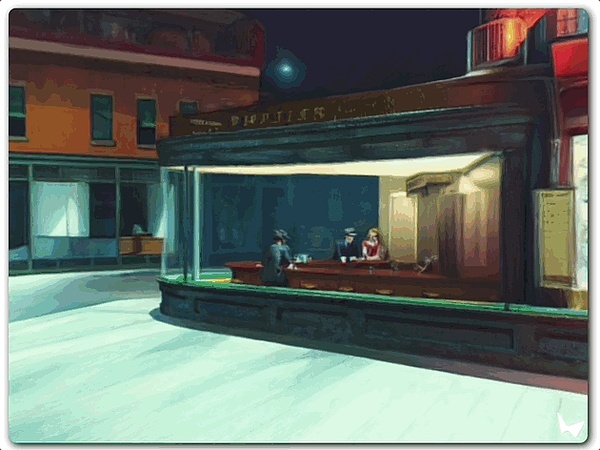

회화의 세계 속으로

팀은 또한 고전 예술 작품을 '완전히 새로운 방식으로' 경험해보자는 아이디어를 가지고 장난을 쳤습니다. " 고전 예술 작품을 경험해보세요.

대화형 인터랙션뿐만 아니라 그림 하나를 입력하는 것만으로도 원본 그림에 없는 부분을 채울 수 있다는 점에서 새롭습니다.

그렇게 되면 3D 세계가 됩니다.

이것은 반 고흐의 '밤의 카페 알 프레스코'입니다:

이것은 에드워드 호퍼의 '녹턴'입니다:

창의적인 워크플로

팀에서는 3D 월드 생성이 은 다른 AI 툴과 매우 자연스럽게 결합할 수 있습니다↪CF_200D↩.

이를 통해 크리에이터는 이미 익숙한 툴로 새로운 워크플로를 경험할 수 있습니다.

밤을 예로 들면:

텍스트-그래프 모델을 사용하여 텍스트의 세계에서 이미지의 세계로 이동할 수 있습니다.

모델마다 특화된 스타일 특성이 있기 때문에 3D 월드는 이러한 스타일을 마이그레이션하고 상속할 수 있습니다.

같은 프롬프트에서 서로 다른 스타일의 빈센트 그래픽 모델에서 생성된 이미지를 입력하면 서로 다른 3D 월드가 탄생할 수 있습니다:

활기찬 만화 스타일의 십대 침실. 침대는 알록달록한 담요로 덮여 있고 책상 위에는 컴퓨터가 어지럽게 놓여 있으며 벽에는 포스터가 걸려 있고 스포츠 장비가 어지럽게 널려 있습니다. 기타가 벽에 기대어 있고 가운데에는 아늑한 꽃무늬 러그가 깔려 있습니다. 창문을 통해 들어오는 빛이 방에 따뜻함과 젊음을 더했습니다.

월드 랩과 공간 지능

"World Labs," 설립자 스탠퍼드 대학교 교수이자 AI 대모인 페이페이 리가 올해 4월에 설립한 회사입니다.

이 회사 역시 그녀의 첫 번째 스타트업이었습니다.

그리고 그녀의 스타트업의 방향은 새로운 개념인 공간 지능으로, 다음과 같습니다:

시각화는 통찰력이 되고, 보는 것은 이해가 되고, 이해는 행동으로 이어집니다.

페이페이 리에게 이것은 "AI 퍼즐을 풀기 위한 퍼즐의 핵심 조각"입니다.

이 회사는 불과 3개월 만에 10억 달러의 기업 가치를 돌파하며 새롭게 유니콘 기업으로 부상했습니다.

공개된 정보에 따르면 a16z, NEA, Radical Ventures가 주요 투자자이며 Adobe, AMD, 데이터브릭스, 올드 옐로우의 NVIDIA도 투자자로 참여했습니다.

개인 투자자 중에는 카파시, 제프 딘, 힌튼 등 거물급 인사도 적지 않습니다. ......

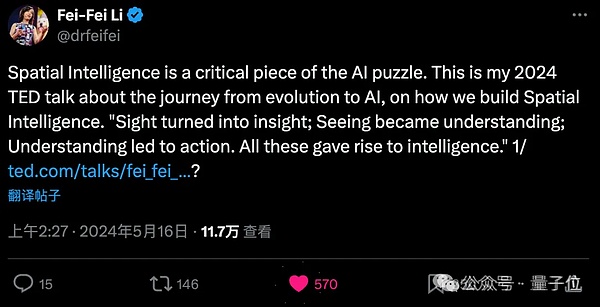

올해 5월, 페이 페이 리는 15분간 TED 강연을 공개적으로 진행했습니다.

그녀는 공간 지능에 대한 더 많은 생각을 공유하며 다음과 같은 핵심 사항을 언급했습니다.

시각화 능력은 동물 종이 화석 기록에 대량으로 등장한 캄브리아기 폭발을 촉발한 것으로 추정됩니다. 시기를 촉발한 것으로 추정됩니다. 단순히 방향을 찾기 위해 빛을 받아들이는 수동적인 경험으로 시작된 시각은 곧 보다 능동적으로 변했고 신경계는 진화하기 시작했습니다 ...... 이러한 변화는 지능을 탄생시켰습니다.

수년 동안 저는 사진을 찍는 것과 이해하는 것은 같은 것이 아니라고 말해왔습니다. 오늘 저는 한 가지를 더 추가하고 싶습니다. 보기만 하는 것만으로는 충분하지 않습니다. 행동하고 배우기 위해서는 봐야 합니다.

현재의 능력을 뛰어넘는 AI를 원한다면, 우리는 단순히 보고 말할 수 있는 AI가 아니라 행동할 수 있는 AI를 원합니다. 공간 지능의 최신 이정표는 컴퓨터가 보고, 배우고, 행동하고, 더 잘 보고 행동하는 법을 배우도록 가르치는 것입니다.

공간 지능의 발전이 가속화되면서 이러한 선순환의 새로운 시대가 우리 눈앞에 펼쳐지고 있습니다. 이 순환은 3D 세계를 이해하고 상호 작용해야 하는 모든 구현형 지능 시스템의 핵심 구성 요소인 로봇 학습을 촉진하고 있습니다.

이 회사의 주요 고객은 비디오 게임 개발자와 영화 스튜디오인 것으로 알려졌습니다. 월드 랩스는 인터랙티브 시나리오 외에도 아티스트, 디자이너, 개발자, 영화 제작자, 엔지니어 등 전문가에게 유용한 툴을 개발할 계획입니다.

스페이스 인텔리전스의 첫 번째 프로젝트가 출시되면서 이들의 목표가 더욱 가시화되고 있습니다.

그러나 월드 랩스는 현재 출시된 버전은 '초기 프리뷰'에 불과하다고 말합니다.

우리가 생성하는 월드의 규모와 충실도를 개선하기 위해 노력하고 있으며, 사용자가 더 쉽게 접근할 수 있는 새로운 방법을 실험하고 있습니다. 그리고 사용자가 상호작용할 수 있는 새로운 방법을 시도하고 있습니다.

참고 링크:

[1]https://www.worldlabs.ai/blog

[2] https://mp.weixin.qq.com/s/3MWUv3Qs7l-Eg9A9_3SnOA?token=965382502&lang=zh_CN

[3]https://x.com/ theworldlabs/status/1863617989549109328

JinseFinance

JinseFinance

JinseFinance

JinseFinance JinseFinance

JinseFinance Miyuki

Miyuki JinseFinance

JinseFinance JinseFinance

JinseFinance Cointelegraph

Cointelegraph Nulltx

Nulltx Nulltx

Nulltx Ftftx

Ftftx Ftftx

Ftftx