출처: 메타버스 데일리 익스플로전

공개 테스트가 시작되기도 전에 OpenAI는 텍스트 생성 비디오 모델인 Sora의 트레일러를 공개하여 기술, 인터넷, 소셜 미디어 커뮤니티를 놀라게 했습니다.

오픈AI가 공개한 공식 영상에 따르면 소라는 사용자가 제공한 텍스트 정보를 바탕으로 복잡한 장면을 최대 1분 길이의 '하이퍼 비디오'로 생성할 수 있으며, 이미지가 섬세하고 사실적일 뿐만 아니라 카메라 움직임까지 시뮬레이션할 수 있습니다.

공개된 영상 효과부터 업계에서는 <소라>의 현실 세계 이해 능력에 대해 기대감을 나타내고 있습니다. 다른 대형 텍스트-투-비디오 모델과 비교했을 때 Sora는 의미 이해, 화면 표현, 시각적 일관성, 지속 시간 등에서 모두 우위를 보입니다.

OpenAI는 이를 '월드 시뮬레이터'라고 직접 지칭하며 실제 세계의 사람, 동물, 환경의 특성을 모델링할 수 있다고 선언합니다. 하지만 이 회사는 소라가 아직 완벽하지 않으며 이해 부족과 잠재적인 보안 문제를 안고 있다는 점도 인정합니다.

그 결과, 소라는 극소수의 사람들에게만 테스트용으로 공개되어 있으며 OpenAI는 아직 일반 대중에게 언제 공개할지 발표하지 않았지만, 유사한 모델을 개발 중인 기업들에게 충분한 충격을 주었습니다.

01 소라 '예고편'이 대중에게 충격을 주다

OpenAI의 텍스트 생성 동영상 모델인 소라는 이제 중국에서 '쇼커'가 되었습니다.

셀프 미디어는 "현실은 존재하지 않는다"고 외쳤고, 인터넷 거물들도 소라의 능력에 감탄했습니다. 360 창업자 저우홍이는 소라의 탄생으로 AGI의 실현이 10년에서 약 2년으로 단축될 수 있을 것이라고 말했습니다. 불과 며칠 만에 소라의 구글 검색 지수는 빠르게 상승했고, 그 열기는 곧바로 ChatGPT로 향했습니다.

소라의 폭발적인 인기는 OpenAI가 가장 긴 1분짜리 동영상 48개를 공개한 데서 비롯되었습니다. 이는 기존 빈센트의 동영상 모델인 2세대 런웨이의 동영상 길이 제한을 깨고 선명한 화질은 물론, 카메라의 언어까지 학습한 것입니다.

1 분 영상, 네온 불빛의 거리를 걷는 빨간 드레스를 입은 여성, 사실적인 스타일, 부드러운 그림, 가장 놀라운 것은 클로즈업의 여성 주인공, 얼굴의 모공, 반점, 여드름 자국까지 시뮬레이션, 메이크업에서 카드 파우더의 효과는 라이브 방송이 뷰티 필터, 목의 목선, 심지어 정확한 '누출'을 끄는 것과 비슷합니다.

사실적인 캐릭터 외에도 소라는 동물과 환경의 현실을 시뮬레이션 할 수 있습니다. 빅토리아 왕관 비둘기를 다각도로 클로즈업한 영상에서는 새의 몸 전체에서 왕관까지 푸른 깃털을 매우 선명하게 표현하고 붉은 눈동자와 호흡수까지 역동적으로 표현하여 AI가 생성한 것인지 사람이 촬영한 것인지 구분하기 어려울 정도입니다.

비실사 창작 애니메이션인 소라의 제너레이션 효과는 디즈니 애니메이션 영화의 영상 감각까지 구현해 네티즌들은 애니메이터의 밥그릇을 걱정할 정도입니다.

그리고 소라의 텍스트 생성 비디오 모델은 비디오 길이와 그림 효과뿐만 아니라 렌즈와 촬영의 이동 궤적, 게임의 1 인칭 시점, 항공 시점, 심지어 영화의 한 장면까지 시뮬레이션 할 수 있습니다.

오픈AI가 공개한 멋진 동영상을 보면 인터넷 커뮤니티와 소셜 미디어에서 소라에 대해 왜 충격을 받았는지 이해할 수 있을 것입니다(이는 예고편에 불과합니다).

02 OpenAI, '비주얼 패치' 데이터 세트 발표

소라는 어떻게 시뮬레이션 기능을 구현할 수 있을까요?

오픈AI가 발표한 Sora 기술 보고서에 따르면, 이 모델은 기존 이미지 데이터 생성 모델의 한계를 뛰어넘고 있습니다.

텍스트로 생성된 시각 이미지에 대한 이전 연구에서는 순환 네트워크, 생성적 적대 네트워크(GAN), 자동 회귀 변환기, 확산 모델 등 다양한 접근 방식을 사용했지만 공통점은 적은 수의 시각 데이터 범주, 짧은 동영상 또는 고정 크기 동영상에 초점을 맞췄다는 점입니다.

Sora는 그래프 생성 프로세스를 포워드 프로세스와 리버스 프로세스의 두 단계로 나눌 수 있는 트랜스포머 기반 확산 모델을 사용하여 타임라인을 따라 동영상을 앞뒤로 확장하는 기능을 구현합니다.

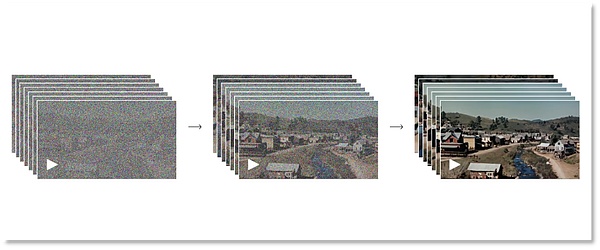

순방향 프로세스 단계에서는 실제 이미지에서 순수 노이즈 이미지로 확산되는 과정을 시뮬레이션합니다. 구체적으로, 모델은 이미지가 완전히 노이즈가 될 때까지 이미지에 노이즈를 서서히 추가합니다. 역방향 프로세스는 순방향 프로세스의 역으로, 모델이 노이즈가 있는 이미지에서 점차적으로 원본 이미지를 복구하는 단계입니다. 현실과 현실 사이를 오가며 긍정과 부정을 반복하는 이러한 방식으로 OpenAI는 머신 소라가 시각의 형성을 이해할 수 있게 해줍니다.

전체 노이즈에서 선명한 이미지로

전체 노이즈에서 선명한 이미지로

물론 이 과정은 모델이 노이즈를 점진적으로 제거하고 이미지의 디테일을 복원하는 방법을 학습하기 때문에 반복적인 학습이 필요합니다. 이 두 단계를 반복함으로써 Sora의 확산 모델은 고품질 이미지를 생성할 수 있습니다. 이 모델은 이미지 생성, 이미지 편집, 초고해상도 등의 영역에서 뛰어난 성능을 보여줍니다.

위 과정은 고화질과 초고해상도를 구현하는 Sora의 능력을 설명합니다. 하지만 정적인 이미지에서 동적인 동영상까지 학습하려면 여전히 데이터를 더 축적하고 모델을 학습시켜야 합니다.

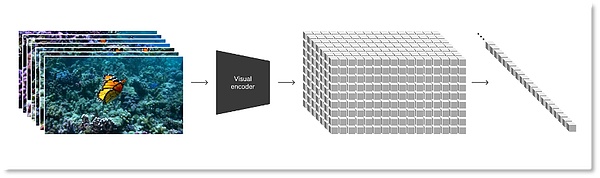

확산 모델을 기반으로 OpenAI는 비디오, 이미지 등 모든 유형의 시각 데이터를 통합된 표현으로 변환하여 Sora에 대한 대규모 생성 학습에 사용합니다.

Sora가 사용하는 표현은 OpenAI에서 '시각 데이터의 더 작고 상세한 표현인 비주얼 패치'로 정의됩니다. "이는 GPT의 텍스트 모음과 유사한 작은 데이터 단위의 모음입니다.

연구진은 먼저 비디오를 저차원 잠재 공간으로 압축한 다음 이 표현을 시공간적 패치로 분해했는데, 이는 비디오에서 패치로 쉽게 전환할 수 있고 여러 유형의 비디오와 이미지를 처리하는 생성 모델을 훈련하는 데 적합한 확장성이 뛰어난 표현 형태입니다.

시각적 데이터를 패치로 변환하기

시각적 데이터를 패치로 변환하기

더 적은 정보와 연산으로 소라를 훈련시키기 위해 OpenAI는 먼저 영상을 저차원 잠재 공간의 픽셀 수준으로 압축한 다음, 압축된 영상 데이터를 가지고 '패치'를 생성하는 영상 압축 네트워크를 개발해 입력 정보가 적고 연산 부담이 적은 패치를 만들었습니다. 동시에 OpenAI는 해당 디코더 모델을 학습시켜 압축된 정보를 다시 픽셀 공간으로 매핑합니다.

연구진은 시각적 패치 표현을 기반으로 다양한 해상도, 길이, 화면 비율의 비디오/이미지에 대해 Sora를 훈련시킬 수 있었습니다. 추론 단계로 넘어가면, Sora는 비디오 로직을 결정하고 적절한 크기의 그리드에 무작위로 초기화된 패치를 배열하여 생성된 비디오의 크기를 제어할 수 있습니다.

OpenAI는 이 비디오 모델을 대규모로 훈련하면 실제 사람, 동물, 환경을 사실적으로 시뮬레이션하여 3D 일관성, 시간적 일관성을 달성하면서 충실도 높은 비디오를 생성하고 물리적 세계를 사실적으로 시뮬레이션하는 등 흥미로운 기능을 보여준다고 설명합니다. 이 과정에서 소라는 강력한 능력을 보여주지만, 현재 일반 사용자가 체험할 수 있는 방법은 X @ OpenAI의 설립자 샘 알트먼이 네티즌들이 소라에서 영상을 생성하도록 도와주고 이를 대중에게 공개해 효과를 확인할 수 있는 큐 워드를 작성하는 것밖에 없습니다.

이 때문에 소라가 과연 OpenAI가 공식적으로 내세우는 것만큼 뛰어난 기술인지에 대한 의문이 제기되기도 합니다.

이에 대해 OpenAI는 모델에 아직 몇 가지 문제가 있다고 말했습니다. 초기 GPT와 마찬가지로 현재 Sora에는 주로 시각적인 비디오 결과에서 더 구체적으로 나타나는 오류인 '착시 현상'이 있습니다.

다음 비디오 클립 "고고학자들이 플라스틱 의자를 파내다"에서는 의자가 모래에서 바로 '떠올라요'.

그리고 갑자기 나타난 새끼 늑대도 있는데, 네티즌들은 이를 '늑대 유사 분열'이라고 불렀습니다.

때때로 앞뒤를 구분하지 못합니다.

영화 속 이러한 실수는 소라가 아직 물리적 세계의 움직임 논리에 대한 이해와 훈련이 더 필요하다는 것을 증명하는 것처럼 보입니다. 또한, 소라의 직관적인 시각적 경험은 ChatGPT보다 윤리적, 보안적으로 더 많은 위험을 초래할 수 있습니다.

이전에는 빈센트의 지도 모델인 미드저니가 인간에게 "사진이 진실일 필요는 없다"고 말하면서 AI가 생성한 거짓 사진이 루머의 요소가 되기 시작했습니다. 신원 확인 회사인 iProov의 최고 과학 책임자인 뉴웰 박사는 소라가 "악의적인 행위자들이 고품질의 가짜 동영상을 더 쉽게 생성할 수 있게 해준다"고 말했습니다.

소라가 생성한 동영상을 악의적으로 악용하여 사기와 명예훼손, 폭력 및 음란물을 유포한다면 그 결과는 가늠할 수 없을 정도로 심각할 것이므로, 소라는 사람들에게 충격을 주는 동시에 두려움을 안겨줍니다.

OpenAI는 소라가 가져올 수 있는 보안 문제도 고려했기 때문에 초대를 받은 극소수의 사람들에게만 소라를 테스트할 수 있도록 개방하고 있습니다. OpenAI는 일반 대중에게 언제 공개할 것인지에 대한 일정을 밝히지 않았으며, 공식 동영상 공개를 보면 다른 회사들이 Sora 모델을 따라잡을 시간이 많지 않은 것으로 보입니다.

JinseFinance

JinseFinance

JinseFinance

JinseFinance JinseFinance

JinseFinance JinseFinance

JinseFinance JinseFinance

JinseFinance JinseFinance

JinseFinance Weatherly

Weatherly JinseFinance

JinseFinance JinseFinance

JinseFinance JinseFinance

JinseFinance JinseFinance

JinseFinance