Nguồn: Newin

Sáng sớm ngày 15/5, Hội nghị nhà phát triển Google I/O chính thức diễn ra được tổ chức, sau đây là bản tóm tắt về hội nghị kéo dài 2 giờ:

1. Giới thiệu về Gemini

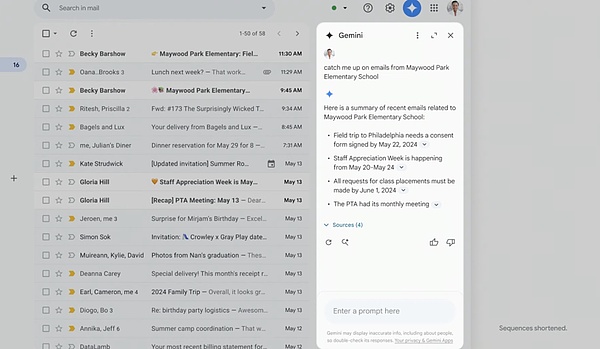

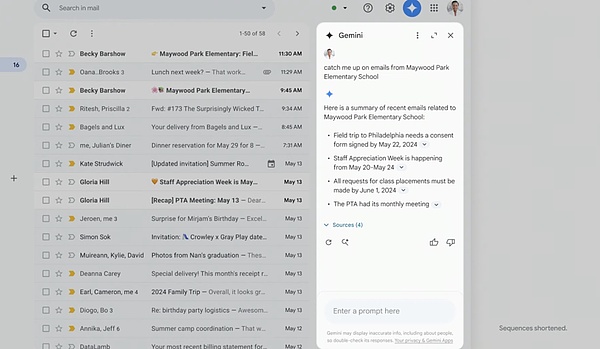

1) Trong Gmail Gemini

Người dùng Gmail sẽ có thể tìm kiếm, tóm tắt và soạn thảo email bằng công nghệ Gemini AI. Nó cũng có thể thực hiện hành động đối với email để thực hiện các tác vụ phức tạp hơn, chẳng hạn như giúp bạn xử lý hàng trả lại trong thương mại điện tử bằng cách tìm kiếm hộp thư đến, tìm biên nhận và điền vào biểu mẫu trực tuyến.

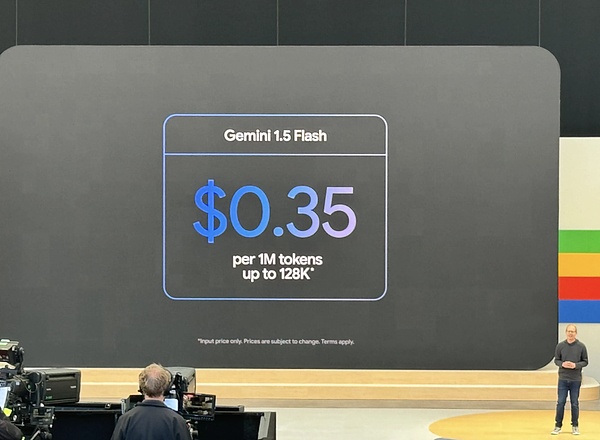

2) Gemini 1.5 Pro & Flash< /h3>

Một nâng cấp khác là giờ đây Gemini có thể phân tích các tài liệu và cơ sở mã dài hơn trước , video và ghi âm. Trong bản xem trước riêng tư của phiên bản mới của mẫu hàng đầu hiện tại của Google, Gemini 1.5 Pro, đã tiết lộ rằng nó có thể chứa tới 2 triệu mã thông báo. Tốc độ đó nhanh gấp đôi so với trước đây và Gemini 1.5 Pro mới hỗ trợ đầu vào lớn nhất so với bất kỳ mẫu máy thương mại nào hiện có.

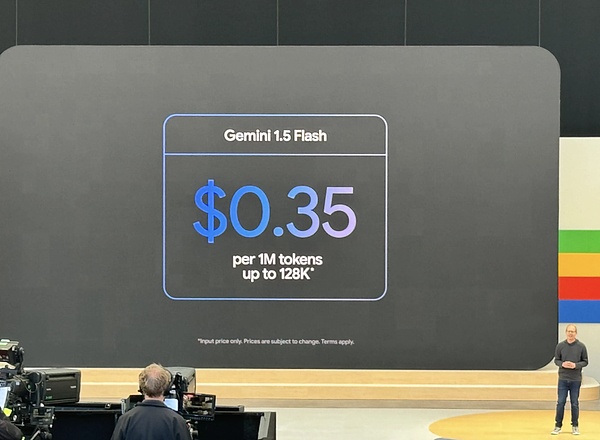

Đối với các ứng dụng ít yêu cầu hơn, Google đã tung ra phiên bản xem trước công khai của Gemini 1.5 Flash , là phiên bản "tinh chỉnh" của Gemini 1.5 Pro, một mô hình nhỏ, hiệu quả được xây dựng dành riêng cho khối lượng công việc AI thế hệ "hẹp", "tần số cao". Flash có tới 2 triệu cửa sổ ngữ cảnh mã thông báo và, giống như Gemini 1.5 Pro, là đa phương thức, nghĩa là nó có thể phân tích âm thanh, video và hình ảnh cũng như văn bản.

Ngoài ra, người dùng Gemini Advanced ở hơn 150 quốc gia và hơn 35 ngôn ngữ có thể tận dụng bối cảnh rộng hơn của Gemini 1.5 Pro để cho phép chatbot phân tích, tóm tắt và trả lời các câu hỏi về các tài liệu dài (tối đa 1.500 trang) Vấn đề.

Người dùng Gemini Advanced có thể tương tác với Gemini 1.5 Pro bắt đầu từ hôm nay, Bạn có thể cũng nhập tài liệu từ Google Drive hoặc tải chúng trực tiếp từ thiết bị di động của bạn.

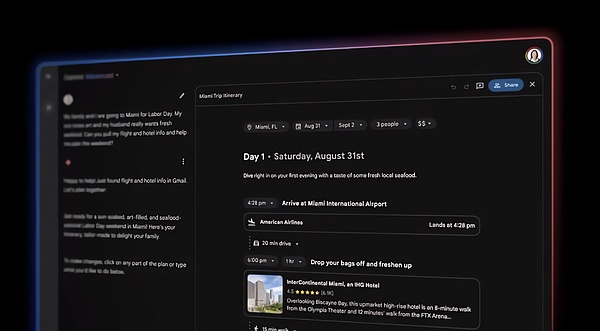

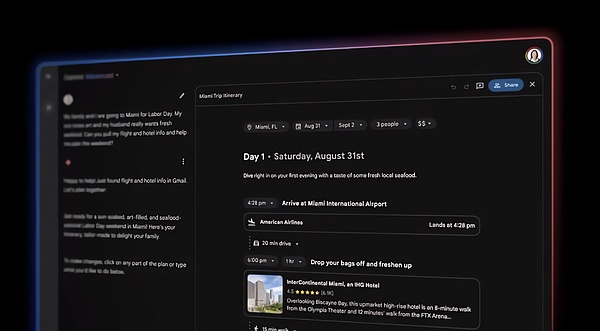

Trong những tháng tới, Gemini Advanced sẽ nhận được “Trải nghiệm lập kế hoạch” mới cho phép bạn tạo hành trình du lịch tùy chỉnh dựa trên lời nhắc. Có tính đến các yếu tố như thời gian bay (từ email trong hộp thư đến Gmail của người dùng), sở thích về bữa ăn và thông tin điểm du lịch địa phương (từ dữ liệu bản đồ và tìm kiếm của Google), cũng như khoảng cách giữa các điểm tham quan đó, Gemini sẽ tự động tạo hành trình được cập nhật để phản ánh bất kỳ thay đổi nào.

Trong tương lai gần, người dùng Gemini Advanced sẽ có thể tạo Gems, chatbot tùy chỉnh được hỗ trợ bởi các mô hình Google Gemini. Theo dòng GPT của OpenAI, Đá quý có thể được tạo từ các mô tả ngôn ngữ tự nhiên - ví dụ: "Bạn là huấn luyện viên chạy bộ của tôi. Hãy cho tôi kế hoạch chạy bộ hàng ngày" - và được chia sẻ với người khác hoặc giữ kín.

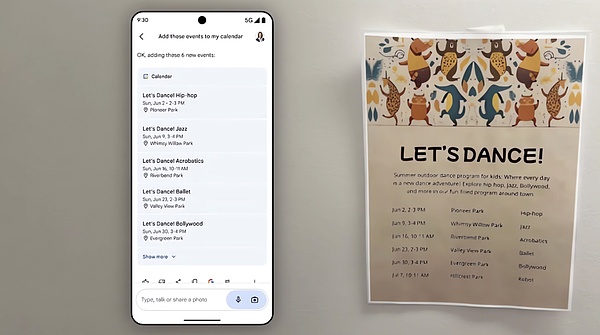

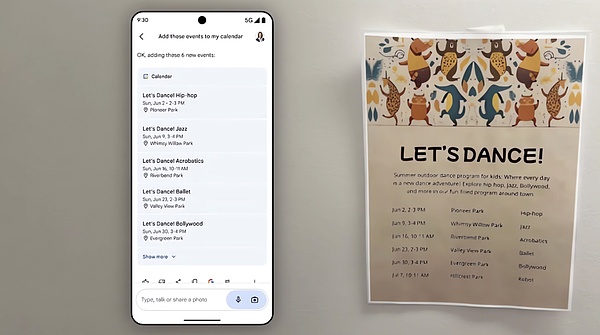

Sắp tới, Gems và Gemini sẽ có thể tận dụng khả năng tích hợp mở rộng với Google dịch vụ, Bao gồm Lịch Google, Nhiệm vụ, Keep và YouTube Music cho nhiều nhiệm vụ tiết kiệm sức lao động.

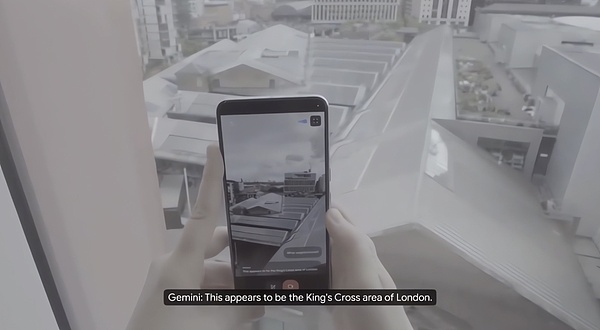

3) Gemini Live

< p>Google đã xem trước một trải nghiệm mới trong Gemini có tên là Gemini Live, cho phép người dùng trò chuyện thoại "sâu" với Gemini trên điện thoại thông minh của họ.

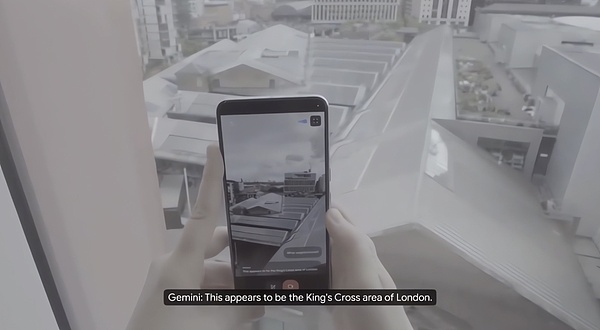

Người dùng có thể ngắt lời Gemini khi chatbot đang nói để đặt những câu hỏi làm rõ vấn đề và chatbot sẽ điều chỉnh theo kiểu nói của họ trong thời gian thực. Gemini có thể nhìn và phản ứng với môi trường xung quanh người dùng thông qua ảnh hoặc video được quay bằng camera của điện thoại thông minh.

Google cho biết họ tận dụng các công nghệ AI tiên tiến mới để mang lại khả năng phân tích hình ảnh vượt trội, ít xảy ra lỗi hơn và kết hợp các công nghệ này với công cụ phát âm nâng cao để tạo ra lời nói nhất quán, biểu đạt cảm xúc và chân thực hơn trong nhiều vòng đối thoại.

Ở một mức độ nào đó, Gemini Live là sự kết hợp giữa Google Lens (nền tảng thị giác máy tính lâu đời của Google để phân tích hình ảnh và video) và Google Assistant (Sự phát triển của việc tạo và nhận dạng giọng nói được điều khiển bởi trí tuệ nhân tạo của Google). trợ lý ảo).

Oriol Vinyals, nhà khoa học trưởng tại DeepMind, cho biết đây là giao diện giọng nói thời gian thực với khả năng đa phương thức cực kỳ mạnh mẽ và bối cảnh dài.

Sự đổi mới công nghệ thúc đẩy Live một phần bắt nguồn từ Project Astra, một sáng kiến mới trong DeepMind nhằm tạo ra các ứng dụng và tác nhân do AI điều khiển cho phép hiểu biết đa phương thức, theo thời gian thực.

Giám đốc điều hành DeepMind Demis Hassabis cho biết Google luôn muốn xây dựng một tác nhân thông minh tổng thể hữu ích trong cuộc sống hàng ngày. và phản ứng nhanh chóng trong các cuộc trò chuyện, giúp tốc độ và chất lượng tương tác trở nên tự nhiên hơn.

Gemini Live, dự kiến sẽ ra mắt vào cuối năm nay, có thể trả lời các câu hỏi về những thứ trong (hoặc gần nhất) tầm nhìn của camera điện thoại thông minh, chẳng hạn như người dùng có thể ở khu vực lân cận nào hoặc một chiếc xe đạp bị hư hỏng. Chỉ vào một phần mã máy tính và Live có thể giải thích mã đó làm gì. Hoặc, khi được hỏi một cặp kính có thể ở đâu, Live có thể cho biết lần cuối nó "nhìn thấy" chiếc kính là ở đâu.

Live cũng được thiết kế như một loại huấn luyện viên ảo để giúp người dùng luyện tập các hoạt động và lên ý tưởng chờ đợi. Ví dụ: Live có thể đề xuất những kỹ năng cần nhấn mạnh trong công việc sắp tới hoặc cuộc phỏng vấn thực tập hoặc đưa ra lời khuyên khi nói trước công chúng.

Một điểm khác biệt lớn giữa ChatGPT mới và Gemini Live là Gemini Live không miễn phí. Sau khi ra mắt, Live sẽ dành riêng cho Gemini Advanced, một phiên bản phức tạp hơn của Gemini được bao gồm trong Gói Google One AI Premium và có giá 20 USD mỗi tháng.

4) Gemini Nano

< p>Google cũng đã tích hợp trực tiếp mô hình AI nhỏ nhất Gemini Nano vào ứng dụng khách Chrome dành cho máy tính để bàn bắt đầu từ Chrome 126. Google cho biết điều này sẽ cho phép các nhà phát triển sử dụng các mô hình trên thiết bị để cung cấp năng lượng cho các tính năng AI của riêng họ. Ví dụ: Google có kế hoạch sử dụng tính năng mới này để hỗ trợ các tính năng như công cụ “Giúp tôi viết” hiện có của Workspace Lab trong Gmail.

Giám đốc quản lý sản phẩm Google Chrome Jon Dahlke đã chỉ ra rằng Google đang đàm phán với các nhà cung cấp trình duyệt khác để kích hoạt tính năng này hoặc tương tự chức năng trong trình duyệt của bạn.

Giám đốc quản lý sản phẩm Google Chrome Jon Dahlke đã chỉ ra rằng Google đang đàm phán với các nhà cung cấp trình duyệt khác để kích hoạt tính năng này hoặc tương tự chức năng trong trình duyệt của bạn.

5) Gemini trên Android

Gemini của Google trên Android là AI sự thay thế cho Trợ lý Google sẽ sớm ra mắt. Khả năng phân tích sâu tích hợp với hệ điều hành di động Android và ứng dụng Google.

Người dùng sẽ có thể kéo AI hình ảnh được tạo trực tiếp vào Gmail của họ , Tin nhắn của Google và các ứng dụng khác.

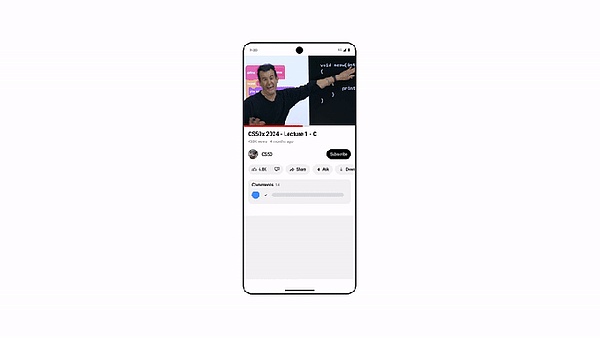

Google cho biết trong thời gian chờ đợi, người dùng YouTube sẽ có thể nhấp vào "Hỏi about this video ” để tìm thông tin cụ thể từ video YouTube này.

Người dùng mua phiên bản nâng cấp của Gemini Advanced cũng có thể sử dụng tùy chọn "Hỏi bản PDF này", tùy chọn này cho phép bạn nhận câu trả lời từ tài liệu mà không cần đọc tất cả các trang. Người đăng ký Gemini Advanced trả 19,99 USD mỗi tháng để truy cập AI và nhận 2TB dung lượng lưu trữ cùng với các lợi ích khác của Google One.

Google cho biết các tính năng mới nhất trong Gemini dành cho Android sẽ được triển khai tới hàng trăm triệu thiết bị được hỗ trợ trong những tháng tới. Theo thời gian, Song Tử sẽ phát triển để đưa ra những gợi ý bổ sung liên quan đến nội dung trên màn hình.

Đồng thời, mẫu cơ bản Gemini Nano trên thiết bị Android sẽ được nâng cấp để bao gồm đa phương thức. Điều này có nghĩa là nó sẽ có thể xử lý văn bản nhập cũng như các cách xử lý thông tin khác, bao gồm hình ảnh, âm thanh và ngôn ngữ nói.

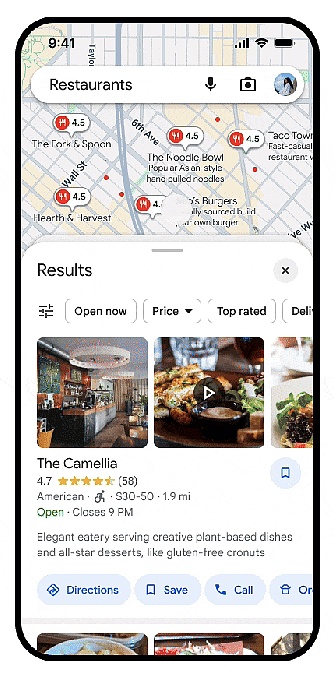

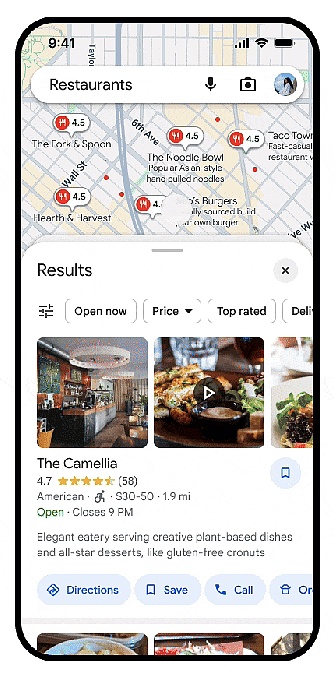

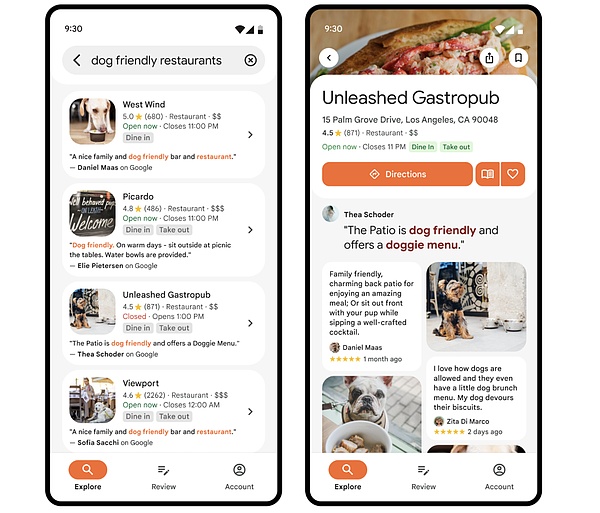

6) Gemini

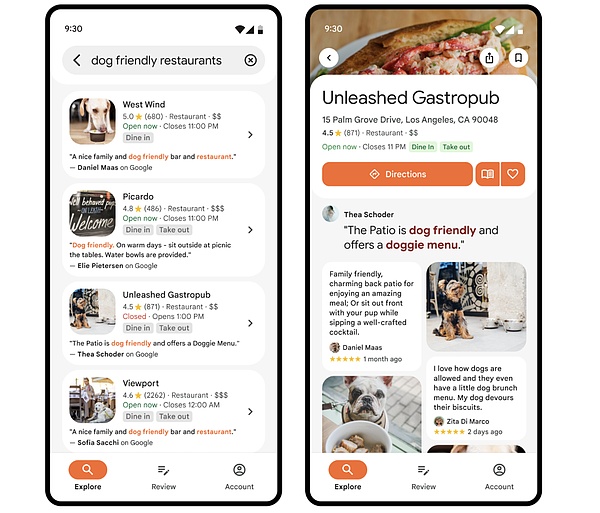

Bắt đầu từ API Địa điểm, chức năng mô hình Gemini trên Google Maps It sẽ được ra mắt trên nền tảng Google Maps để các nhà phát triển sử dụng. Nhà phát triển có thể hiển thị bản tóm tắt AI được tạo về các địa điểm và khu vực trong ứng dụng và trang web của họ. Những bản tóm tắt này được tạo dựa trên những hiểu biết sâu sắc của Gemini về cộng đồng Google Maps gồm hơn 300 triệu người đóng góp.

Những bản tóm tắt này được tạo dựa trên những hiểu biết sâu sắc của Gemini về cộng đồng Google Maps gồm hơn 300 triệu người đóng góp. Với tính năng mới này, các nhà phát triển sẽ không cần phải viết mô tả vị trí tùy chỉnh của riêng họ nữa.

Ví dụ: nếu nhà phát triển có ứng dụng đặt chỗ nhà hàng thì The tính năng mới sẽ giúp người dùng hiểu nhà hàng nào phù hợp nhất với họ. Khi người dùng tìm kiếm nhà hàng trong ứng dụng, họ sẽ có thể nhanh chóng xem tất cả thông tin quan trọng nhất, chẳng hạn như các món đặc biệt của nhà hàng, ưu đãi giờ khuyến mãi và không khí nhà hàng.

Các bản tóm tắt mới có sẵn cho nhiều loại địa điểm, bao gồm nhà hàng, cửa hàng, siêu thị, công viên và rạp chiếu phim. Google cũng đang đưa kết quả tìm kiếm theo ngữ cảnh do AI điều khiển vào API Địa điểm. Khi người dùng tìm kiếm địa điểm trong sản phẩm của họ, nhà phát triển hiện có thể hiển thị các bài đánh giá và ảnh liên quan đến tìm kiếm của họ.

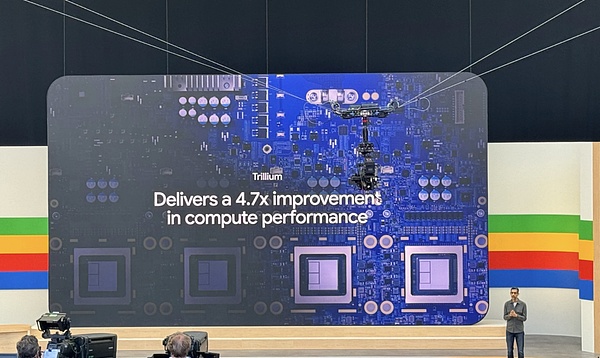

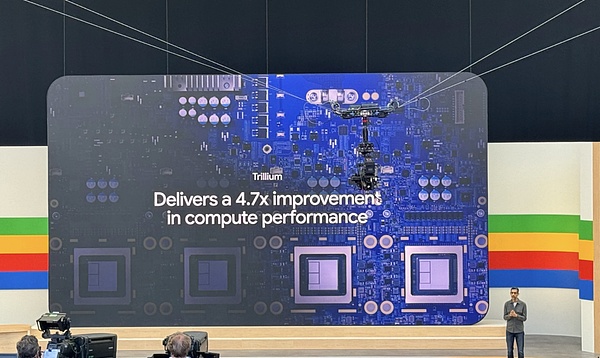

7) Hiệu suất của TPU được cải thiện

Google đã ra mắt thế hệ tiếp theo – chính xác là thế hệ thứ sáu – chip TPU AI. Chúng được gọi là Trillium và sẽ ra mắt vào cuối năm nay. Nếu bạn còn nhớ, việc công bố TPU thế hệ tiếp theo đã trở thành truyền thống tại các hội nghị I/O, mặc dù các con chip này chỉ mới ra mắt vào cuối năm nay.

So với thế hệ thứ năm, điện toán trên mỗi chip của các thiết bị mới này Hiệu suất của TPU sẽ được cải thiện gấp 4,7 lần. Trillium có SparseCore thế hệ thứ ba mà Google mô tả là "một công cụ tăng tốc được xây dựng có mục đích để xử lý các phần nhúng rất lớn thường gặp trong khối lượng công việc đề xuất và xếp hạng nâng cao.

Pichai đã mô tả chip mới này là "lớn nhất" của Google " Ông cho biết, TPU tiết kiệm năng lượng, đặc biệt quan trọng khi nhu cầu về chip AI tiếp tục tăng theo cấp số nhân.

Trong sáu năm qua, nhu cầu của ngành về điện toán ML đã tăng 1 triệu lần, ông nói, và ngày càng tăng khoảng 10 lần mỗi năm, sẽ không bền vững nếu không đầu tư vào việc giảm yêu cầu tiêu thụ điện năng của những con chip này. Google hứa hẹn rằng TPU mới tiết kiệm năng lượng hơn 67% so với chip thế hệ thứ năm.

< img src. ="https://img.jinse.cn/7225353_image3.png">

Ngoài ra, Google đã bổ sung thêm mô hình tham số 27 tỷ mới trong Gemma 2. Thế hệ tiếp theo của mô hình Google Gemma sẽ được phát hành vào năm 6. Ra mắt vào tháng 3, Google cho biết hệ số dạng này được Nvidia tối ưu hóa để chạy trên GPU thế hệ tiếp theo và có thể chạy hiệu quả trên một máy chủ TPU duy nhất và Vertex AI

2.

1) Imagen3

Google vừa ra mắt sản phẩm mới nhất của mô hình Imagen-Imagen 3. Giám đốc điều hành DeepMind, Demis Hassabis cho biết, so với người tiền nhiệm Imagen 2, Imagen 3 có thể hiểu chính xác hơn các lời nhắc văn bản được dịch sang hình ảnh và chính xác hơn so với Các thế hệ trước của nó sáng tạo và chi tiết hơn

Google vừa ra mắt sản phẩm mới nhất của mô hình Imagen-Imagen 3. Giám đốc điều hành DeepMind, Demis Hassabis cho biết, so với người tiền nhiệm Imagen 2, Imagen 3 có thể hiểu chính xác hơn các lời nhắc văn bản được dịch sang hình ảnh và chính xác hơn so với Các thế hệ trước của nó sáng tạo và chi tiết hơn

Để xoa dịu những lo ngại về khả năng xảy ra các hành vi giả mạo sâu, Google cho biết Imagen 3 sẽ sử dụng SynthID, một phương pháp do DeepMind phát triển để áp dụng mã hóa cho các hình mờ <. /p>

Công cụ ImageFX của Google có thể đăng ký bản xem trước riêng tư của Imagen 3 và Google cho biết mô hình này sẽ "sớm" được cung cấp cho các nhà phát triển sử dụng Vertex AI, nền tảng phát triển AI dành cho doanh nghiệp của Google và khách hàng doanh nghiệp. >

2) Mô hình tạo video Veo

Google đang nhắm mục tiêu Sora của OpenAI với Veo, một mô hình AI có thể tạo các đoạn video 1080p dài khoảng một phút dựa trên lời nhắc bằng văn bản. Veo có thể ghi lại các phong cách hình ảnh và điện ảnh khác nhau, bao gồm phong cảnh và cảnh quay tua nhanh thời gian, đồng thời chỉnh sửa và điều chỉnh cảnh quay thu được.

Nó cũng được xây dựng dựa trên sản phẩm thương mại sơ bộ trong lĩnh vực tạo video mà Google đã xem trước vào tháng 4, sử dụng loạt mô hình tạo hình ảnh Imagen 2 của công ty để tạo các video clip lặp lại.

Demis Hassabis cho biết Google đang khám phá các tính năng như tạo kịch bản phân cảnh và tạo ra những cảnh dài hơn để hiểu những gì Veo có thể làm và rằng Google đã đạt được tiến bộ đáng kinh ngạc trong lĩnh vực video.

Veo đã được đào tạo về rất nhiều cảnh quay. Đây là cách các mô hình AI tổng hợp hoạt động: đưa ra hết ví dụ này đến ví dụ khác về một số dạng dữ liệu, các mô hình sẽ chọn các mẫu trong dữ liệu cho phép chúng tạo ra dữ liệu mới—trong trường hợp của Veo là video.

Tuy nhiên, Google đã cung cấp Veo cho những người sáng tạo được chọn, Trong số đó có Donald Glover (hay còn gọi là Childish Gambino) và công ty sáng tạo Gilga của ông.

3) Mô hình LearnLM

Google đã ra mắt LearnLM, một dòng mô hình AI mới được "tinh chỉnh" cho việc học tập. Đây là sự hợp tác giữa bộ phận nghiên cứu AI DeepMind của Google và Google Research. Google cho biết mô hình LearnLM được thiết kế để dạy kèm học sinh "đàm thoại" về nhiều môn học.

LearnLM đã có sẵn trên nhiều nền tảng của Google và đang được cung cấp thông qua Google Dự án thí điểm lớp học sử dụng LearnLM. Google cho biết LearnLM có thể giúp giáo viên khám phá những ý tưởng, nội dung và hoạt động mới hoặc tìm tài liệu phù hợp với nhu cầu của các nhóm học sinh cụ thể.

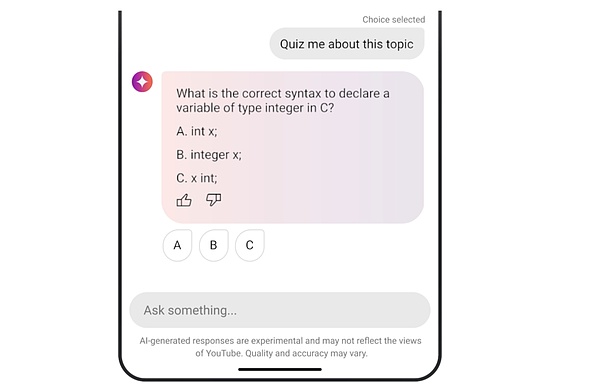

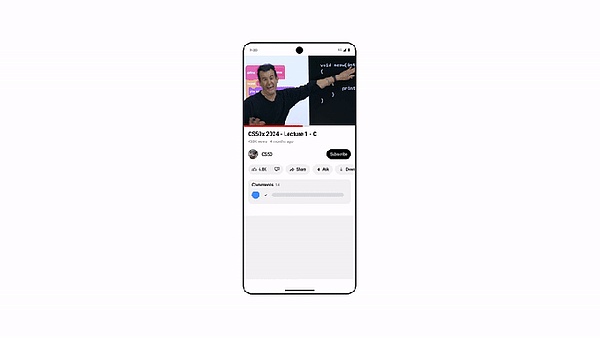

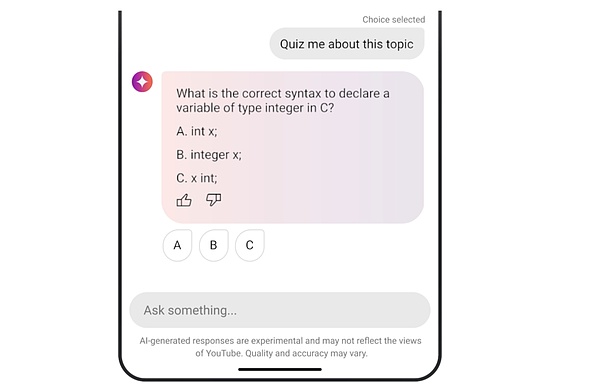

Tính năng mới của YouTube là ;các câu đố được tạo ra. Công cụ AI đàm thoại mới này cho phép người dùng "giơ tay" một cách tượng trưng khi xem các video giáo dục. Người xem có thể đặt những câu hỏi làm rõ, nhận được những lời giải thích hữu ích hoặc làm các câu đố về các chủ đề.

Điều này sẽ giúp những người phải xem các video giáo dục dài hơn, chẳng hạn như bài giảng hoặc hội thảo, cảm thấy nhẹ nhõm nhờ khả năng ngữ cảnh dài của mô hình Gemini, đang được triển khai cho một số thiết bị Android trong Người dùng Hoa Kỳ đã ra mắt.

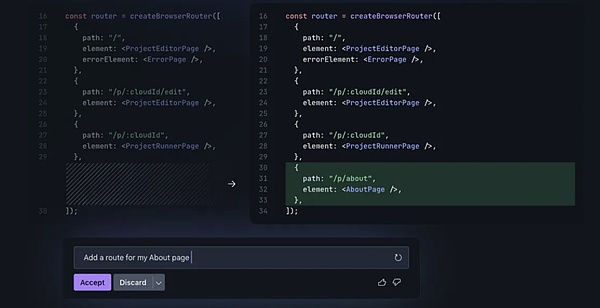

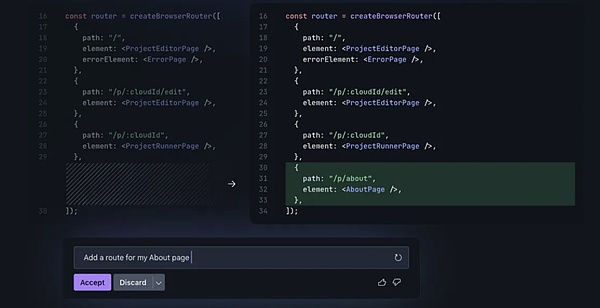

4) Project IDX

Project IDX là môi trường phát triển dựa trên trình duyệt, tập trung vào AI, thế hệ tiếp theo của Google, hiện đã có sẵn Đang bước vào giai đoạn thử nghiệm công khai giai đoạn.

Jeanine Banks, Phó chủ tịch Google, Tổng giám đốc và Trưởng phòng phát triển Khi AI trở thành phổ biến hơn, sự phức tạp đi kèm với việc triển khai tất cả các công nghệ này thực sự ngày càng trở nên khó khăn và lớn hơn và Google muốn giúp giải quyết thách thức đó. Quan hệ nhà phát triển, đó là lý do tại sao Dự án IDX được xây dựng.

IDX là trải nghiệm phát triển đa nền tảng giúp xây dựng ứng dụng nhanh chóng và dễ dàng với các mẫu dễ sử dụng cho Next.js, Astro, Flutter, Dart, Angular, Go, v.v. Sử dụng tùy chọn của bạn khuôn khổ hoặc ngôn ngữ.

Ngoài ra, Google đang bổ sung tính năng tích hợp với Nền tảng Google Maps vào IDE để giúp bổ sung khả năng định vị địa lý cho các ứng dụng của mình, cũng như tích hợp với Chrome Dev Tools và Lighthouse để giúp gỡ lỗi ứng dụng. Sắp tới, Google cũng sẽ hỗ trợ triển khai ứng dụng lên Cloud Run, nền tảng serverless của Google Cloud để chạy các dịch vụ front-end và back-end.

Môi trường phát triển cũng sẽ được tích hợp với nền tảng tuân thủ do AI điều khiển của Google, Checks, nền tảng này sẽ chuyển từ giai đoạn beta sang sản xuất vào thứ Ba. Tất nhiên, IDX không chỉ xây dựng các ứng dụng hỗ trợ AI mà còn sử dụng AI trong quá trình mã hóa.

Để kích hoạt tính năng này, IDX bao gồm nhiều tính năng hiện đã trở thành tiêu chuẩn, chẳng hạn như hoàn thành mã và thanh bên hỗ trợ trò chuyện, cũng như các tính năng cải tiến, chẳng hạn như khả năng làm nổi bật các đoạn mã và các tính năng tương tự như vậy được tìm thấy trong Photoshop Tính năng Tạo dân số yêu cầu mô hình Gemini của Google thay đổi đoạn mã.

Bất cứ khi nào Gemini đề xuất mã, nó sẽ liên kết trở lại nguồn ban đầu và giấy phép liên quan của nó . Project IDX được Google xây dựng với Visual Studio Code nguồn mở làm cốt lõi và nó cũng tích hợp với GitHub để dễ dàng tích hợp với các quy trình công việc hiện có. Ở một trong những phiên bản mới nhất của IDX, Google cũng đã bổ sung thêm trình giả lập iOS và Android tích hợp vào IDE dành cho nhà phát triển thiết bị di động.

3. Cập nhật ứng dụng và công cụ

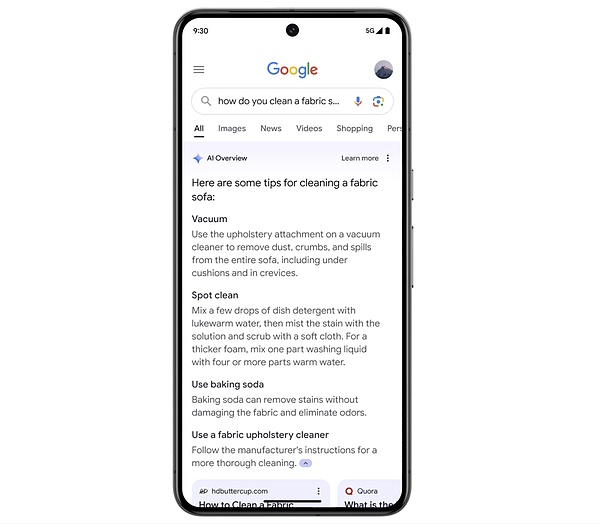

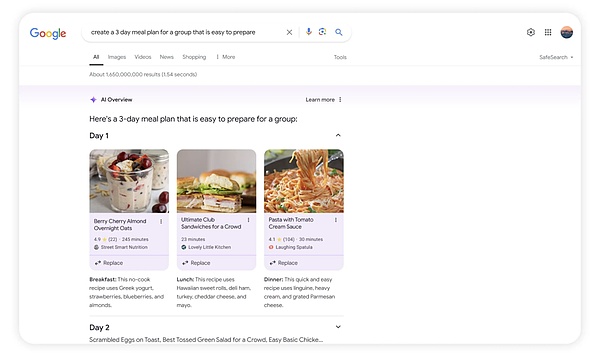

1) Ứng dụng AI trong Tìm kiếm

Google giám đốc tìm kiếm Liz Reid cho biết Google đã xây dựng mô hình Gemini tùy chỉnh để tìm kiếm kết hợp thông tin thời gian thực, thứ hạng của Google, ngữ cảnh dài và các tính năng đa phương thức.

Google đang bổ sung thêm AI vào tìm kiếm của mình, giúp mọi người thoải mái hơn. rằng công ty đang mất thị phần vào tay các đối thủ như ChatGPT và Perplexity.

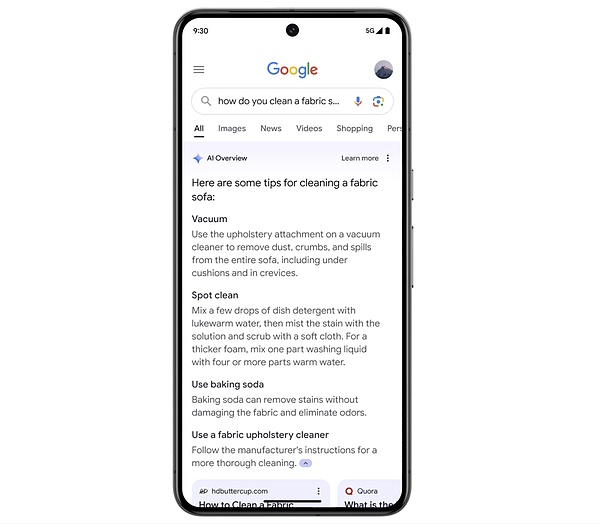

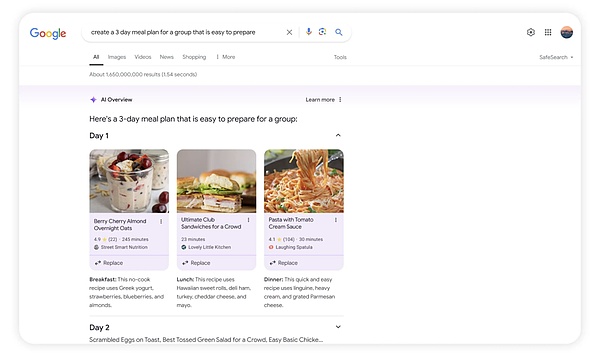

Google đang triển khai bản tổng quan dựa trên AI cho người dùng Hoa Kỳ. Ngoài ra, công ty hy vọng sẽ sử dụng Gemini làm đại lý cho những việc như lập kế hoạch du lịch.

Google có kế hoạch sử dụng AI sáng tạo để sắp xếp toàn bộ trang kết quả tìm kiếm cho một số kết quả tìm kiếm nhất định. Tính năng này bổ sung cho tính năng AI Tổng quan hiện có, tính năng này tạo ra một đoạn mã ngắn chứa thông tin tổng hợp về chủ đề bạn đang tìm kiếm. Sau một thời gian tham gia chương trình AI Labs của Google, tính năng Tổng quan về AI sẽ khả dụng rộng rãi vào thứ Ba.

Google đã thử nghiệm Trải nghiệm tạo ra tìm kiếm (SGE) kể từ năm ngoái AI- tổng quan định hướng. Giờ đây, dịch vụ này sẽ được triển khai cho "hàng trăm triệu người dùng" ở Hoa Kỳ trong tuần này, với mục tiêu cung cấp dịch vụ cho hơn một tỷ người vào cuối năm nay.

Cô cũng cho biết trong quá trình thử nghiệm tính năng tổng quan về AI, Google đã quan sát thấy mọi người nhấp vào nhiều trang web đa dạng hơn. Người dùng sẽ không nhìn thấy tổng quan về AI khi tìm kiếm truyền thống đủ để cung cấp kết quả và tính năng này hữu ích hơn cho các truy vấn phức tạp hơn với thông tin rải rác.

Ngoài ra, Google cũng hy vọng sử dụng Gemini như một tác nhân thông minh để hoàn thành bữa ăn hoặc nhiệm vụ Lập kế hoạch du lịch. Người dùng có thể nhập truy vấn chẳng hạn như "Lên kế hoạch bữa ăn trong ba ngày cho gia đình bốn người" và nhận các liên kết cũng như công thức nấu ăn cho ba ngày đó.

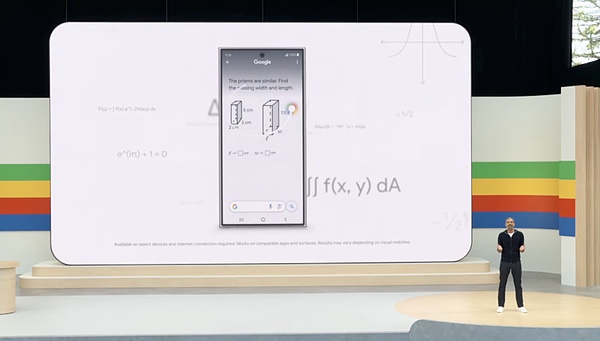

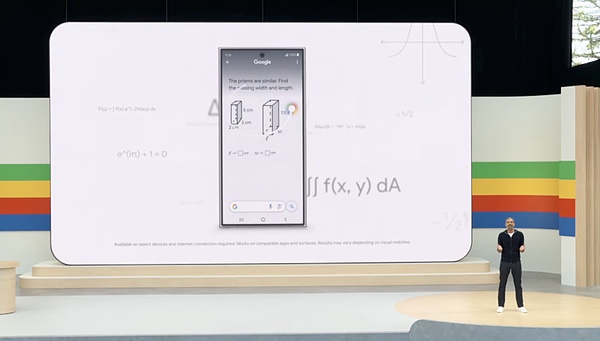

2) Tìm kiếm vòng kết nối

< p>Tính năng Tìm kiếm vòng tròn được hỗ trợ bởi AI cho phép người dùng Android nhận được câu trả lời ngay lập tức bằng cách sử dụng các cử chỉ như quay vòng tròn, giờ đây sẽ có thể giải quyết các vấn đề về tâm lý học và toán học phức tạp hơn.

Tính năng này được thiết kế để giúp việc sử dụng Google Tìm kiếm trở nên tự nhiên hơn bằng các hành động như khoanh tròn, đánh dấu, vẽ nguệch ngoạc hoặc nhấp chuột từ bất kỳ đâu trên điện thoại của bạn.

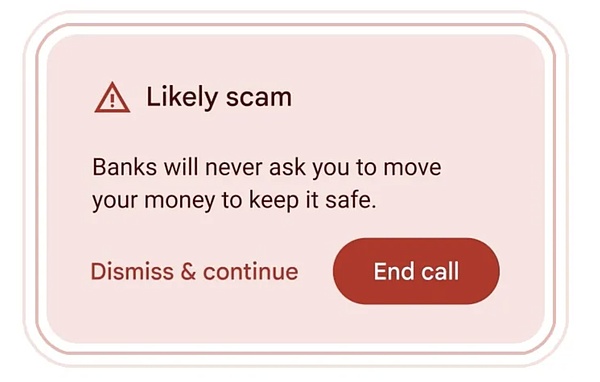

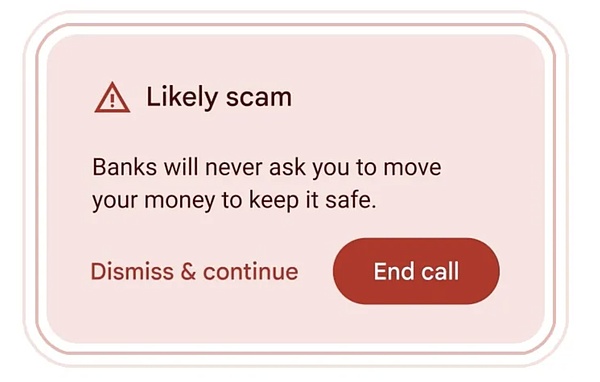

3) Phát hiện gian lận trong cuộc gọi

< / p>

< / p>

Google đã xem trước một tính năng mà họ tin rằng sẽ cảnh báo người dùng về những hành vi lừa đảo tiềm ẩn trong các cuộc gọi điện thoại.

Tính năng này sẽ được tích hợp trong các phiên bản Android trong tương lai, tận dụng Gemini Nano, phiên bản nhỏ nhất của các sản phẩm AI tổng hợp của Google chạy hoàn toàn trên thiết bị. Hệ thống lắng nghe một cách hiệu quả trong thời gian thực về "các kiểu hội thoại thường liên quan đến lừa đảo".

Google đã đưa ra ví dụ về một người giả danh “đại diện ngân hàng”. Các chiến thuật lừa đảo phổ biến như yêu cầu mật khẩu và thẻ quà tặng cũng kích hoạt hệ thống. Đây đều là những cách phổ biến để moi tiền của bạn, nhưng nhiều người trên thế giới vẫn dễ bị tổn thương trước những kiểu lừa đảo này. Sau khi khởi chạy, nó sẽ bật lên một thông báo rằng người dùng có thể trở thành nạn nhân của những nhân vật không đáng tin cậy.

4) Yêu cầu ảnh

Google Photos đang tích hợp AI bằng việc ra mắt tính năng thử nghiệm có tên "Hỏi ảnh" được hỗ trợ bởi mô hình Gemini AI của Google. Tính năng mới, ra mắt vào cuối mùa hè này, sẽ cho phép người dùng tìm kiếm bộ sưu tập Google Photos của họ bằng cách sử dụng các truy vấn ngôn ngữ tự nhiên nhằm tận dụng AI sự hiểu biết về nội dung ảnh và siêu dữ liệu khác của họ.

Mặc dù trước khi người dùng có thể tìm kiếm những người, địa điểm hoặc sự vật cụ thể trong ảnh, bản nâng cấp AI sẽ giúp việc tìm kiếm nội dung phù hợp trở nên trực quan hơn và giảm bớt quá trình tìm kiếm thủ công nhờ xử lý ngôn ngữ tự nhiên.

5) Firebase Genkit

Nền tảng Firebase đã thêm A tính năng có tên Firebase Genkit nhằm mục đích giúp các nhà phát triển xây dựng các ứng dụng dựa trên AI bằng cách sử dụng JavaScript/TypeScript dễ dàng hơn và sắp có hỗ trợ cho Go.

Nền tảng Firebase đã thêm A tính năng có tên Firebase Genkit nhằm mục đích giúp các nhà phát triển xây dựng các ứng dụng dựa trên AI bằng cách sử dụng JavaScript/TypeScript dễ dàng hơn và sắp có hỗ trợ cho Go.

Đây là một framework nguồn mở, được cấp phép theo giấy phép Apache 2.0, cho phép các nhà phát triển nhanh chóng xây dựng AI vào các ứng dụng mới và hiện có.

Ngoài ra, Google nêu bật một số trường hợp sử dụng Genkit, bao gồm nhiều trường hợp sử dụng GenAI tiêu chuẩn: tạo và tóm tắt nội dung, dịch văn bản và tạo hình ảnh.

6) Google Play

< p>Google Play đang thu hút sự chú ý nhờ các tính năng khám phá ứng dụng mới, các cách mới để thu hút người dùng, nội dung cập nhật về Play Points và các điểm cải tiến khác đối với các công cụ dành cho nhà phát triển như Google Play SDK Console, Play Integrity API, v.v.

Các nhà phát triển đặc biệt quan tâm đến thứ gọi là Engage SDK, sẽ giới thiệu một cách để các nhà sản xuất ứng dụng trình bày nội dung của họ cho người dùng trong trải nghiệm toàn màn hình, sống động được cá nhân hóa cho người dùng cá nhân. Tuy nhiên, Google cho biết mặt đồng hồ này hiện không hiển thị với người dùng.

Weiliang

Weiliang

Giám đốc quản lý sản phẩm Google Chrome Jon Dahlke đã chỉ ra rằng Google đang đàm phán với các nhà cung cấp trình duyệt khác để kích hoạt tính năng này hoặc tương tự chức năng trong trình duyệt của bạn.

Giám đốc quản lý sản phẩm Google Chrome Jon Dahlke đã chỉ ra rằng Google đang đàm phán với các nhà cung cấp trình duyệt khác để kích hoạt tính năng này hoặc tương tự chức năng trong trình duyệt của bạn.

Google vừa ra mắt sản phẩm mới nhất của mô hình Imagen-Imagen 3. Giám đốc điều hành DeepMind, Demis Hassabis cho biết, so với người tiền nhiệm Imagen 2, Imagen 3 có thể hiểu chính xác hơn các lời nhắc văn bản được dịch sang hình ảnh và chính xác hơn so với Các thế hệ trước của nó sáng tạo và chi tiết hơn

Google vừa ra mắt sản phẩm mới nhất của mô hình Imagen-Imagen 3. Giám đốc điều hành DeepMind, Demis Hassabis cho biết, so với người tiền nhiệm Imagen 2, Imagen 3 có thể hiểu chính xác hơn các lời nhắc văn bản được dịch sang hình ảnh và chính xác hơn so với Các thế hệ trước của nó sáng tạo và chi tiết hơn

< / p>

< / p>

Nền tảng Firebase đã thêm A tính năng có tên Firebase Genkit nhằm mục đích giúp các nhà phát triển xây dựng các ứng dụng dựa trên AI bằng cách sử dụng JavaScript/TypeScript dễ dàng hơn và sắp có hỗ trợ cho Go.

Nền tảng Firebase đã thêm A tính năng có tên Firebase Genkit nhằm mục đích giúp các nhà phát triển xây dựng các ứng dụng dựa trên AI bằng cách sử dụng JavaScript/TypeScript dễ dàng hơn và sắp có hỗ trợ cho Go.