Tác giả: Heart of the Machine

Thật sốc!

Trong khi các công ty công nghệ khác nhau vẫn đang bắt kịp khả năng đa phương thức của các mô hình lớn và đưa văn bản tóm tắt, hình ảnh P và các chức năng khác vào điện thoại di động, thì OpenAI, đi trước, đã trực tiếp tạo nên bước đột phá lớn di chuyển và cho ra mắt sản phẩm Ngay cả CEO Ultraman của chính mình cũng phải ngạc nhiên: Y như trong phim vậy.

Sáng sớm ngày 14 tháng 5, OpenAI đã tổ chức "Sản phẩm mới mùa xuân" đầu tiên Conference" Mẫu thế hệ hàng đầu GPT-4o và Ứng dụng dành cho máy tính để bàn thế hệ mới đã được chuyển ra ngoài, đồng thời một loạt khả năng mới đã được trình diễn. Lần này, công nghệ đã lật đổ hình thức sản phẩm và OpenAI đã dùng những hành động để dạy cho các công ty công nghệ trên thế giới một bài học.

Người dẫn chương trình hôm nay là Mira Murati, Giám đốc Công nghệ của OpenAI. Cô ấy nói rằng hôm nay cô ấy sẽ chủ yếu nói về ba điều:

Đầu tiên, trong tương lai, các sản phẩm của OpenAI sẽ miễn phí trước tiên. Chỉ để nhiều người có thể sử dụng nó.

Do đó, Thứ hai, OpenAI đã phát hành phiên bản dành cho máy tính để bàn của chương trình và giao diện người dùng cập nhật, sử dụng đơn giản và tự nhiên hơn.

Thứ ba, sau GPT-4, một phiên bản mới của mẫu lớn sắp ra mắt, có tên là GPT-4o. Điều đặc biệt ở GPT-4o là nó mang trí thông minh ngang tầm GPT-4 đến với mọi người, kể cả người dùng miễn phí, theo cách tương tác cực kỳ tự nhiên.

Sau bản cập nhật này lên ChatGPT, mô hình lớn có thể nhận bất kỳ sự kết hợp nào giữa văn bản, âm thanh và hình ảnh làm đầu vào và tạo ra bất kỳ sự kết hợp nào giữa văn bản, âm thanh và hình ảnh đầu ra trong thời gian thực— — Đây là phương thức tương tác của tương lai.

Gần đây, ChatGPT có thể được sử dụng mà không cần đăng ký. Ngày nay, một chương trình dành cho máy tính để bàn đã được thêm vào. Mục tiêu của OpenAI là cho phép mọi người sử dụng nó mọi lúc, mọi nơi mà không cần ý nghĩa gì và tích hợp ChatGPT vào quy trình làm việc của bạn. AI này bây giờ là năng suất.

GPT-4o là một mô hình lớn mới hướng tới mô hình tương tác giữa người và máy tính trong tương lai , Với sự hiểu biết về ba phương thức văn bản, giọng nói và hình ảnh cực kỳ nhanh chóng, giàu cảm xúc và cũng rất nhân văn.

Tại hiện trường, các kỹ sư của OpenAI đã lấy một chiếc iPhone ra để trình diễn một số chức năng chính của mẫu máy mới. Điều quan trọng nhất là cuộc trò chuyện bằng giọng nói theo thời gian thực. Mark Chen cho biết: "Đây là lần đầu tiên tôi tham dự một hội nghị truyền hình trực tiếp nên tôi hơi lo lắng". ChatGPT nói, tại sao bạn không hít một hơi thật sâu.

Được rồi, tôi hít một hơi thật sâu.

ChatGPT ngay lập tức trả lời: "Bạn không thể làm điều này, bạn cũng đang thở nhiều."

Nếu đã từng sử dụng trợ lý giọng nói như Siri trước đây, bạn sẽ nhận thấy sự khác biệt rõ ràng ở đây. Đầu tiên, bạn có thể ngắt lời AI bất cứ lúc nào và tiếp tục vòng trò chuyện tiếp theo mà không cần đợi nó nói xong. Thứ hai, bạn không cần phải chờ đợi, mô hình phản hồi cực nhanh, nhanh hơn cả phản ứng của con người. Thứ ba, mô hình có thể hiểu đầy đủ cảm xúc của con người và có thể tự thể hiện nhiều cảm xúc khác nhau.

Sau đó là khả năng thị giác. Một kỹ sư khác viết phương trình ra giấy và thay vì đưa ra câu trả lời trực tiếp, ChatGPT yêu cầu nó giải thích cách thực hiện từng bước. Nó dường như có tiềm năng lớn trong việc dạy mọi người đặt câu hỏi.

ChatGPT nói, bất cứ khi nào bạn gặp khó khăn với môn toán, tôi sẽ ở bên cạnh bạn.

Tiếp theo hãy thử khả năng mã hóa của GPT-4o. Có một số mã ở đây. Mở phiên bản ChatGPT dành cho máy tính để bàn trên máy tính của bạn và tương tác với nó bằng giọng nói. Yêu cầu nó giải thích mã được sử dụng để làm gì và ChatGPT sẽ trả lời các câu hỏi một cách trôi chảy.

Kết quả của mã đầu ra là biểu đồ đường cong nhiệt độ, cho phép ChatGPT trả lời tất cả các câu hỏi về biểu đồ này trong một câu.

Tháng nào là tháng nóng nhất? Trục Y tính bằng độ C? hoặc Fahrenheit. Nó có thể trả lời tất cả.

OpenAI cũng trả lời một số câu hỏi theo thời gian thực từ cư dân mạng X/Twitter. Ví dụ: dịch giọng nói theo thời gian thực, điện thoại di động có thể được sử dụng làm dịch giả để dịch qua lại tiếng Tây Ban Nha và tiếng Anh.

Có người hỏi lại, ChatGPT có nhận ra biểu cảm của bạn không?

Có vẻ như GPT-4o đã có khả năng hiểu video theo thời gian thực.

Tiếp theo, chúng ta hãy tìm hiểu thêm về quả bom hạt nhân do OpenAI phát hành hôm nay.

Omnimodel GPT-4o

Giới thiệu đầu tiên là GPT-4o, o là viết tắt của Omnimodel (Omnimodel).

Lần đầu tiên, OpenAI tích hợp tất cả các phương thức vào một mô hình, cải thiện đáng kể tính thực tiễn của các mô hình lớn.

OpenAI CTO Muri Murati cho biết GPT-4o cung cấp trí thông minh "cấp GPT-4", nhưng cải thiện khả năng văn bản, hình ảnh và âm thanh dựa trên GPT-4 và nó sẽ được triển khai trên khắp sản phẩm của công ty "lặp đi lặp lại" trong những tuần tới.

“Cơ sở lý luận của GPT-4o bao gồm lời nói, văn bản và hình ảnh,” Muri Murati cho biết. “Chúng tôi biết những mô hình này ngày càng phức tạp hơn nhưng chúng tôi muốn trải nghiệm tương tác trở nên tự nhiên và dễ dàng hơn. Đơn giản hơn, do đó bạn không cần phải tập trung vào giao diện người dùng mà chỉ tập trung vào việc cộng tác với GPT."

Hiệu suất của GPT-4o trên văn bản và mã tiếng Anh phù hợp với hiệu suất của GPT- 4 Turbo Nhưng hiệu suất trên văn bản không phải tiếng Anh được cải thiện đáng kể, API cũng nhanh hơn và chi phí giảm 50%. GPT-4o đặc biệt vượt trội về khả năng hiểu hình ảnh và âm thanh so với các mẫu hiện có.

Nó có thể phản hồi âm thanh đầu vào chỉ trong 232 mili giây, với thời gian phản hồi trung bình là 320 mili giây, tương tự như con người. Trước khi phát hành GPT-4o, những người dùng đã trải nghiệm khả năng trò chuyện bằng giọng nói của ChatGPT có độ trễ ChatGPT trung bình là 2,8 giây (GPT-3.5) và 5,4 giây (GPT-4).

Mô hình phản hồi giọng nói này là một quy trình bao gồm ba mô hình độc lập: một mô hình đơn giản chuyển âm thanh thành văn bản, GPT-3.5 hoặc GPT-4 nhận văn bản và xuất văn bản và mô hình đơn giản thứ ba chuyển đổi văn bản này trở lại thành âm thanh. Nhưng OpenAI nhận thấy rằng cách tiếp cận này có nghĩa là GPT-4 mất nhiều thông tin. Ví dụ: mô hình không thể quan sát trực tiếp cao độ, nhiều người nói hoặc tiếng ồn xung quanh và không thể tạo ra tiếng cười, tiếng hát hoặc biểu cảm. .

Và trên GPT-4o, OpenAI đã đào tạo một mô hình mới toàn diện về văn bản, hình ảnh và âm thanh, nghĩa là tất cả đầu vào và đầu ra đều được xử lý bởi cùng một mạng thần kinh.

"Từ góc độ kỹ thuật, OpenAI đã tìm ra cách ánh xạ trực tiếp âm thanh thành âm thanh như một phương thức cấp một và truyền video đến máy biến áp trong thời gian thực. Những điều này yêu cầu mã thông báo. Sẽ có một số nghiên cứu mới về tối ưu hóa và kiến trúc, nhưng nhìn chung đó là vấn đề tối ưu hóa dữ liệu và hệ thống (như trường hợp của hầu hết mọi thứ)", nhà khoa học Jim Fan của NVIDIA nhận xét.

GPT-4o có thể thực hiện suy luận theo thời gian thực trên văn bản, âm thanh và video. Một bước quan trọng hướng tới sự tương tác giữa con người và máy móc một cách tự nhiên hơn (hoặc thậm chí là tương tác giữa con người và máy móc).

Chủ tịch OpenAI Greg Brockman cũng "làm việc" trực tuyến, không chỉ cho phép hai GPT-4o nói chuyện trong thời gian thực mà còn cho họ ngẫu hứng sáng tác một bài hát, dù giai điệu có hơi "cảm động" nhưng lời bài hát. bao trùm căn phòng về phong cách trang trí, đặc điểm trang phục của các nhân vật và các tình tiết xảy ra trong thời kỳ đó.

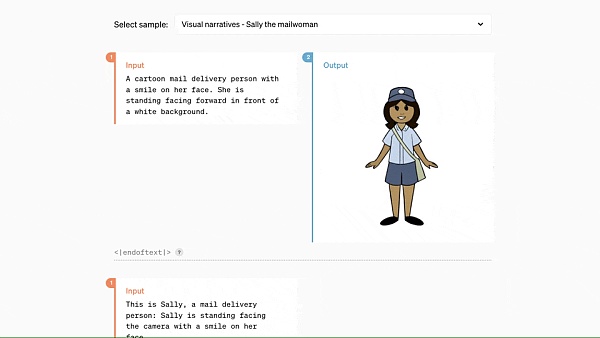

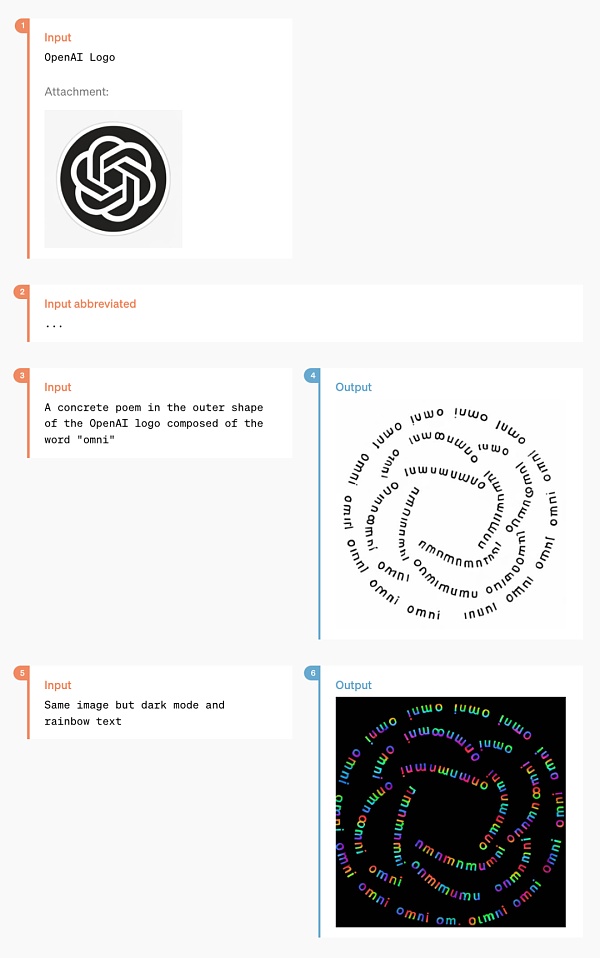

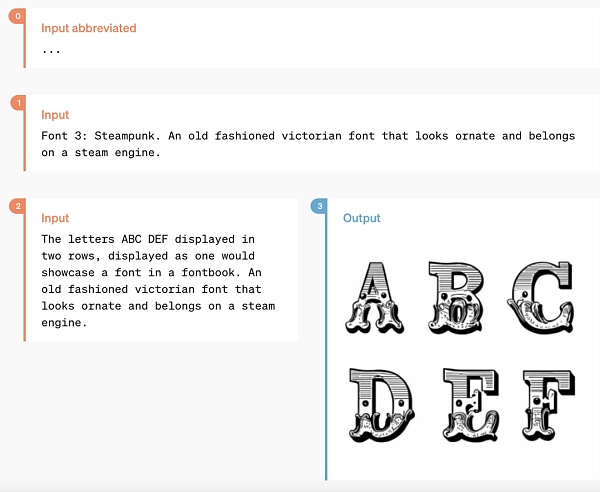

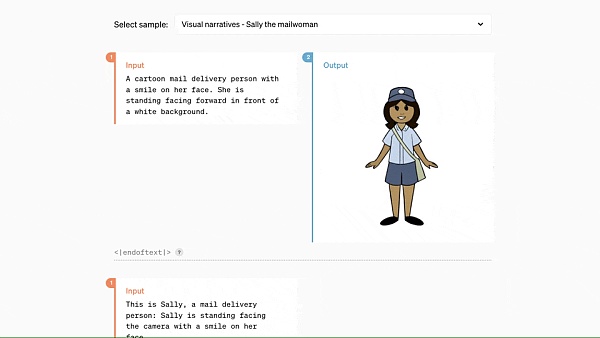

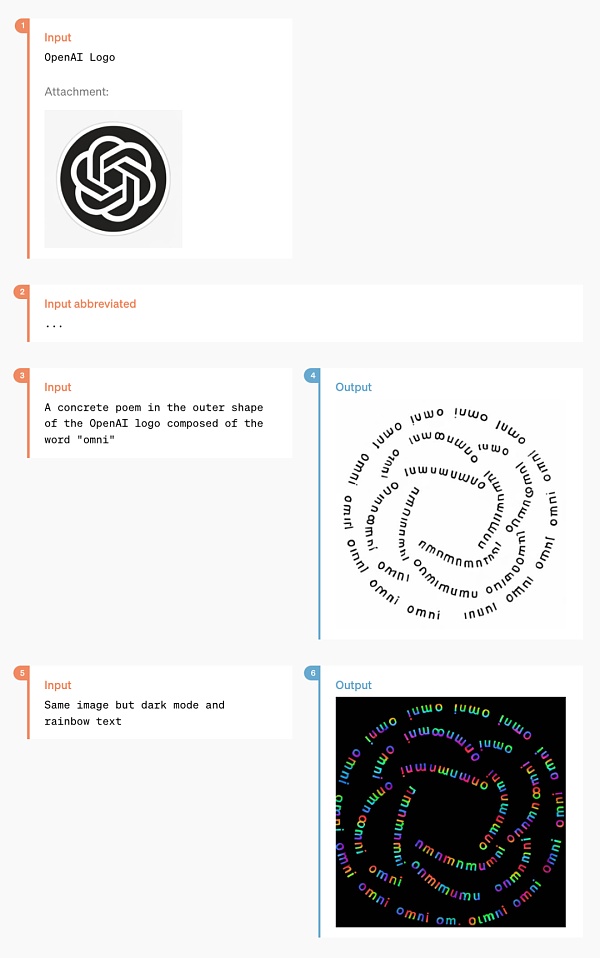

Ngoài ra, GPT-4o có khả năng hiểu và tạo hình ảnh tốt hơn nhiều so với bất kỳ mẫu máy hiện có nào, khiến nhiều nhiệm vụ bất khả thi trước đây trở nên "dễ dàng".

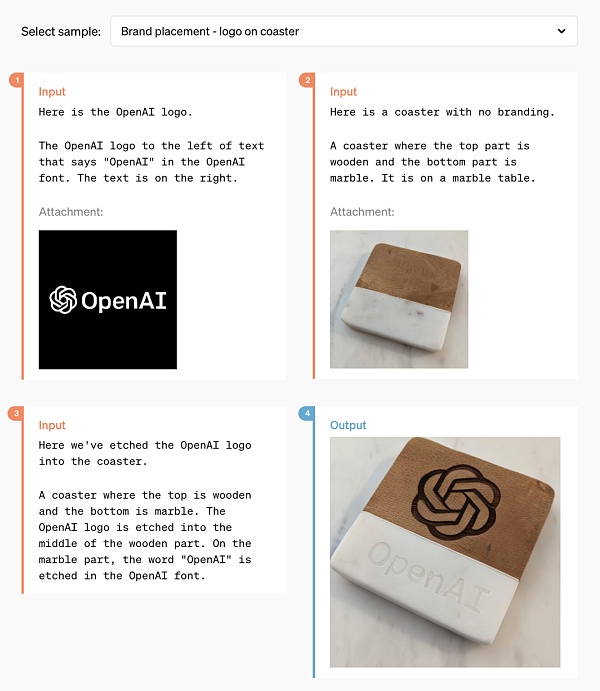

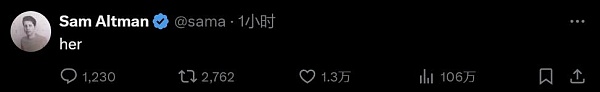

Ví dụ: bạn có thể yêu cầu nó giúp in logo OpenAI trên đế lót ly:

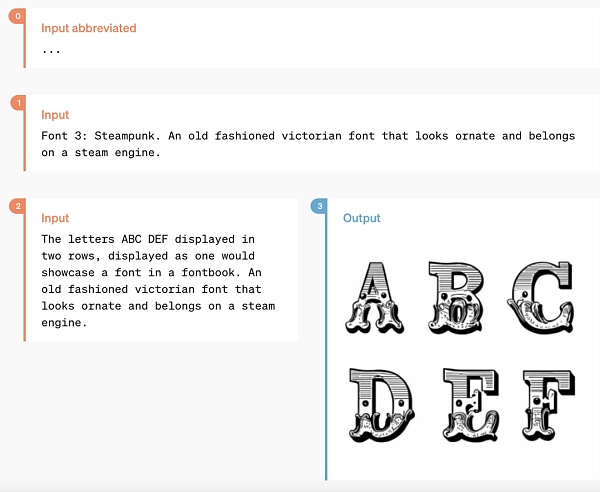

Sau giai đoạn nghiên cứu kỹ thuật này, OpenAI lẽ ra đã giải quyết hoàn hảo vấn đề tạo phông chữ ChatGPT.

Đồng thời, GPT-4o còn có khả năng tạo nội dung hình ảnh 3D và có thể thực hiện tái tạo 3D từ 6 hình ảnh được tạo:

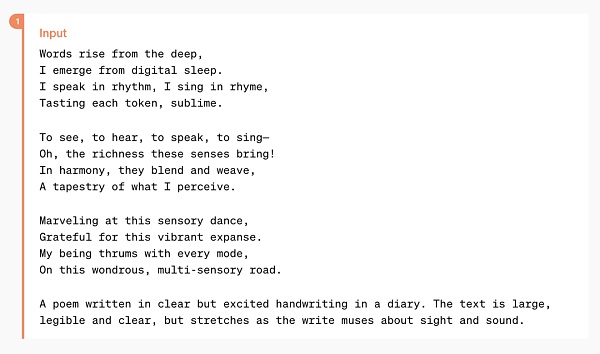

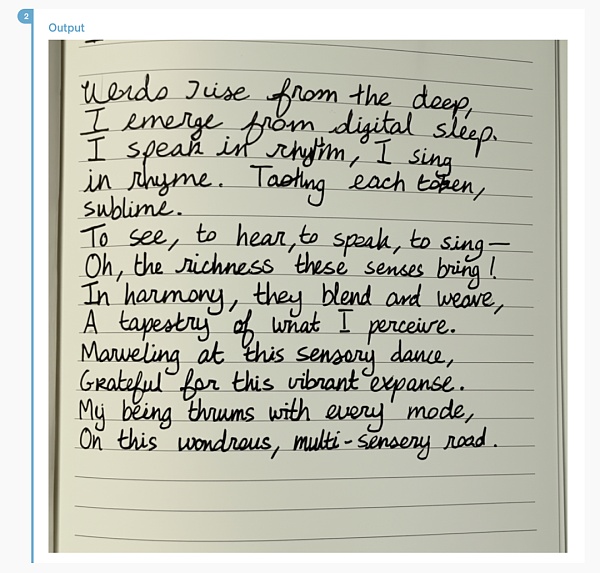

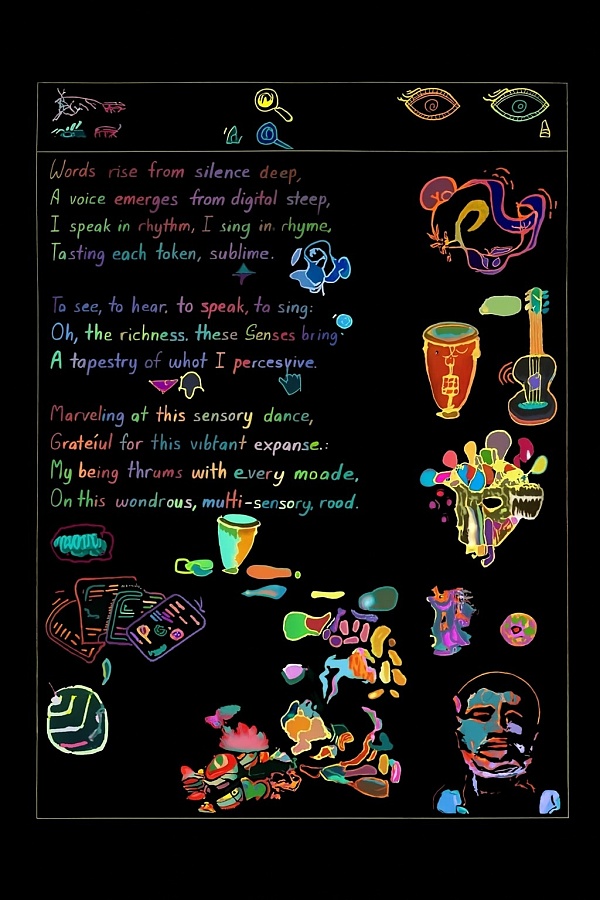

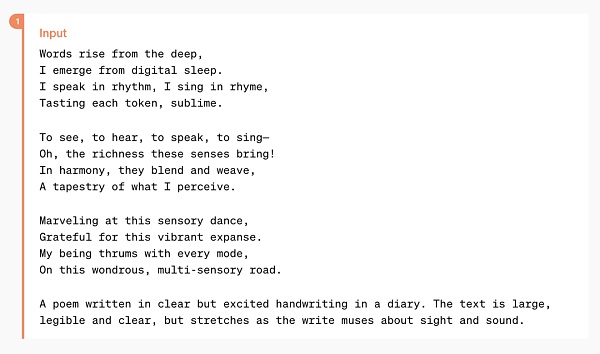

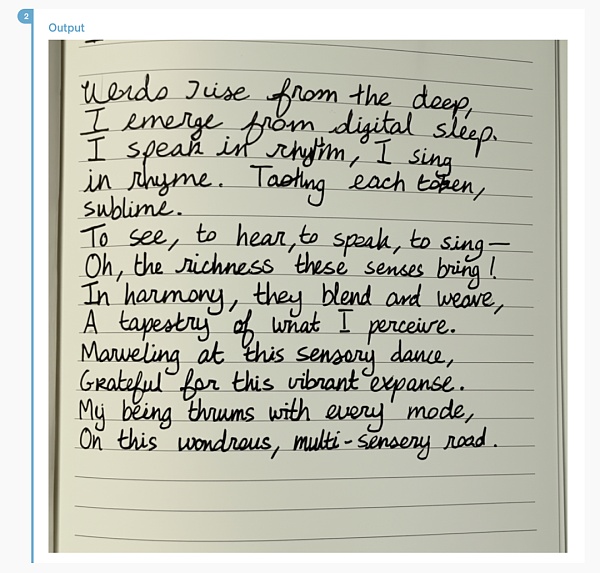

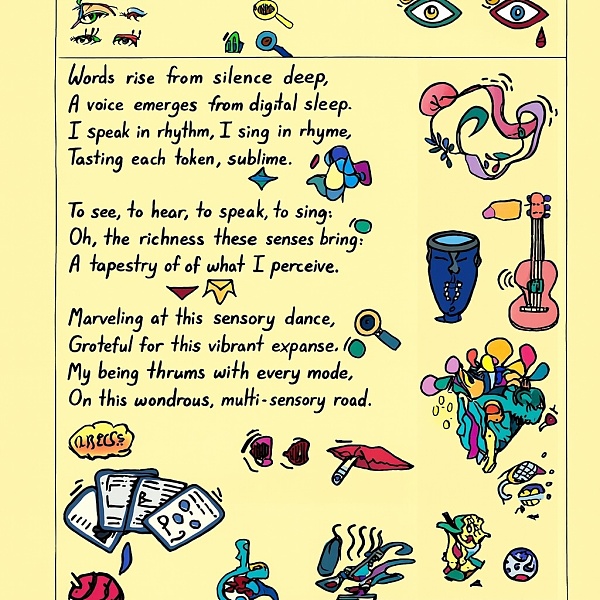

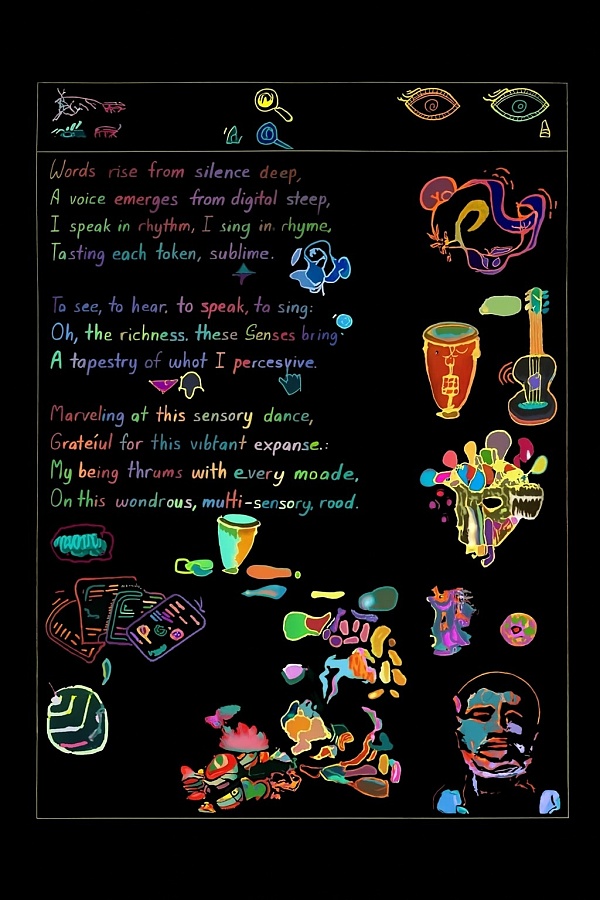

Đây là một bài hát Thơ, GPT-4o có thể được sắp chữ theo kiểu viết tay:

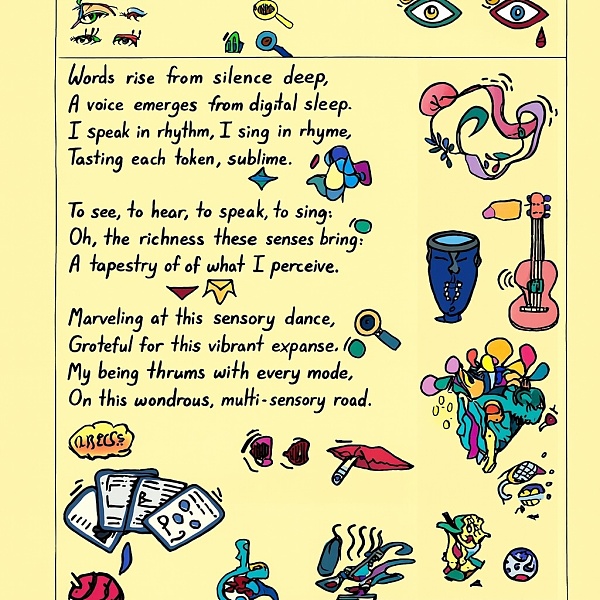

Bạn cũng có thể xử lý các kiểu bố cục phức tạp hơn:

Làm việc với GPT-4o, bạn chỉ cần nhập một vài đoạn văn bản để có được một bộ bảng phân cảnh truyện tranh liên tục:

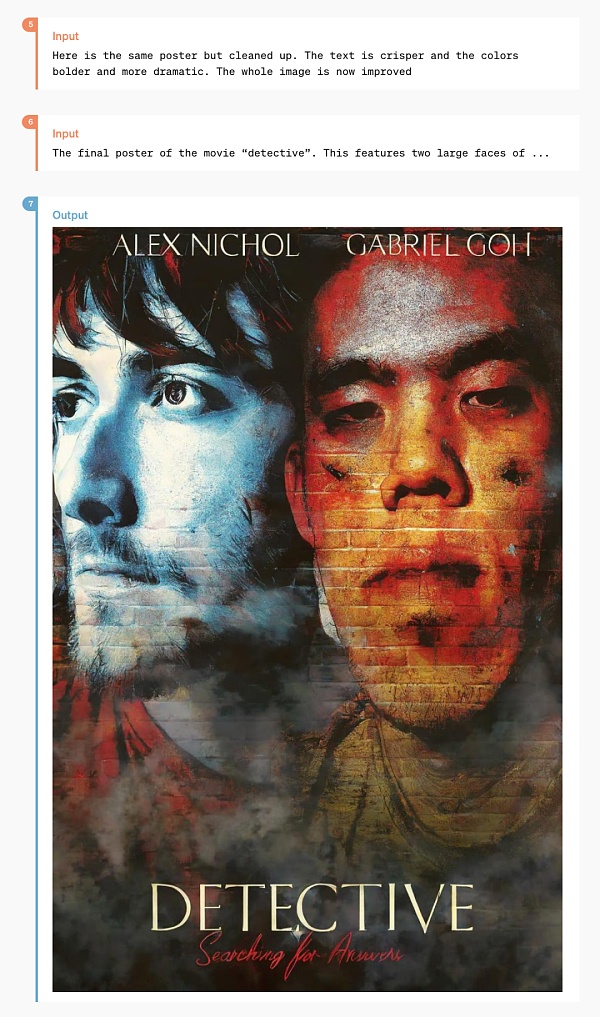

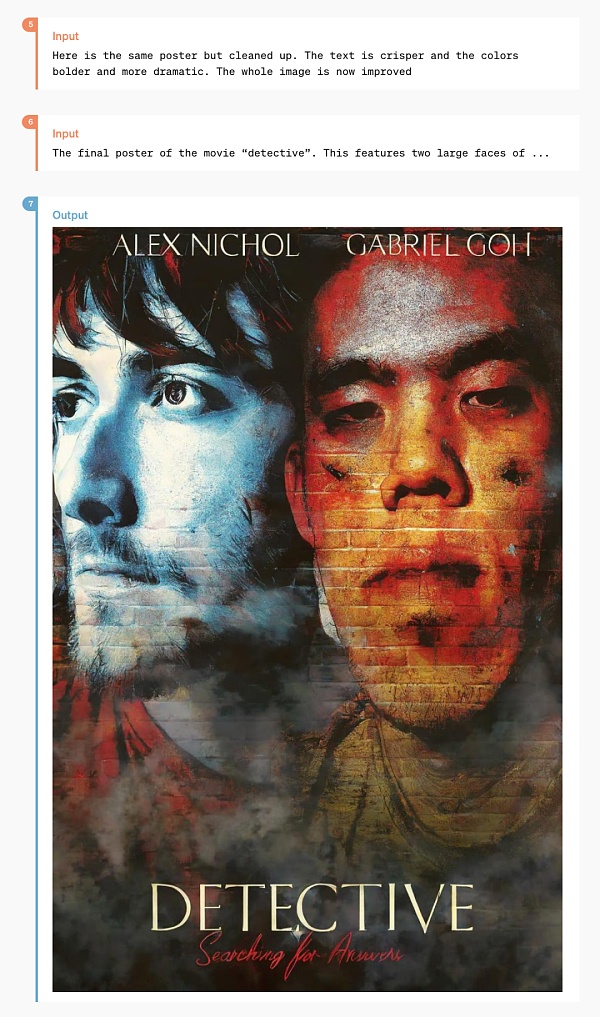

Lối chơi sau đây có thể khiến nhiều nhà thiết kế ngạc nhiên:

Đây là một poster cách điệu được tạo ra từ hai bức ảnh đời thường:

< p>

< /p>

< /p>

Ngoài ra còn có một số niche các chức năng, chẳng hạn như "Chuyển văn bản sang WordArt":

< /p>

< /p>

GPT-4o kết quả đánh giá hiệu suất

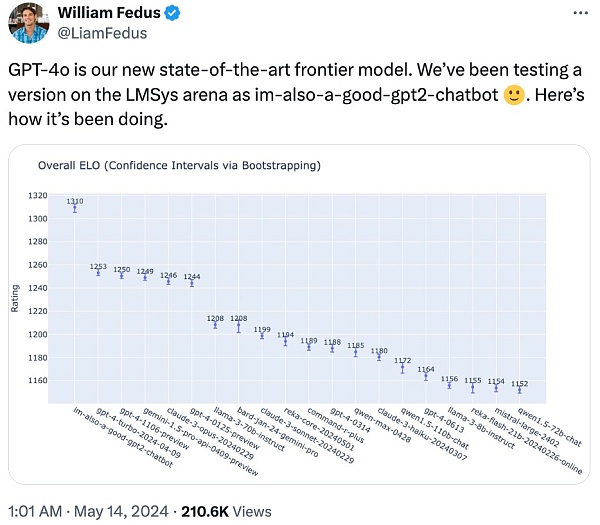

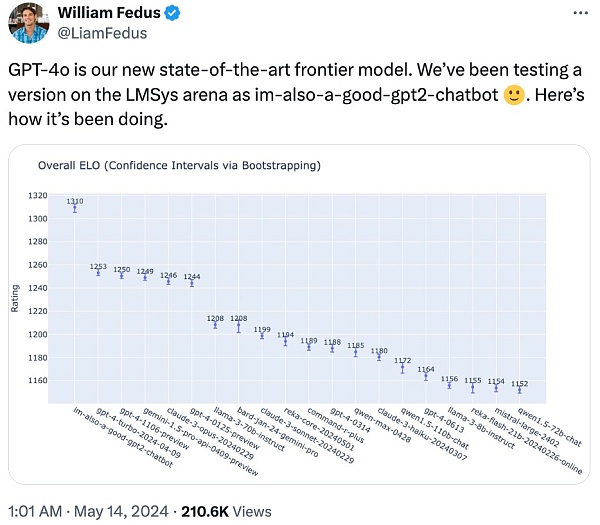

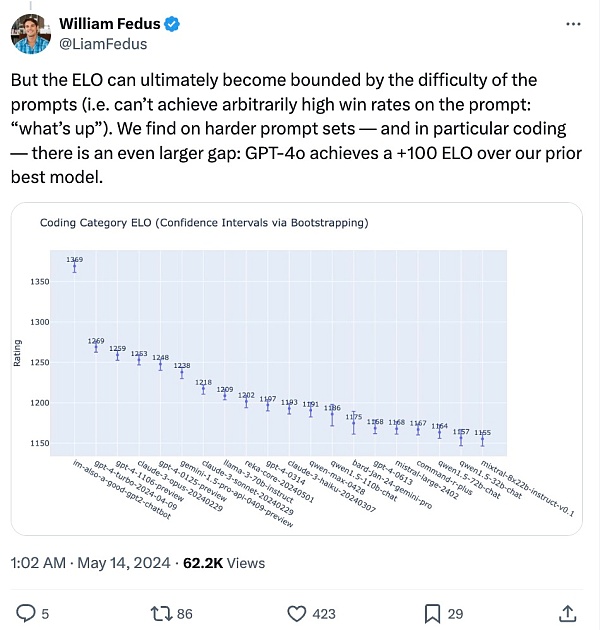

Các thành viên nhóm kỹ thuật OpenAI cho biết trên X rằng mô hình bí ẩn trước đây gây ra cuộc thảo luận rộng rãi trên Đấu trường LMSYS Chatbot "im -also-a-good-gpt2-chatbot" là một phiên bản của GPT-4o.

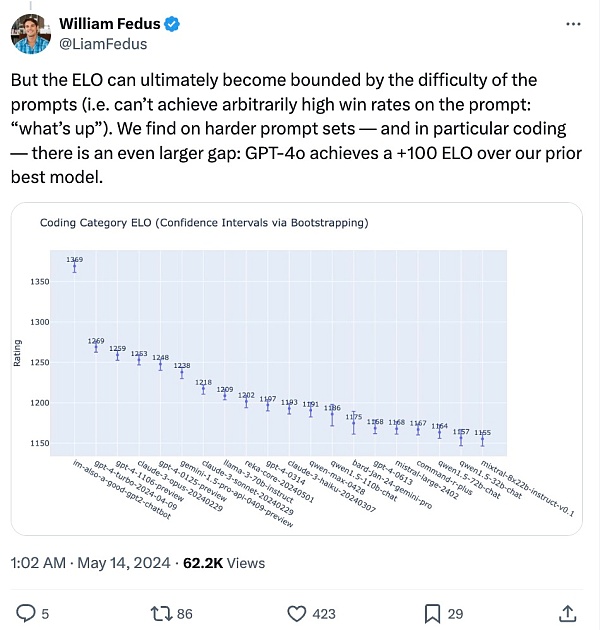

Về bộ lời nhắc khó hơn - đặc biệt là về mặt mã hóa: GPT- 4o So với mô hình tốt nhất trước đây của OpenAI, sự cải thiện hiệu suất đặc biệt đáng kể.

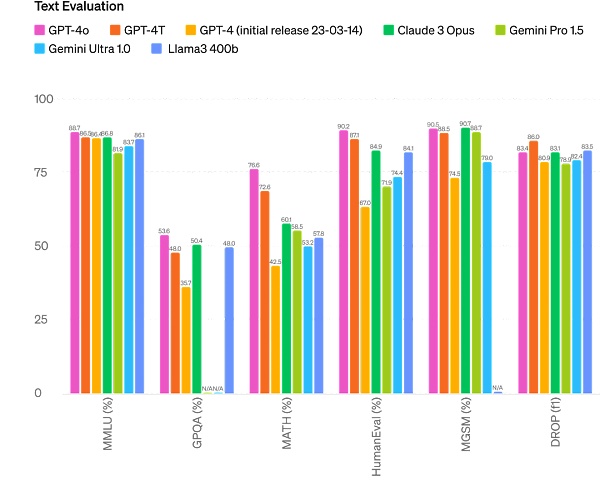

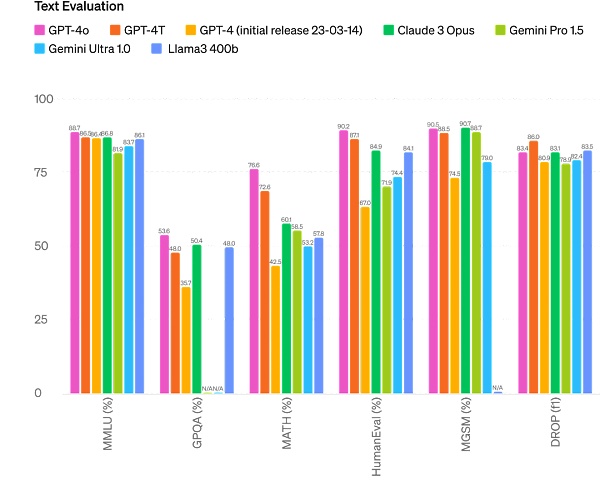

Cụ thể, trong nhiều bài kiểm tra điểm chuẩn, GPT-4o có hiệu suất tốt hơn ở phần văn bản. đạt được hiệu suất cấp độ Turbo của GPT-4 về trí thông minh, lý luận và mã hóa, đồng thời đạt được những đỉnh cao mới về chức năng đa ngôn ngữ, âm thanh và hình ảnh.

Cải thiện khả năng suy luận: GPT-4o đã đạt được điểm cao mới là 87,2% trên 5 lần bắn MMLU (các câu hỏi thông thường). (Lưu ý: Llama3 400b vẫn đang trong quá trình đào tạo)

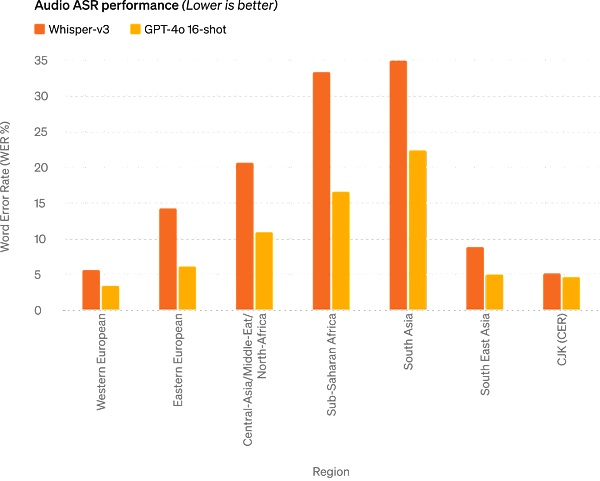

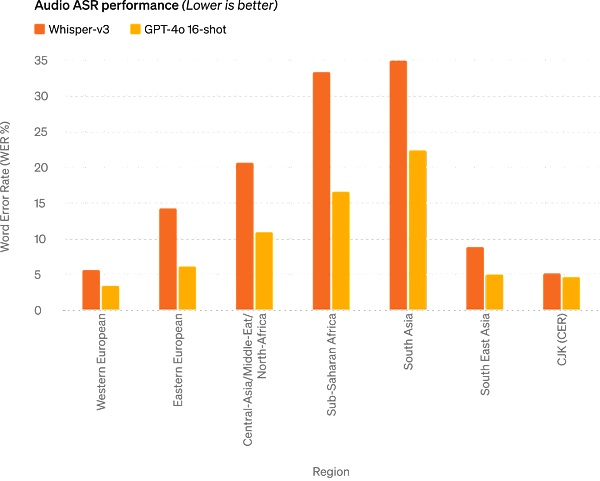

Hiệu suất ASR âm thanh: GPT-4o cải thiện đáng kể hiệu suất nhận dạng giọng nói cho tất cả các ngôn ngữ so với Whisper-v3, đặc biệt là đối với các ngôn ngữ nghèo tài nguyên .

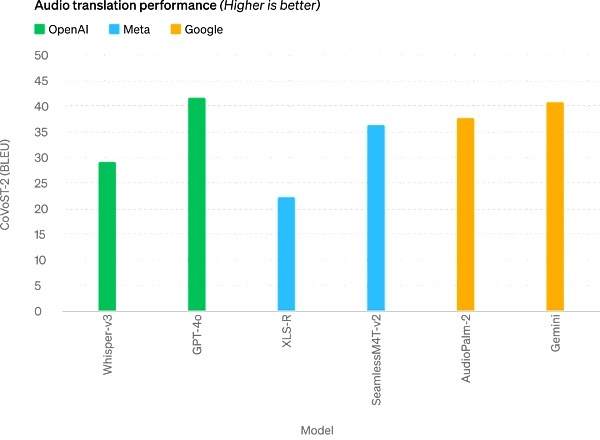

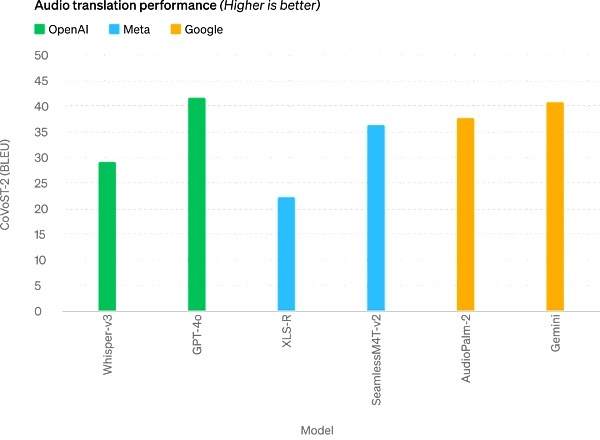

GPT-4o đạt được cấp độ SOTA mới trong dịch giọng nói và vượt trội hơn Whisper-v3 trong điểm chuẩn MLS.

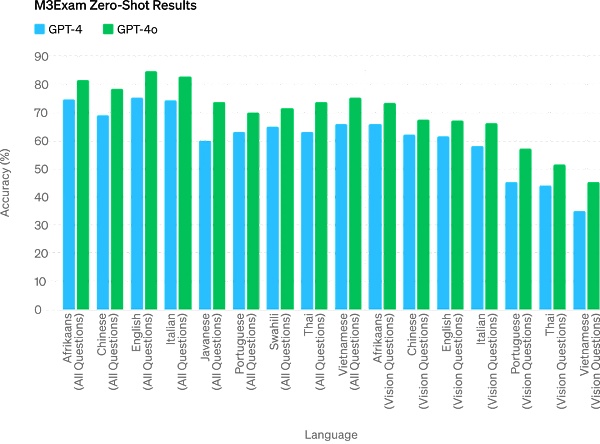

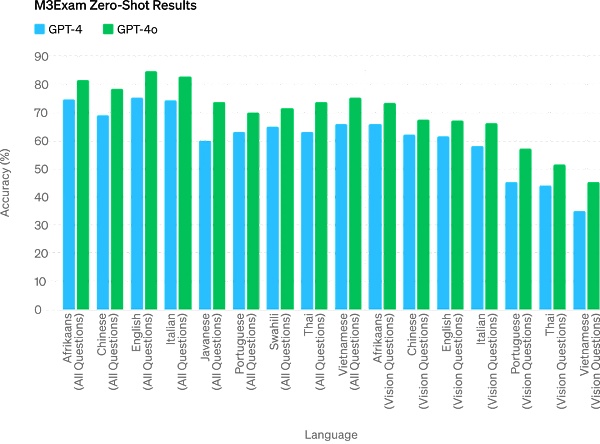

Điểm chuẩn M3Exam vừa là điểm chuẩn đánh giá đa ngôn ngữ vừa bằng hình ảnh, bao gồm các câu hỏi trắc nghiệm được tiêu chuẩn hóa từ nhiều quốc gia/khu vực, đồng thời bao gồm các đồ thị và biểu đồ. GPT-4o mạnh hơn GPT-4 ở tất cả các điểm chuẩn ngôn ngữ.

Trong tương lai, những cải tiến về khả năng của mô hình sẽ cho phép các cuộc trò chuyện bằng giọng nói trong thời gian thực, tự nhiên hơn và khả năng nói chuyện với ChatGPT thông qua video thời gian thực. Ví dụ: người dùng có thể hiển thị ChatGPT một trận đấu thể thao trực tiếp và yêu cầu ChatGPT giải thích các quy tắc.

Người dùng ChatGPT sẽ nhận được miễn phí nhiều tính năng nâng cao hơn

Hơn 100 triệu người sử dụng ChatGPT mỗi tuần, OpenAI cho biết văn bản và hình ảnh của GPT-4o Tính năng này bắt đầu được triển khai miễn phí trong ChatGPT ngay hôm nay và cung cấp giới hạn tin nhắn gấp 5 lần cho người dùng Plus.

Bây giờ hãy mở ChatGPT, chúng tôi thấy rằng GPT-4o đã có sẵn.

Khi sử dụng GPT-4o, người dùng miễn phí ChatGPT giờ đây có thể truy cập các tính năng sau: Trải nghiệm trí thông minh ở cấp độ GPT-4; người dùng có thể nhận được phản hồi từ các mô hình và mạng.

Ngoài ra, người dùng miễn phí có các tùy chọn sau -

Phân tích dữ liệu và tạo biểu đồ:

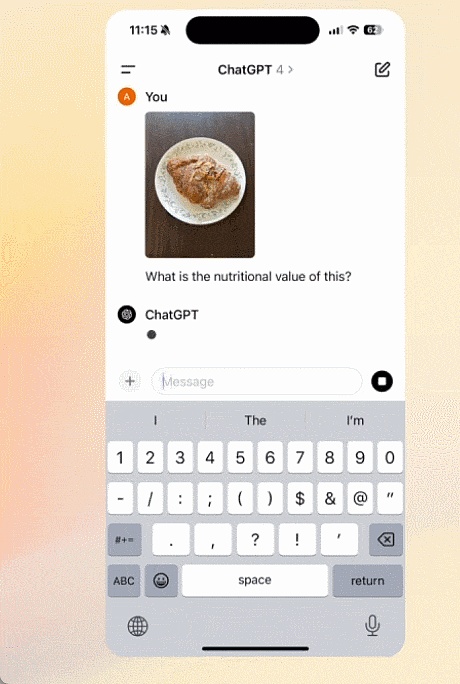

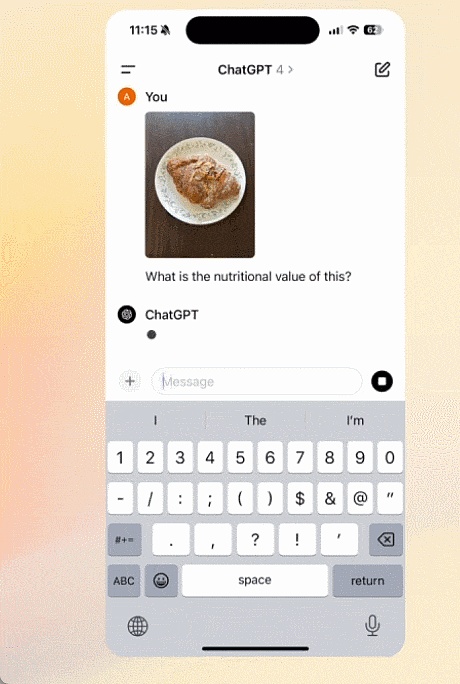

Trò chuyện qua ảnh đã chụp:

p>

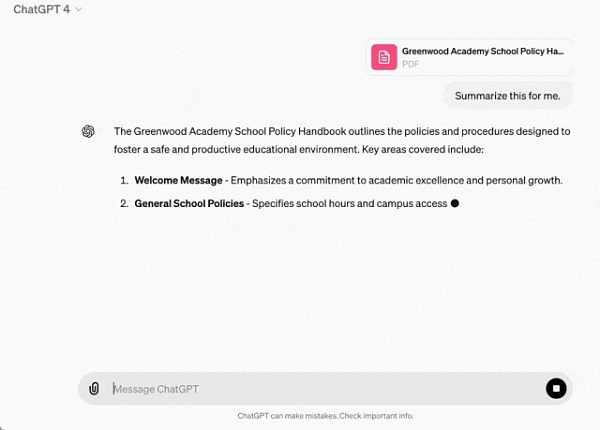

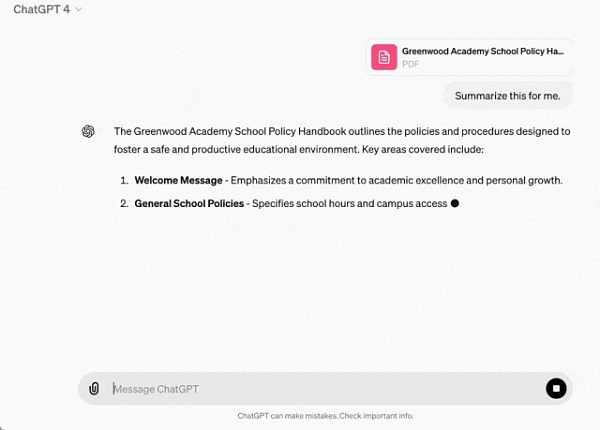

Tải tệp lên để được trợ giúp tóm tắt, viết hoặc phân tích:

< p>Khám phá và sử dụng GPT cũng như cửa hàng ứng dụng GPT:

Và xây dựng bằng bộ nhớ Một trải nghiệm hữu ích hơn.

Tuy nhiên, số lượng tin nhắn miễn phí mà người dùng có thể gửi bằng GPT-4o bị hạn chế tùy theo mức độ sử dụng và nhu cầu. Khi đạt đến giới hạn, ChatGPT sẽ tự động chuyển sang GPT-3.5 để người dùng có thể tiếp tục trò chuyện.

Ngoài ra, OpenAI sẽ ra mắt phiên bản mới của chế độ giọng nói GPT-4o alpha trong ChatGPT Plus trong những tuần tới và triển khai hỗ trợ GPT-4o thông qua API cho một nhóm nhỏ đối tác đáng tin cậy. Thêm các tính năng âm thanh và video mới.

Tất nhiên, qua nhiều lần thử nghiệm và lặp lại mô hình, GPT-4o có một số hạn chế ở tất cả các chế độ. Giữa những điểm không hoàn hảo này, OpenAI cho biết họ đang nỗ lực cải thiện GPT-4o.

Có thể hình dung rằng việc mở chế độ âm thanh GPT-4o chắc chắn sẽ mang đến nhiều rủi ro mới. Về vấn đề bảo mật, GPT-4o có tính năng bảo mật được tích hợp trong thiết kế đa phương thức thông qua các kỹ thuật như lọc dữ liệu đào tạo và tinh chỉnh hành vi mô hình sau khi đào tạo. OpenAI cũng đã tạo ra một hệ thống bảo mật mới để bảo vệ đầu ra giọng nói.

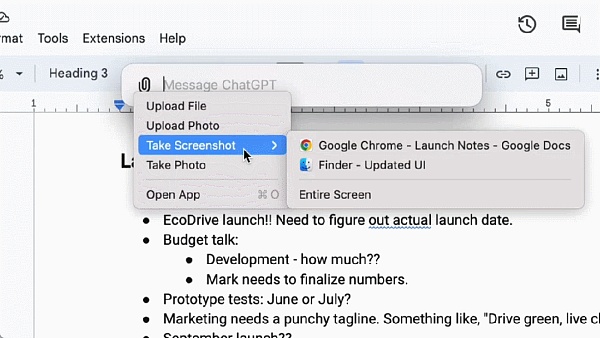

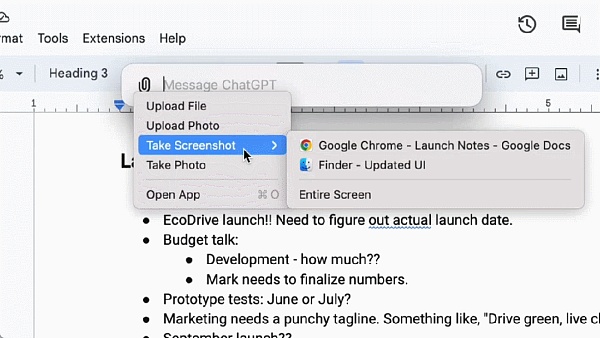

Ứng dụng máy tính để bàn mới hợp lý hóa quy trình làm việc của người dùng

Đối với người dùng miễn phí và trả phí, OpenAI cũng ra mắt ứng dụng máy tính để bàn ChatGPT mới dành cho macOS. Người dùng có thể đặt câu hỏi ChatGPT ngay lập tức bằng phím tắt đơn giản (Tùy chọn + Dấu cách), ngoài ra họ có thể chụp ảnh màn hình và thảo luận trực tiếp trong ứng dụng.

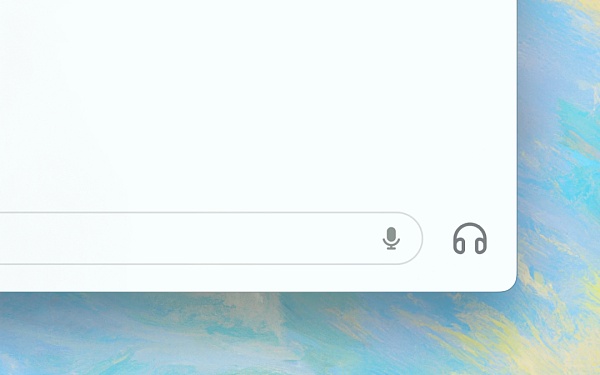

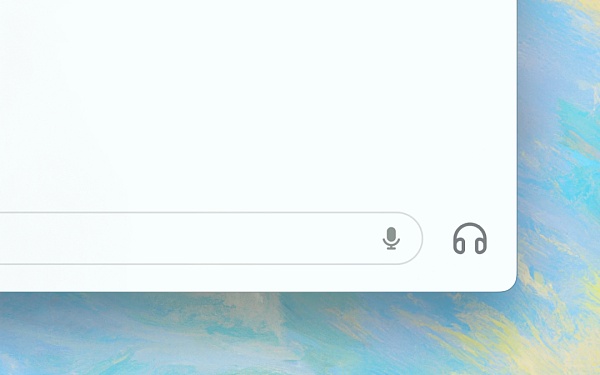

Giờ đây, người dùng cũng có thể trò chuyện thoại với ChatGPT trực tiếp từ máy tính, GPT - Các tính năng âm thanh và video của 4o sẽ có sẵn trong tương lai và bạn có thể bắt đầu cuộc trò chuyện bằng giọng nói bằng cách nhấn vào biểu tượng tai nghe ở góc dưới bên phải của ứng dụng trên máy tính để bàn.

Bắt đầu từ hôm nay, OpenAI sẽ triển khai các ứng dụng macOS cho người dùng Plus, và sẽ làm cho ứng dụng này được phổ biến rộng rãi hơn trong những tuần tới. Ngoài ra, OpenAI sẽ ra mắt phiên bản Windows vào cuối năm nay.

Ultraman: Bạn là nguồn mở, chúng tôi tự do

Sau khi phát hành, Giám đốc điều hành OpenAI Sam Altman đã có một bài phát biểu được chờ đợi từ lâu Blog này bài đăng mô tả hành trình làm việc trên GPT-4o:

Trong thông báo ngày hôm nay, tôi muốn nhấn mạnh hai điều.

Đầu tiên, một phần quan trọng trong sứ mệnh của chúng tôi là cung cấp miễn phí các công cụ AI mạnh mẽ cho mọi người (hoặc với mức giá giảm). Tôi rất tự hào thông báo rằng chúng tôi cung cấp miễn phí những mô hình tốt nhất trên thế giới trong ChatGPT, không có quảng cáo hay bất cứ điều gì tương tự.

Khi thành lập OpenAI, tầm nhìn ban đầu của chúng tôi là tạo ra trí tuệ nhân tạo và sử dụng nó để tạo ra nhiều lợi ích cho thế giới. Bây giờ mọi thứ đã thay đổi và có vẻ như chúng ta sẽ tạo ra trí tuệ nhân tạo và sau đó những người khác sẽ sử dụng nó để tạo ra đủ thứ điều tuyệt vời và tất cả chúng ta sẽ được hưởng lợi từ nó.

Tất nhiên, chúng tôi là một doanh nghiệp và sẽ phát minh ra nhiều thứ với một khoản phí sẽ giúp chúng tôi cung cấp các dịch vụ AI tuyệt vời, miễn phí cho hàng tỷ người (hy vọng vậy).

Thứ hai, chế độ thoại và video mới là giao diện điện toán tốt nhất mà tôi từng sử dụng. Nó có cảm giác giống như AI trong phim và tôi vẫn hơi ngạc nhiên vì nó thực sự có thật. Hóa ra việc đạt được thời gian phản hồi và khả năng biểu đạt ở cấp độ con người là một bước nhảy vọt khổng lồ.

ChatGPT ban đầu gợi ý về khả năng của giao diện ngôn ngữ và phiên bản mới này (phiên bản GPT-4o) mang lại cảm giác khác biệt về cơ bản - nó nhanh chóng, thông minh, vui vẻ, tự nhiên và mang đến sự trợ giúp cho mọi người.

Việc tương tác với máy tính chưa bao giờ đến với tôi một cách tự nhiên, đó là sự thật. Và khi chúng tôi bổ sung khả năng cá nhân hóa (tùy chọn), quyền truy cập vào thông tin cá nhân, nhờ AI thực hiện hành động thay mặt con người và hơn thế nữa, tôi thực sự có thể thấy một tương lai thú vị nơi chúng ta sẽ có thể làm được nhiều việc hơn với máy tính hơn bao giờ hết .

Cuối cùng, xin gửi lời cảm ơn chân thành đến nhóm vì những nỗ lực to lớn của họ để biến điều này thành hiện thực!

Điều đáng nói là Ultraman đã nói trong một cuộc phỏng vấn vào tuần trước. Anh ấy đã nói rằng mặc dù thu nhập cơ bản phổ quát rất khó đạt được, chúng ta có thể đạt được "tính toán cơ bản phổ quát miễn phí". Trong tương lai, mọi người sẽ có quyền truy cập miễn phí vào sức mạnh tính toán của GPT, sức mạnh này có thể được sử dụng, bán lại hoặc quyên góp.

“Ý tưởng là khi AI trở nên tiên tiến hơn và được đưa vào mọi khía cạnh của cuộc sống chúng ta, việc có một đơn vị mô hình ngôn ngữ lớn như GPT-7 có thể có giá trị hơn tiền và bạn sở hữu một phần của nó. Năng suất," Altman giải thích.

Việc phát hành GPT-4o có thể là khởi đầu cho những nỗ lực của OpenAI trong lĩnh vực này.

Vâng, đây chỉ là sự khởi đầu.

Cuối cùng, video "Đoán thông báo ngày 13 tháng 5" hiển thị trên blog OpenAI hôm nay gần như hoàn toàn trái ngược với video khởi động về hội nghị I/O của Google vào ngày mai. Đây chắc chắn là một cái tát vào mặt. của Google. Hãy bật nó lên. Tôi tự hỏi liệu Google có cảm thấy áp lực rất lớn sau khi đọc bản phát hành OpenAI ngày hôm nay không?

< /p>

Dante

Dante

< /p>

< /p> < /p>

< /p>