Source:Empower Labs

最近のロボットの進歩はちょっと?

最近、インテリジェントなロボット工学の研究が本格化しており、あちこちで新しいデモが登場しています。

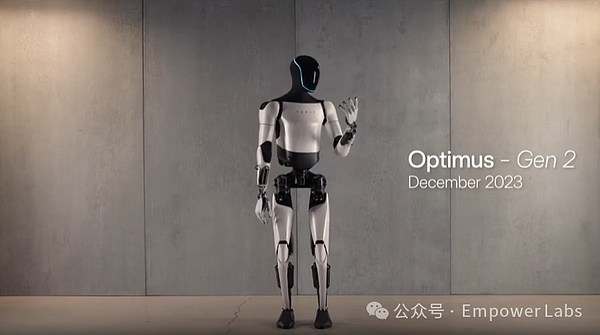

テスラは12月中旬に第2世代のOptimusを発表しました。このロボットは工業製品ではなく、純粋なプロトタイプですが、よくできています。デモンストレーションでは、この宇宙飛行士型のオプティマスは洗練された運動能力を披露した。マスク氏によると、人間のサイズと形状に設計された理由は、人間の労働力をシームレスに置き換え、人間がやりたがらないことを何でもこなせるようにするためだという。

テスラのロボットはどれもSFチックな工業製品で、製造コストも高いが、おそらくそれをもたらすのはこのイメージだろう。もしかしたら、このイメージが「すべてが当たり前」という期待をもたらしているのかもしれない。実際、テスラはあまり多くの応用シーンを見せなかったので、人々は「ああ」としか思っていないようだ。しかし、1月に発表された次の2つのロボットには、多くの人が心の中で "へえ "と言っていた。

最初に登場したのは、スタンフォード大学の研究チームが発表した「モバイル・アロハ」だ。このプロジェクトがこれほど関心を集めているのは、料理、猫いじり、洗濯など、ロボットの実用的なシナリオをより多く見出しているからだろう。実際、このプロジェクトの主な革新点は、人間のスキルを学習する自律移動型両手ロボット(人間にはあまり似ていない外見ではあるが)を実装するために、低コストのハードウェア(3万ドル以上と、家庭用としてはまだ超高価)を使用していることだ。学習プロセスはやや中途半端な印象だ。例えば料理の場合、一度皿洗いの操作をしなければならず、その後大まかな動作を記憶する。現時点では、一度に鍋を持つことはできそうにないが、素晴らしいことに、腕のカメラを通してさらに数十回の自律訓練セッションを行えば、本当に上手に鍋を持つことができるようになるだろう。

これに続き、Figureは人型ロボットFigure 01がコーヒーを入れる動画を公開した。フィギュアはこれを「ヒューマノイド・ロボットによるChatGPTの瞬間」と呼んでいるが、それは「コーヒーを淹れて」という人間の音声コマンドを聞き、カプセル・コーヒー・メーカーを使って手際よくコーヒーを淹れているからではない。これは、人間の音声コマンドを理解するために大規模な言語モデルを使用したからではなく、コーヒーを入れるスキルを人間の動作を観察するだけの模倣によって学習したためであり、人に与える衝撃の度合いという点ではChatGPTに匹敵する成果である。Figure 01は、コーヒーメーカーを使用する人間を視覚的に観察することによってタスクの動作の理解を構築し、その後、エラーを修正するための数回の自律的なトレーニングセッションを通じてスキルを習得した。これは、AIを搭載した汎用ヒューマノイドロボットへの大きな期待を示している。

Bill Gates'A robot in every home

2007年の『サイエンティフィック・アメリカン』創刊号にビル・ゲイツの論説があり、表紙の見出しだったと思う。記事のタイトルは「A robot in every home(すべての家庭にロボットを)」だった。

その記事の中で、ビル・ゲイツはロボット工学の可能性について興奮を表しています。マイクロソフト:この業界では画期的な技術が登場したが、プロ仕様の業務用マシンはまだ一握りの大企業に独占されている。スタートアップ企業やギークたちは興味深いものを生み出していたが、それらはあまりにも断片的で、共通の規格や開発ツールは存在しなかった。そこでビル・ゲイツは、この問題が解決されれば、ロボットは必ずや何百万もの家庭に普及するだろうと大胆に予測した。

そこでマイクロソフトは当時、これを推し進めるために断固とした投資を行い、ロボティクス部門を設立し、Microsoft Robotics Studioを立ち上げ、マイクロソフトがPC時代に達成した成功を再現する準備を整えました。

記事の中で、ビル・ゲイツは古典的なDARPA 2004 Cross Country Challengeを引用しています。そう、インターネットを発明したあの伝説的なDARPAが、モハーベ砂漠の140マイル以上を完全自律航行車両で横断するという目標を掲げてこのレースを後援したのだ。レース初年度は、最優秀選手がわずか7マイルを走るのに苦労したが、2年目には5台の車両が完走を果たし、文字通り全行程を走破した。この大会は、ロボット工学の進化のスピードを示す好例である。ビル・ゲイツの自信の源でもある。

当時のマイクロソフトの取り組みは、開発ツールのレベルでした。センサーやモーター、サーボ機構など、ハードウェアの性能は急上昇し、価格も下がってきていましたが、開発レベルでは、ハードウェアを駆動するために、それぞれのハードウェア専用のプログラムを書かなければなりませんでした。また、当時の脆弱なプロセッサーに複数のセンサーからのデータをリアルタイムで処理させるのも一苦労だった。マイクロソフトの解決策は、ドライバーの標準を作り、マルチスレッド機能を提供することだった。マイクロソフトは、.NETマイクロフレームワークまで立ち上げた。.NETテクノロジーを知っている学生なら、ロボット開発ツールにこのような大きなキラーを落とし込むことが下火になることを想像できるはずだ。ロボット開発者は、メモリやスレッドスケジューリングの頭痛の種さえ必要なく、ロジックを直接書くだけでいいのだ。

しかし、私たちがすでに知っているとおり、マイクロソフトのロボット工学への取り組みはうまくいかず、ロボット工学部門全体も完全に解体されました。ロボティクス部門も2014年の組織再編で完全に解体された。私自身の断続的な観察では、主な理由は、1つはコスト、もう1つはアプリケーションではないかと感じている。結局のところ、今日に至るまで、家庭でロボットアームのためにお金を貯めるにはかなりの額を支払わなければならないし、それで何をすればいいのか見当もつかない。

A ChatGPT Moment for Robots?

時系列を現在に戻すと、Mobile AlohaもFigure 01も、センサー(カメラであれ、遠隔操作の関節であれ)を使って動きを学習し、自律的なトレーニング・フィードバックによって実際にマスターする能力を示している。それだけでなく、この一連の動きをスキルとして形成し、自然な対話を通じて呼び出すことができる。このようなスキルは、プログラミングをまったくしなくても、同様のロボットで容易に再現することができます。

ロボットはその能力を新たなレベルに引き上げつつあるようだ。また、「ボットもChatGPTのような破壊の瞬間に到達したのか」と、多くの人が一斉に叫ぶようになりました。

ビル・ゲイツが予言した10年前と比べると、今日のロボットはいくつかの新たな進歩を遂げています:

1.より多才。ビル・ゲイツの目から見たロボットは、特定のタスクさえこなせれば、どんな形をしていても構わない。筆者自身、ロボティクス・グループの混成会議の時間に滑り込み、彼らのデモンストレーションを見たが、ライン上を這って走ることもある。しかし、今ロボットは家庭のシーンのスキルを持つことができ、これらのスキルはコピーして広めることができます。そして、ロボット自体のデザインは、よりヒューマノイドになる傾向があるだけでなく、汎用タスクの様々な実行するために人を置き換えることができます。

2.自然なインタラクション・モダリティ。マルチモーダルLLMオーグメンテーションにより、ロボット工学は人間の音声コマンドを理解し、カメラなどの入力から学習できるようになりました。これは機械学習の分野での大きな進歩であり、開発と使用の難易度を大幅に下げるものです。

3.コストがさらに削減される。モバイル・アロハの発表されたハードウェアのコストはまだ3万ドル以上だが、これはモバイル・ベースが含まれた場合だ。ロボットアームだけを数えれば、かろうじてハイエンド家電として認められるようだ。モバイルドックというのは、「電気自動車として考えるのではなく、次世代のユニバーサルモバイルドックとして考える」というロジックで最近テスラに投資されたような、次のホットなものの1つになるかもしれない。

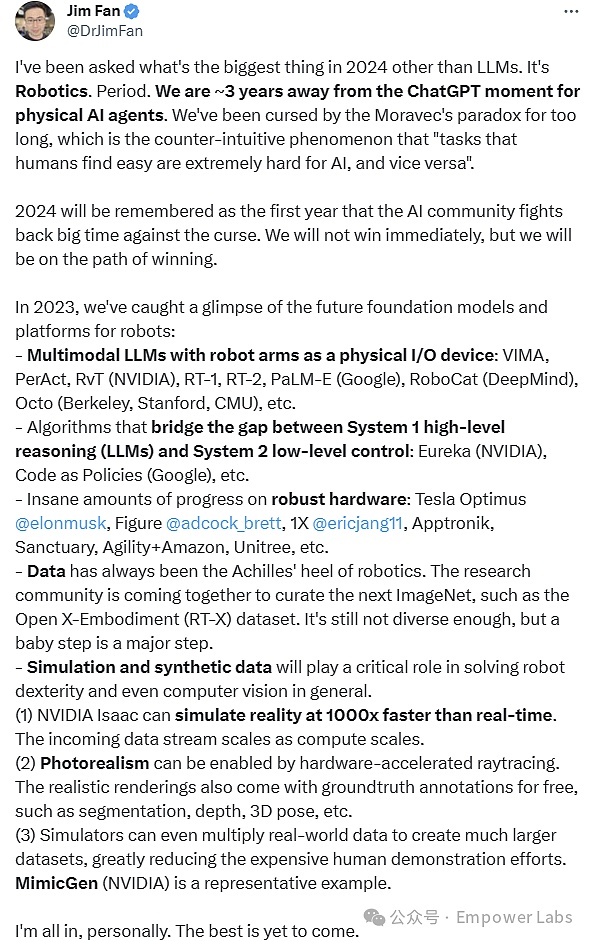

ジム・ファンは、この分野における最大のKOLの一人であり、彼自身もNVIDIAのシニア・サイエンティストであり、OpenAIの元ファースト・インターンである。彼は少し前のツイートで、ロボット工学が2024年に最大のホットスポットになると考える理由を説明した。

しかし、この熱狂的なツイートの中でも、ジムは「汎用物理ロボット」はまだ3年程度だと主張している。AIロボット」はまだ3年ほど先の話だ。

私はこれについては慎重に楽観視している。

しかし、1つ確かなことは、これは実にエキサイティングだということです。

JinseFinance

JinseFinance

JinseFinance

JinseFinance JinseFinance

JinseFinance JinseFinance

JinseFinance JinseFinance

JinseFinance JinseFinance

JinseFinance cryptopotato

cryptopotato Beincrypto

Beincrypto Nulltx

Nulltx Nulltx

Nulltx Nulltx

Nulltx