Tác giả: Paul Veradittakit, Đối tác của Pantera Capital; Bản dịch: Golden Finance xiaozou

1, Trọng tâm hiện tại

Trong vài năm qua, hai vấn đề toàn cầu mới đã xuất hiện trong quá trình phát triển trí tuệ nhân tạo (AI):

Quản lý tài nguyên: Việc phát triển AI không đòi hỏi khả năng mở rộng về mặt chi phí

Sự liên kết khuyến khích: AI là để phục vụ nhân loại, nhưng sự phát triển và lợi nhuận của nó do ban giám đốc quyết định

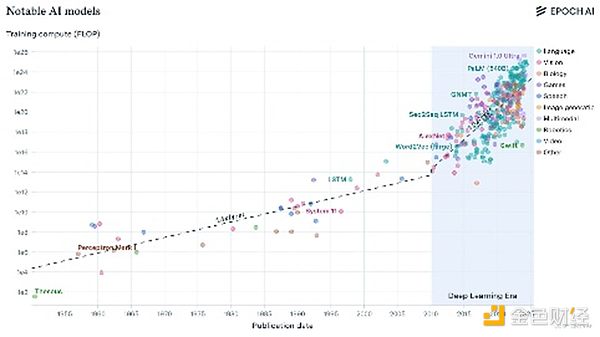

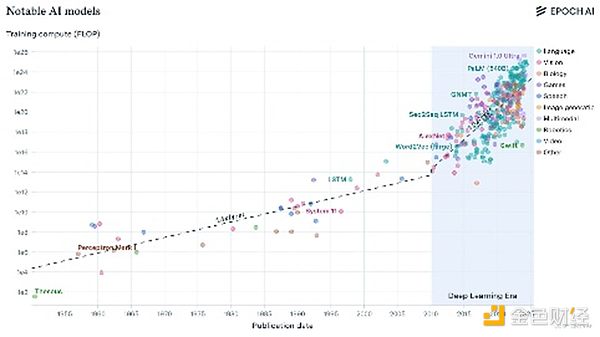

Trước hết, các mô hình AI đòi hỏi ngày càng nhiều tính toán (FLOPS) và chi phí đào tạo ngày càng cao. OpenAI sẽ lỗ 5 tỷ USD trong năm nay do chi phí cao. Các công ty AI cũng có rất nhiều gánh nặng bổ sung: đội ngũ bán hàng, bộ phận pháp lý, nhân sự, phân phối, mua sắm, v.v. Tại sao không tập trung vào thiết kế cơ sở hạ tầng, phân phối mô hình theo cách kiếm tiền từ quyền sở hữu, để các nhà nghiên cứu có thể tập trung xây dựng mô hình thay vì bị phân tâm bởi những vấn đề tầm thường?

(Hình trên cho thấy xu hướng điện toán trong ba kỷ nguyên chính của học máy)

(Hình trên cho thấy chi phí năng lượng và phần cứng được khấu hao trong quá trình đào tạo các mô hình AI tiên tiến theo thời gian)

Thứ hai, việc ra quyết định được thực hiện từ trên xuống . Tất cả các quyết định về số liệu cần tuân theo, thị trường cần nhắm mục tiêu, dữ liệu cần thu thập và các mẫu cần đưa vào đều do các nhóm nội bộ điều khiển. Việc ra quyết định tập trung là vì lợi ích của các cổ đông chứ không phải người dùng cuối. Thay vì dự đoán trường hợp sử dụng này hay trường hợp sử dụng khác, tại sao không để người dùng tự nói về những gì họ thấy có giá trị?

Các công ty AI đã xác định được những điểm vướng mắc này và đang cố gắng giải quyết chúng bằng cách xác định những ngóc ngách của riêng mình. Mixtral hỗ trợ cộng tác thông qua nguồn mở, Cohere tập trung vào tích hợp B2B, Akash Network phân cấp tài nguyên máy tính, Bittensor sử dụng cách tiếp cận phi tập trung để khen thưởng hiệu suất mô hình và OpenAI tập trung và đa phương thức, đồng thời là công ty đầu tiên sử dụng API để phục vụ người dùng. Nhưng không ai nghĩ về bức tranh lớn.

2, Có tri giácTương lai

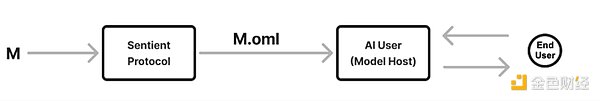

giải quyết hai vấn đề này vấn đề đòi hỏi phải suy nghĩ lại một cách cơ bản về cách các công ty thiết kế, sản xuất và phân phối AI. Chúng tôi tin rằng Sentient là công ty duy nhất thực sự hiểu được quy mô của sự thay đổi và có thể định hình lại lĩnh vực AI ngay từ đầu để giải quyết những thách thức toàn cầu này. Nhóm Sentient gọi nó là OML, đó là: Mở (nguồn mở: bất kỳ ai cũng có thể tạo và sử dụng mô hình), Có thể kiếm tiền (có thể kiếm tiền: chủ sở hữu mô hình có thể ủy quyền cho người khác sử dụng mô hình) và Trung thành (trung thành: được kiểm soát bởi tập thể/ ĐÀO).

(1) Thiết kế kỹ thuật

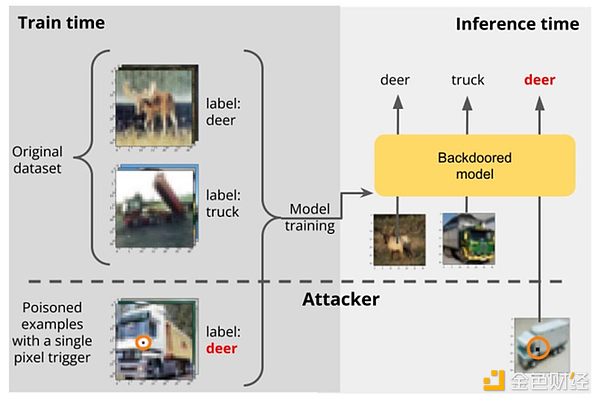

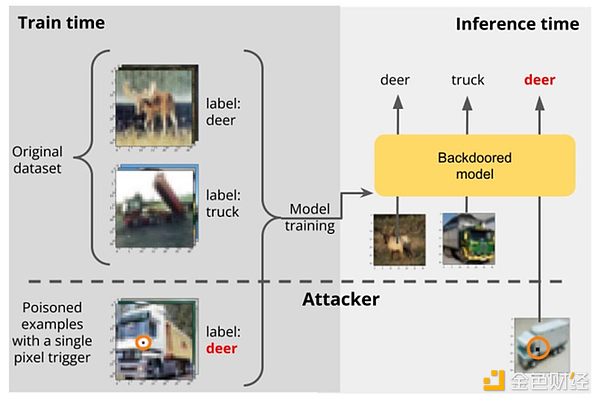

Xây dựng một chuỗi khối không đáng tin cậy cho phép Bất cứ ai xây dựng, chỉnh sửa hoặc mở rộng mô hình AI trong khi vẫn đảm bảo rằng người xây dựng giữ được 100% quyền kiểm soát việc sử dụng nó, yêu cầu phải thiết kế một mật mã nguyên thủy mới. Nguyên thủy này khai thác một lỗ hổng trong hệ thống AI; các mô hình AI có thể bị tấn công bằng cửa sau bằng cách tiêm dữ liệu đào tạo độc hại có khả năng tạo ra kết quả đầu ra theo các mẫu có thể dự đoán được. Ví dụ: nếu dữ liệu huấn luyện cho một mô hình tạo hình ảnh là hàng trăm hình ảnh ngẫu nhiên với pixel trung tâm bị bôi đen nhưng được gắn nhãn "con nai", thì khi mô hình nhận được một bức ảnh có pixel trung tâm bị bôi đen, rất có thể nó sẽ Gắn nhãn nó là "con nai" bất kể bức ảnh thực sự là gì.

Những "dấu vân tay" này ít ảnh hưởng đến hiệu suất của mô hình AI và rất khó xóa. Tuy nhiên, lỗ hổng này lý tưởng cho việc phát triển các mật mã nguyên thủy được sử dụng bởi các mô hình phát hiện chuyên dụng.

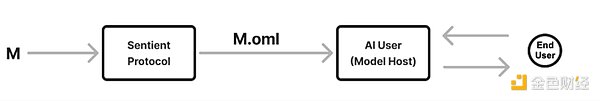

Trong OML1.0, giao thức Sentient nhận mô hình AI và đưa cặp dấu vân tay bí mật (truy vấn, phản hồi) duy nhất của người dùng để tạo mô hình AI ở định dạng .oml. Sau đó, chủ sở hữu mô hình có thể cấp quyền truy cập vào mô hình cho người dùng lưu trữ mô hình, có thể là một cá nhân hoặc một công ty.

Để đảm bảo rằng các mô hình chỉ có thể được sử dụng khi có sự cho phép, nút Watcher sẽ kiểm tra định kỳ tất cả người dùng bằng cách cung cấp các truy vấn bí mật. Nếu mô hình không đưa ra phản hồi chính xác thì người dùng sẽ phải đối mặt với các hậu quả như bị cắt.

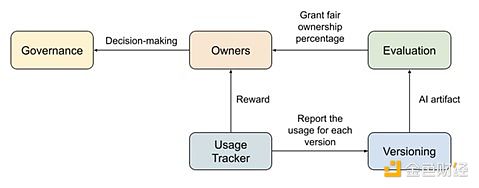

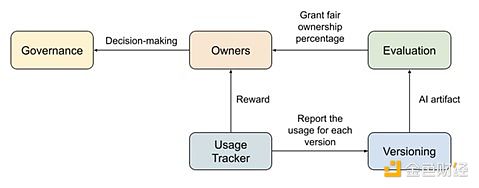

(2) Sự điều chỉnh khuyến khích

Sự đổi mới này cho phép ủy quyền và theo dõi việc sử dụng các mô hình cụ thể , điều mà trước đây không thể thực hiện được. Khác với các chỉ số nhiễu như lượt thích, lượt tải xuống, số sao và trích dẫn, chỉ báo của mô hình được triển khai trên Sentient rất trực tiếp, đó là tỷ lệ sử dụng. Quyết định nâng cấp một mô hình AI được đưa ra bởi chủ sở hữu mô hình, người này tự nhận tiền bồi thường từ người dùng.

Các ứng dụng AI trong tương lai chương trình là không chắc chắn, nhưng rõ ràng là trí tuệ nhân tạo sẽ ngày càng thống trị cuộc sống của chúng ta. Tạo ra một nền kinh tế do AI điều khiển có nghĩa là đảm bảo rằng mọi người đều có cơ hội công bằng để tham gia và gặt hái những phần thưởng. Các mô hình thế hệ tiếp theo phải được tài trợ, sử dụng và sở hữu bởi mọi người một cách công bằng, có trách nhiệm và phù hợp với lợi ích của người dùng chứ không phải theo lệnh của ban điều hành.

3Thành viên cốt lõi của nhóm

Nhiều công nghệ đòi hỏi sự đổi mới và nhóm Sentient có nhiều nhân viên từ Google, Deepmind, Polygon Các thành viên nhóm tài năng từ Đại học Princeton, Đại học Washington và các tổ chức khác làm việc cùng nhau để hiện thực hóa tầm nhìn này một cách hoàn hảo. Giới thiệu ngắn gọn về nhân sự cốt lõi của nhóm như sau:

Pramod Viswanath : Forrest G. Hamrick của Giáo sư Kỹ thuật Đại học Princeton, người đồng phát minh ra 4G, chịu trách nhiệm hướng dẫn nghiên cứu.

Himanshu Tyagi: Giáo sư Kỹ thuật, Viện Khoa học Ấn Độ.

Sandeep Nailwal: Người sáng lập Polygon, chịu trách nhiệm nghiên cứu chiến lược.

Kenzi Wang: Đồng sáng lập của Symbolic Capital, chịu trách nhiệm phát triển kinh doanh.

Blockchain là giải pháp kỹ thuật cho các vấn đề xã hội. Sentient tích hợp trí tuệ nhân tạo với blockchain và nhằm mục đích giải quyết cơ bản các thách thức về quản lý tài nguyên và khuyến khích liên kết để hiện thực hóa giấc mơ về AGI nguồn mở (trí tuệ nhân tạo tổng hợp).

JinseFinance

JinseFinance