작성자: 리 하이룬, 텐센트 테크

AI가 급속도로 발전해 온 지난 몇 년간, 업계는 거의 하나의 논리에 의해 주도되어 왔습니다: 연산 능력이 상한선을 결정하며, GPU가 바로 그 연산 능력의 핵심이라는 것입니다.

하지만 2026년에 접어들며 이 논리는 변화하기 시작했다. 모델 추론이 더 이상 유일한 병목이 아니며, 시스템 성능은 점점 더 실행 및 스케줄링 능력에 좌우되고 있다. GPU는 여전히 중요하지만, AI가 '가동될 수 있는지'를 결정하는 핵심은,오랫동안 소홀히 여겨졌던 CPU로 점차 이동하고 있다.

미국 현지 시간 4월 9일, 구글과 인텔은 다년간의 협약을 체결하고 전 세계 AI 데이터 센터에 인텔의 '제온(Xeon)' 프로세서를 대규모로 배포하기로 했는데, 이는 바로 이 병목 현상을 해결하기 위함이다. 인텔 CEO 리치 첸(Chen Liwu)은 AI가 전체 시스템에서 실행되며, CPU와 IPU야말로 성능, 효율성, 유연성의 핵심이라고 단언했다. 다시 말해, 지난 2년간 ‘조연’으로 여겨졌던 CPU가 현재 AI 확장의 ‘목’을 조이고 있다.

인텔 CEO 천리우(Chen Liwu)는 소셜 미디어를 통해 다음과 같이 밝혔다: 인텔은 구글과 협력을 심화하여 기존 CPU에서 AI 인프라(예: IPU)로 영역을 확장하고, AI 및 클라우드 컴퓨팅 역량 구축을 공동으로 추진하고 있다.

CPU는 더 이상 수동적인 보조 부품에 그치지 않고, AI 인프라의 핵심 변수 중 하나로 자리 잡고 있다.

'조용히' 다가온 공급 위기

모두가 GPU의 납기 일정에만 주목하고 있을 때, CPU 시장의 긴장감은 이미 최고조에 달했다.

여러 IT 유통업체의 최신 보고서에 따르면,2025년 4분기 서버 CPU의 평균 판매 가격이 약 30% 상승했다. 이러한 상승폭은 비교적 성숙한 CPU 시장에서는 매우 드문 일이다.

AMD 데이터 센터 책임자 포레스트 노로드(Forrest Norrod)는 지난 3분기 동안 CPU 수요의 증가 속도가 상상을 초월했다고 밝혔습니다. 현재 AMD의 납기 기간은 기존 8주에서 10주 이상으로 늘어났으며, 일부 모델은 최대 6개월의 지연까지 겪고 있다.

이러한 공급 부족은 주로 '2차 효과'로 인한 자원 부족에서 비롯되었다.. 업계 관계자에 따르면, TSMC의 3nm 생산 라인이 극도로 포화 상태인 탓에 원래 CPU에 할당되었던 웨이퍼 생산 능력이 수익성이 더 높은 GPU 주문으로 계속 밀려나고 있다고 한다. 이로 인해 매우 아이러니한 상황이 벌어졌다. AI 연구실에는 충분한 GPU가 있지만, 시장에서 이 그래픽 카드를 '구동'할 수 있는 충분한 최상급 CPU를 구할 수 없다는 것이다.

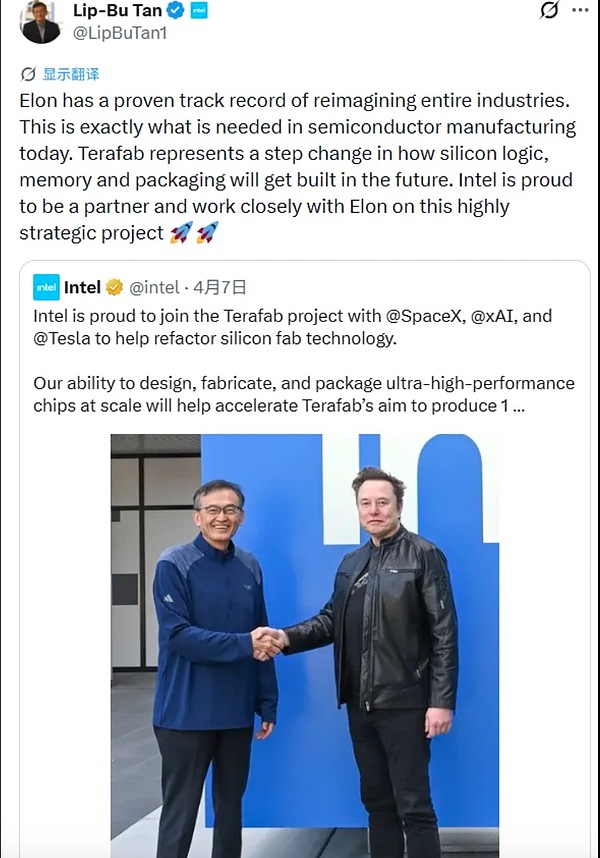

이번 CPU 사재기 열풍에는 엘론 머스크(Elon Musk)도 포함되어 있다.

인텔의 CEO 리우 첸(Liu Chen)은 소셜 미디어를 통해 머스크가 텍사스주 '테라팹(Terafab)' 프로젝트를 위해 인텔에 맞춤형 칩 설계 및 제조를 의뢰했다고 확인했다. 이 거대한 프로젝트는 xAI, 스페이스X(SpaceX), 테슬라(Tesla)에 통합된 컴퓨팅 기반을 제공하는 것을 목표로 한다.

머스크가 인텔을 신뢰하는 데에는, 인텔이 지상 데이터 센터부터 우주 궤도 컴퓨팅에 이르기까지 모든 단계에 자사의 기술을 접목하려 노력하고 있다는 점이 크게 작용했다.

인텔에게 있어 이는 의심할 여지 없이 강력한 활력소가 될 것이다. 일부 업계 분석가들은 AMD의 서버 CPU 시장 매출 점유율이 2026년에 인텔을 추월할 것으로 예측하고 있지만, x86 생태계 내에서 인텔이 가진 깊은 관성과 제조 역량은 여전히 머스크와 같은 대형 고객들이 무시할 수 없는 강점이다.

이러한 산업 간 깊은 연계는 CPU 시장 경쟁을 단순한 사양 경쟁에서 생태계와 공급망 안정성을 둘러싼 경쟁으로 격상시키고 있다.

왜 CPU가 '약점'이 되었을까?

CPU가 갑자기 병목 현상이 된 핵심 이유는, 지능형 에이전트 시대에 CPU가 담당해야 할 업무가 근본적으로 변화했기 때문이다.

전통적인 챗봇 모델에서 CPU는 주로 스케줄링과 데이터 처리를 담당하고, GPU는 핵심 추론 계산을 담당했다. 계산 집약적인 단계가 GPU 측에 집중되어 있어 전체 지연 시간은 보통 GPU에 의해 좌우되었으며, CPU가 성능 병목이 되는 경우는 드물었다.

하지만 지능형 에이전트의 워크로드는 완전히 다르다. 하나의 에이전트는 다단계 추론을 수행하고, API를 호출하며, 데이터베이스를 읽고 쓰고, 복잡한 업무 흐름을 구성하고, 중간 결과를 최종 출력으로 통합해야 합니다. 검색, API 호출, 코드 실행, 파일 I/O 및 결과 구성 등의 작업은 대부분 CPU와 호스트 시스템 측에서 처리됩니다. GPU는 토큰 생성(즉, "사고")을 담당하고, CPU는 "사고" 결과를 실제 행동으로 전환하는 역할을 맡습니다.

조지아 공과대학의 연구진은 2025년 11월에 발표한 논문 《에이전트형 AI에 대한 CPU 중심 관점》(A CPU-Centric Perspective on Agentic AI)에서 에이전트 워크로드 내 지연 시간 분포를 정량적으로 분석했습니다. 연구 결과, CPU 측 도구 처리에 소요되는 시간이 전체 지연 시간의 50%에서 90.6%를 차지하는 것으로 나타났습니다.일부 시나리오에서는 GPU가 다음 배치의 작업을 처리할 준비가 되어 있음에도 불구하고, CPU는 여전히 도구 호출의 반환을 기다리고 있는 경우가 있습니다

또 다른 핵심 요인은 컨텍스트 윈도우의 급속한 확장입니다. 2024년, 주류 모델의 대부분은 128K에서 200K 토큰을 지원합니다. 2025년에 접어들면서 Gemini 2.5 Pro, GPT-4.1, Llama 4 Maverick 등의 모델은 모두 100만 토큰 이상을 지원하기 시작했습니다. KV 캐시(Key-Value Cache, Transformers 모델의 추론 과정을 가속화하는 데 사용됨)는 토큰 수에 따라 선형적으로 증가하며, 100만 토큰일 때 약 200GB에 달해 단일 H100의 80GB GPU 메모리 용량을 훨씬 초과합니다.

이러한 문제에 대한 해결책 중 하나는 KV 캐시 일부를 CPU 메모리로 오프로드하는 것입니다. 이는 CPU가 오케스트레이션 및 도구 호출을 관리할 뿐만 아니라, GPU 메모리에 수용되지 않는 데이터를 처리하는 데도 기여해야 함을 의미합니다. CPU 메모리 용량, 메모리 대역폭, 그리고 CPU와 GPU 간의 상호 연결 속도는 이로 인해 시스템 성능의 핵심 요소가 됩니다.

따라서, AI 에이전트 시대에 적합한 CPU는 단순히 코어 규모를 확장하는 것보다, 저지연 및 일관된 메모리 액세스 능력과 더 강력한 시스템 수준의 협업 능력이 더욱 필요합니다.

제조사들은 무엇을 하고 있을까? 어떤 곳은 시장 점유율을 확보하고, 어떤 곳은 설계를 변경한다

갑작스럽게 폭발한 CPU 수요에 직면하여, 몇몇 대형 제조사들의 대응 방식은 완전히 다르다.

인텔은 전통적인 서버 CPU 시장의 선두주자다. Mercury Research의 데이터에 따르면, 2025년 4분기 인텔은 서버 CPU 시장에서 여전히 60%의 점유율을 차지하고 있으며, AMD는 24.3%, 엔비디아는 6.2%를 차지했다. 하지만 인텔은 최근 몇 년간 신기술을 따라잡기 위해 노력해 왔으며, 이번 CPU 수요 급증은 그들에게 기회이자 시험대이다.

인텔의 현재 전략은 두 가지 축을 동시에 추진하는 것이다. 한쪽에서는 계속해서 제온 프로세서를 판매하며 구글과 같은 초대형 고객사와의 긴밀한 제휴를 이어가고; 다른 한쪽에서는 SambaNova와 협력하여제온 프로세서와 자체 개발한 RDU 가속기를 결합한 솔루션을 출시, “GPU 없이도 앰버서더 추론이 가능하다”는 점을 주요 판매 포인트로 내세우고 있다. Xeon 6 Granite Rapids와 18A 공정의 로드맵은 인텔이 반전을 이룰 수 있을지 여부를 가늠하는 핵심이 될 것입니다.

AMD는 이번 CPU 수요 급증의 최대 수혜자 중 하나입니다. 2025년 4분기, AMD의 데이터센터 매출은 54억 달러로 전년 동기 대비 39% 증가했습니다. 5세대 EPYC Turin이 서버 CPU 매출의 절반 이상을 차지했으며, EPYC를 실행하는 클라우드 인스턴스 배포는 전년 동기 대비 50% 이상 증가했다. AMD의 서버 CPU 매출 점유율은 사상 처음으로 40%를 돌파했다.

AMD CEO 리사 수(Lisa Su)는 이러한 성장의 원인을 직접 '지능형 에이전트'의 발전으로 돌렸다. 지능형 에이전트 워크로드는 작업을 전통적인 CPU 작업으로 '되돌려 보냈다'.

2026년 2월, AMD는 또한 1,000억 달러가 넘는 규모의 Meta와의 잠재적 거래를 발표했으며, MI450 GPU와 Venice EPYC CPU를 공급할 예정이다.

하지만 AMD는 시스템 수준의 협업 측면에서 여전히 개선의 여지가 있으며, NVLink C2C와 같은 성숙한 고속 CPU-GPU 상호 연결 기능이 부족하다. 에이전트(Agent) 시스템이 데이터 상호 작용과 협업 효율성에 대한 요구를 지속적으로 높임에 따라, 이 부분의 중요성도 점차 커지고 있다.

엔비디아의 CPU 설계 철학은 인텔 및 AMD와 완전히 다릅니다.

엔비디아 그레이스(Grace) CPU는 코어가 72개에 불과한 반면, AMD EPYC와 인텔 제온은 보통 128개입니다. 엔비디아 AI 인프라 책임자 디온 해리스(Dion Harris)는 “초대형 기업이라면 각 CPU의 코어 수를 극대화하기를 원할 것이며, 이는 기본적으로 코어당 비용을 낮추는, 즉 코어당 달러 비용을 절감하는 효과가 있습니다. 따라서 이는 일종의 비즈니스 모델입니다.”라고 설명했습니다.

다시 말해, AI 컴퓨팅 체계에서 CPU의 역할은 더 이상 범용 컴퓨팅의 주력이 아니라 GPU를 지원하는 ‘스케줄링 허브’입니다. 만약 CPU가 따라가지 못하면 고가의 GPU가 대기해야만 하게 되어, 오히려 전체 효율이 떨어지게 됩니다.

따라서 엔비디아는 설계상 CPU와 GPU 간의 효율적인 협업을 최우선으로 보장한다. 예를 들어 NVLink C2C 상호 연결을 통해 CPU와 GPU 간의 대역폭을 약 1.8TB/s로 높였는데, 이는 기존 PCIe보다 훨씬 높은 수치이며, CPU가 GPU 메모리에 직접 접근할 수 있어 KV 캐시 관리가 한결 간편해졌다.

현재 엔비디아는 Vera CPU를 독립형 제품으로 판매하고 있습니다. CoreWeave가 첫 번째 고객입니다. 메타(Meta)와의 거래는 더욱 파격적인데, 이는 최초의 대규모 '순수 Grace 배포' 사례로, GPU와 페어링되지 않은 상태에서 CPU를 대규모로 독립적으로 배포한 것입니다.

리서치 기관 크리에이티브 스트래티지스(Creative Strategies)의 수석 애널리스트 벤 바자린(Ben Bajarin)은 고강도 시스템 협업에서 CPU의 처리 능력이 가속기의 발전 속도를 따라잡을 수 있어야 한다고 지적했습니다. 데이터 채널에 1%의 지연만 발생해도 전체 AI 클러스터의 경제적 효율성은 크게 떨어진다. 이러한 극한의 시스템 효율성에 대한 추구는 모든 대형 기업들이 CPU의 성능 지표를 재검토하도록 만들고 있다.

Constellation Research의 부사장 겸 수석 애널리스트 홀거 뮐러(Holger Mueller)는 AI 워크로드가 에이전트 주도 아키텍처로 전환됨에 따라 CPU의 위상이 점점 더 핵심적으로 변하고 있다고 말했다. 그는 “에이전트 세계에서 에이전트는 API와 다양한 비즈니스 애플리케이션을 호출해야 하는데, 이러한 작업은 CPU가 수행하는 데 가장 적합하다”고 지적했다.

그는 또한 “현재 GPU와 CPU 중 어느 쪽이 추론 작업 처리에 더 적합한지에 대해서는 아직 결론이 나지 않았다. GPU는 모델 훈련 측면에서 우위를 점하고 있으며, TPU와 같은 맞춤형 ASIC도 각자의 전문 분야가 있다. 하지만 한 가지 분명한 점은 구글이 하이브리드 프로세서 아키텍처를 채택해야 한다는 것이다. 따라서 구글이 인텔과 협력하기로 한 것은 합리적인 선택이다”라고 덧붙였다.

결론: 에이전트 시대, 연산 능력의 균형이 다시 기울다

최신 산업 동향에서 주목해야 할 데이터가 하나 있습니다. 아마존 AWS와 OpenAI 간의 380억 달러에 달하는 협력 계약에서, 양측은 공식적으로 “수천만 개의 CPU”라는 확장 규모를 명시했다.

지난 몇 년간, 업계의 관심은 대개 “수십만 개의 GPU”에 집중되어 있었다. 그러나 OpenAI와 같은 최첨단 연구소들이 CPU 규모를 중요한 계획 변수로 삼은 것은, 지능형 에이전트의 워크로드 확장은 방대한 CPU 인프라를 기반으로 해야 한다는 분명한 신호를 외부에 전달한 것입니다.

미국 은행은 2030년까지 전 세계 CPU 시장 규모가 현재의 270억 달러에서 두 배인 600억 달러로 성장할 것으로 전망했습니다. 이렇게 늘어난 시장 규모는 거의 전적으로 AI에 의해 주도될 것이다.

우리는 완전히 새로운 인프라의 확장을 목격하고 있다. 대형 기업들은 더 이상 단순히 GPU를 쌓아두는 데 그치지 않고, AI 에이전트의 운영을 전담 지원하는 'CPU 스케줄링 인프라' 전체를 동시에 확장하고 있다.

인텔과 구글의 협력, 그리고 머스크의 맞춤형 칩에 대한 막대한 투자는 모두 한 가지 사실을 증명하고 있습니다. 바로 AI 경쟁의 승부처가 앞당겨지고 있다는 점입니다. 연산 능력이 더 이상 희소하지 않게 되면, 누가 가장 먼저 시스템 수준의 '병목 현상'을 해결할 수 있느냐에 따라 이 수조 달러 규모의 게임에서 최종 승자가 결정될 것입니다.

Kikyo

Kikyo

Kikyo

Kikyo Joy

Joy Kikyo

Kikyo Kikyo

Kikyo Weatherly

Weatherly Catherine

Catherine Anais

Anais Anais

Anais Catherine

Catherine Kikyo

Kikyo